1 概况

1.1 定义

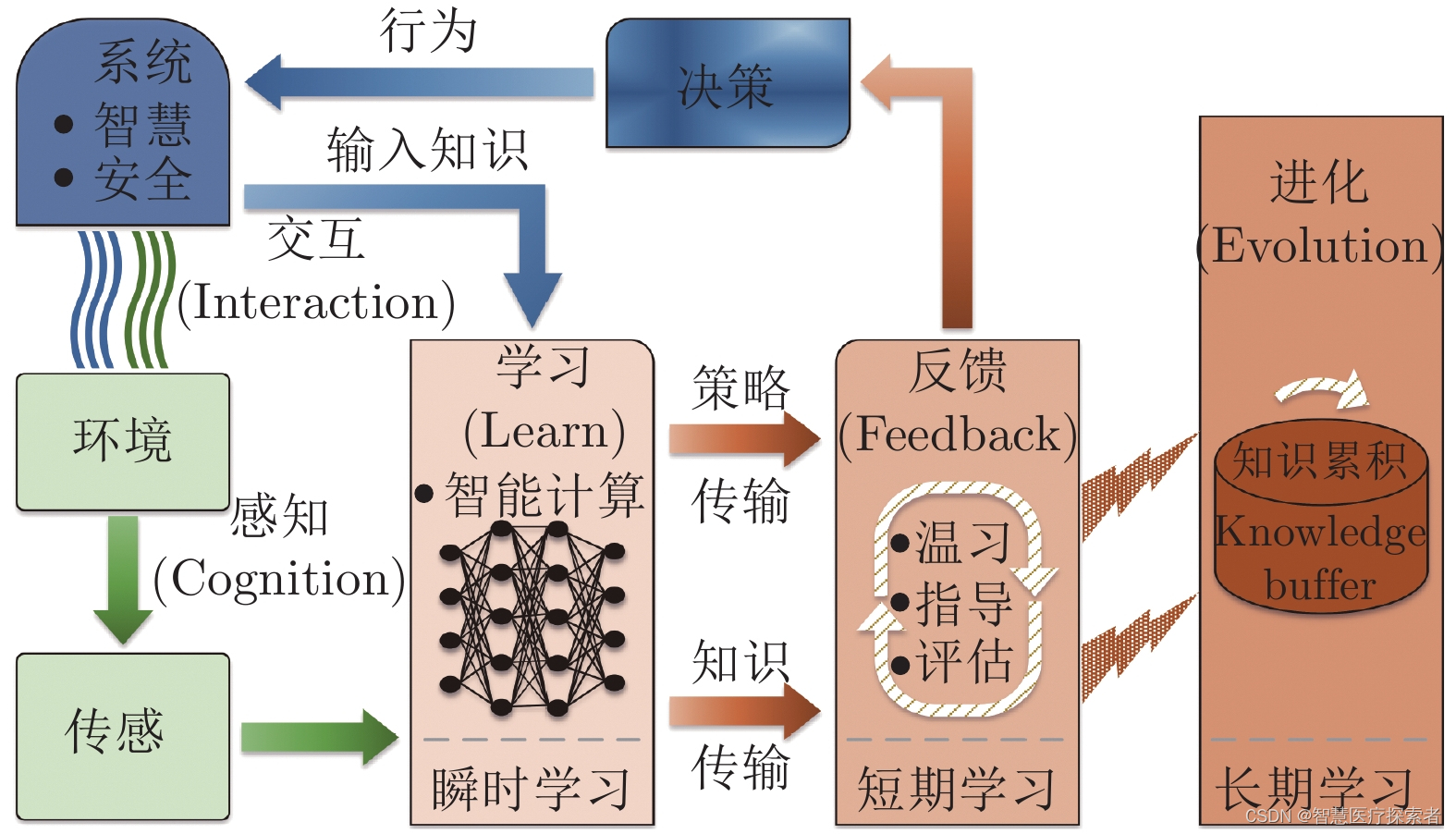

强化学习(Reinforcement Learning, RL)是机器学习的一个重要分支,与监督学习和无监督学习并列。它主要涉及智能体(agent)在环境中通过学习如何做出决策。与监督学习的主动指导和无监督学习的数据探索不同,强化学习更加注重在一系列决策中寻求最优策略。

1.2 基本概念

-

智能体(Agent): 在强化学习中,智能体是进行决策的实体,它通过与环境交互来学习。

-

环境(Environment): 智能体所处的环境,提供了智能体可以观察到的状态信息。

-

状态(State): 环境的状态,是智能体进行决策的依据。

-

动作(Action): 智能体在特定状态下可以采取的行动。

-

奖励(Reward): 智能体采取动作后从环境中获得的反馈,是优化策略的关键。

-

策略(Policy): 智能体在给定状态下选择动作的规则。

-

价值函数(Value Function): 预测采取特定动作或处于特定状态的长期累计奖励。

-

模型(Model): 环境的模型,描述状态转移和奖励规则。

1.2 核心要素

-

探索与利用(Exploration vs Exploitation): 强化学习中的基本困境是在探索未知策略和利用已知策略间找到平衡。

-

顺序决策: 强化学习强调的是一系列的决策,而非单一的决策。

-

延迟奖励: 强化学习关注长期奖励,即当前的决策可能会影响未来的奖励。

1.3 实施步骤

强化学习(Reinforcement Learning, RL)是一种独特的机器学习方法,它涉及智能体(agent)在一个环境中通过探索和利用来学习最优策略。以下是实施强化学习项目的一般步骤:

- 定义问题和目标

问题框架: 确定问题是否适合使用强化学习解决。强化学习适用于需要从交互中学习的顺序决策问题。

目标设定: 明确目标,如何量化智能体的性能,以及成功的标准。

- 设计环境和智能体

环境建模: 定义环境的状态、动作和奖励。在模拟或真实世界中创建一个环境,智能体将在其中操作。

智能体设计: 设计智能体的结构,包括决策方式(策略)和学习机制。

- 3. 选择或设计适合的算法

算法选择: 根据问题的性质选择合适的强化学习算法,如Q-learning、SARSA、策略梯度等。

算法定制: 如有必要,可以定制或改进现有算法以适应特定的问题。

- 4. 实现和模拟

编码实现: 使用适合的编程语言(如Python)和库(如OpenAI Gym、TensorFlow、PyTorch)实现环境、智能体和算法。

模拟实验: 在模拟环境中运行智能体,进行训练和测试。

-

5. 训练智能体

迭代学习: 让智能体通过与环境交互来学习,通过试错过程优化其策略。

监控学习过程: 监控智能体的学习进展,如奖励的变化、策略的改进等。

- 6. 评估和调优

性能评估: 评估智能体在任务中的表现,如完成任务的效率、获得的累积奖励等。

调优策略: 根据性能评估结果对智能体的策略、算法或模型参数进行调整和优化。

-

7. 部署和应用

实际部署: 将训练好的智能体部署到实际的应用环境中,如机器人、游戏或其他系统。

实时学习和适应: 在实际应用中继续学习和适应新的环境和挑战。

- 8. 反馈和迭代

收集反馈: 收集智能体在实际应用中的性能数据和用户反馈。

持续迭代: 根据反馈不断迭代和改进智能体的策略和算法。

强化学习的实施涉及到定义问题、设计环境和智能体、选择合适的算法、进行训练和评估,以及在实际应用中部署和迭代。由于强化学习涉及到与环境的复杂交互,这个过程通常需要不断的试验和调整。实施强化学习需要对问题域有深入的了解,同时也需要强大的算法和编程技能。

2 典型算法

强化学习作为一种独特的机器学习方法,拥有多种不同的算法,这些算法被设计用来解决决策过程中的优化问题。以下是强化学习中一些典型的算法:

2.1 Q学习(Q-Learning)

-

概述: 一种无模型(model-free)的值迭代(value iteration)方法,学习动作值函数(action-value function)以找到最优策略。

-

特点: 不需要知道环境的确切动态,通常用于离散动作空间。

2.2 SARSA(State-Action-Reward-State-Action)

-

概述: 与Q学习类似,但在更新值函数时考虑了当前动作的下一个状态和动作。

-

特点: 通常更稳健但可能较慢收敛于最优策略。

2.3 深度Q网络(Deep Q-Network, DQN)

-

概述: 结合了深度学习和Q学习,使用深度神经网络来逼近Q函数。

-

特点: 引入了经验回放(experience replay)和目标网络(target network)来提高训练稳定性。

2.4 策略梯度方法(Policy Gradient Methods)

-

概述: 直接优化策略本身,而非值函数。

-

特点: 可用于连续动作空间,通常具有更好的收敛性质。

2.5 Actor-Critic 方法

-

概述: 结合了值函数方法和策略梯度方法的优点,使用两个模型:一个作为Actor(决定动作),一个作为Critic(评估动作)。

-

特点: 旨在减少策略梯度的方差同时保留其偏差较低的优点。

2.6 异步优势Actor-Critic(Asynchronous Advantage Actor-Critic, A3C)

-

概述: 多线程版本的Actor-Critic方法,每个线程都探索不同的策略。

-

特点: 提高了学习速度和稳定性,适用于大规模问题。

2.7 软Actor-Critic(Soft Actor-Critic, SAC)

-

概述: 一种基于Actor-Critic的算法,强调在探索和利用之间取得平衡。

-

特点: 引入了熵作为额外的奖励,鼓励更广泛的探索。

2.8 Trust Region Policy Optimization(TRPO)

-

概述: 一种策略梯度方法,通过限制策略更新步长来避免性能显著下降。

-

特点: 保持了稳定和有效的学习,适用于高维和复杂的环境。

3 应用场景

强化学习作为机器学习的一种重要方法,已被应用于多种场景,特别是在需要决策和自动化控制的领域。以下是一些强化学习的主要应用场景:

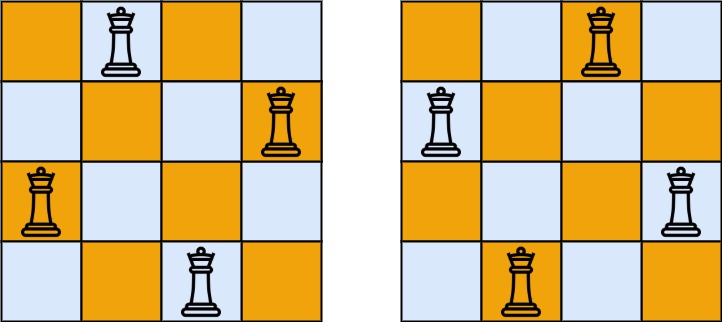

3.1 游戏和娱乐

-

棋盘游戏: 如AlphaGo在围棋上的成功,强化学习用于训练计算机在复杂的棋盘游戏中战胜人类。

-

电子游戏: 在电子游戏中,强化学习被用来训练具有高级策略和技巧的AI玩家。

3.2 机器人技术

-

机器人控制: 强化学习用于教授机器人执行特定任务,如搬运物品、导航等。

-

自主机器人: 使机器人能够在不确定的环境中做出决策并自主行动。

3.3 自动驾驶汽车

-

驾驶决策: 强化学习用于训练自动驾驶汽车在各种交通情况下做出正确的驾驶决策。

-

路径规划: 优化自动驾驶汽车的路线选择和行驶策略。

3.4 金融领域

-

量化交易: 在股票市场等金融领域中,强化学习用于开发交易策略和风险管理。

-

投资组合优化: 动态调整投资组合,以优化风险和收益。

3.5 物流和运筹

-

供应链优化: 强化学习在供应链管理中用于优化库存管理、物流等。

-

调度问题: 如车辆调度、航班调度等复杂调度问题的优化。

3.6 医疗领域

-

个性化治疗: 强化学习用于根据患者的特定情况制定个性化的治疗方案。

-

药物研发: 在药物设计和研发过程中,用于寻找新的药物分子或治疗方法。

3.7 能源管理

-

智能电网: 强化学习用于优化电力系统的负载分配和能源消耗。

-

可再生能源: 管理和优化风能和太阳能发电。

3.8 娱乐和内容生成

-

内容推荐: 在视频流媒体和在线购物平台中用于个性化的内容推荐。

-

创意内容生成: 生成音乐、艺术作品等创意内容。

4 面临挑战

强化学习(Reinforcement Learning, RL)作为一种复杂而强大的机器学习范式,在解决决策和控制问题方面表现出巨大潜力。然而,它也面临着一系列挑战,这些挑战阻碍了其在实际应用中的更广泛应用和发展。以下是强化学习目前面临的一些主要挑战:

4.1 样本效率

-

数据密集型: 强化学习通常需要大量的交互数据来学习有效的策略,这在现实世界应用中可能是不切实际的。

-

探索效率: 在复杂环境中,有效地探索以获取有价值的学习信息是一大挑战。

4.2 泛化能力

-

环境变化适应性: 训练得到的策略往往难以适应环境的微小变化,泛化到新场景或稍有不同的任务上是困难的。

-

从仿真到现实(Sim-to-Real): 如何将在仿真环境中训练的模型有效迁移到真实世界中。

4.3 计算资源和时间

-

计算成本: 强化学习尤其是深度强化学习通常需要大量的计算资源,这限制了其在资源有限的场景中的应用。

-

训练时间: 达到有效的学习可能需要长时间的训练。

4.4 稳定性和收敛性

-

训练稳定性: 特别是在使用深度神经网络作为函数逼近器时,训练过程可能非常不稳定。

-

收敛保证: 在某些强化学习算法中,保证策略最终收敛到最优解是具有挑战性的。

4.5 安全性和可靠性

-

安全性保障: 在关键应用中,如自动驾驶,确保学习过程和策略的安全性是极其重要的。

-

风险评估: 评估和管理在探索过程中可能带来的风险。

4.6 可解释性

- 黑盒模型: 强化学习尤其是基于深度学习的方法,其决策过程往往缺乏透明度和可解释性。

4.7 环境建模

- 准确的环境模型: 在模型驱动的强化学习中,建立一个准确的环境模型是非常复杂的。

4.8 伦理和责任

-

伦理问题: 强化学习的自主性和可能的不可预测性引发了一系列伦理问题。

-

责任归属: 当强化学习系统出错时,如何确定责任。

5 总结

强化学习是一种独特且强大的机器学习范式,它适用于一系列需要顺序决策和自适应控制的复杂问题。通过不断的探索和实验,强化学习模型学习如何在给定环境中作出最优决策。尽管存在一些挑战,但随着研究的深入和技术的发展,强化学习将在许多领域发挥更大的作用。