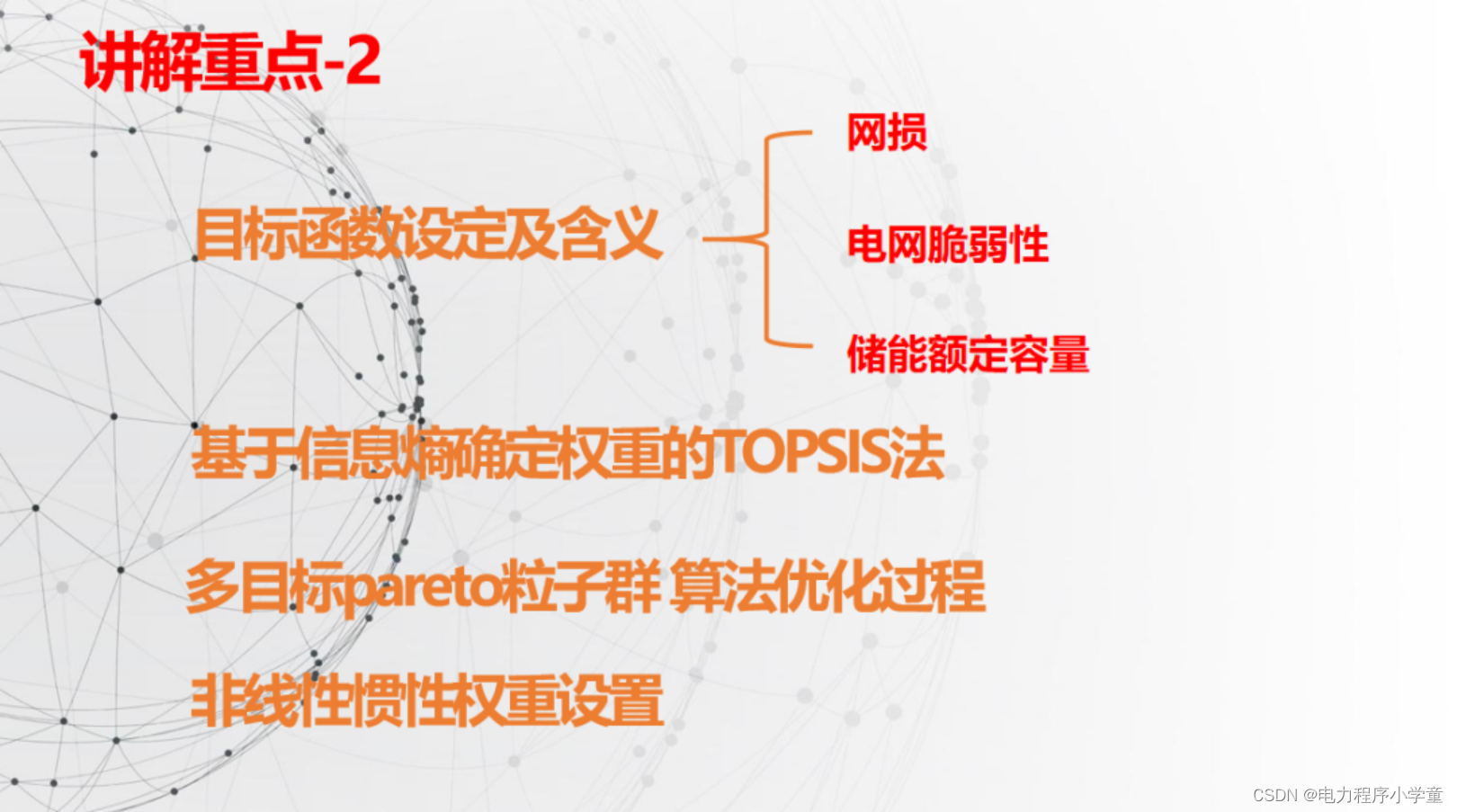

本文重点

在卷积神经网络中有很多重要的卷积核,比如1*1的卷积核,3*3的卷积核,本文将讲解1*1的卷积核的使用,它在卷积神经网络中具有重要的地位。由于1*1的卷积核使用了最小的窗口,那么1*1的卷积核就失去了卷积层可以识别高和宽维度上相邻元素构成的模式的功能。所以1*1的卷积核的主要计算发生在通道维上。

使用1*1卷积完成通道压缩

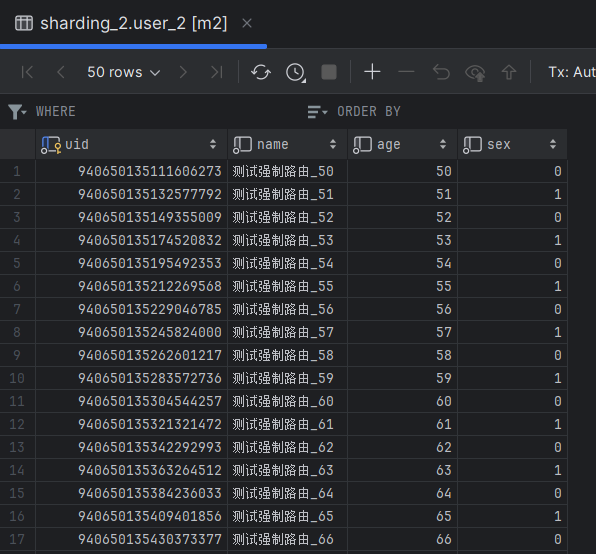

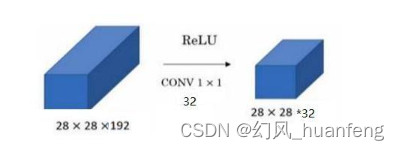

对于一个 28×28×192 的输入层,我们可以使用池化层压缩它的高度和宽度,但如果通道数量很大,如何才能压缩通道呢?

该如何把28×28×192压缩为 28×28×32 维度呢?你可以用 32个大小为 1×1×192 的过滤器,也就是说你使用了 32 个过滤器,输出层为 28×28×32,这就是压缩通道数(nc)的方法。

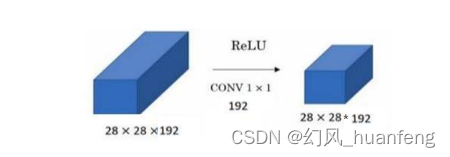

我们可以认为1×1 卷积只是添加了非线性函数,所以让网络学习更复杂的函数,我们可以再添加一层使用192个大小为 1×1*192的过滤器,其输入为 28×28×192,输出为 28×28×192。这样输入和输出的维度是一样的,都是28×28×192,但是后面的输出比前面的输入可以认为提取到了更加复杂的特征。