强化学习的落地应用场景,我认为可以是仿真环境仿真程度高,且仿真速度快的任务场景。而这篇帖子将会将:使用 GPU 进行大规模并行仿真,解决强化学习采样瓶颈。并直接举出三个例子,展示如何对原有的仿真环境进行修改,让它们适应 GPU 并行加速。

1.强化学习论文背后的仿真环境-重要性!

既要看到一些被发表的深度强化学习算法论文 在某些任务上得到超越人类的表现,也要关注这些算法背后的仿真环境:

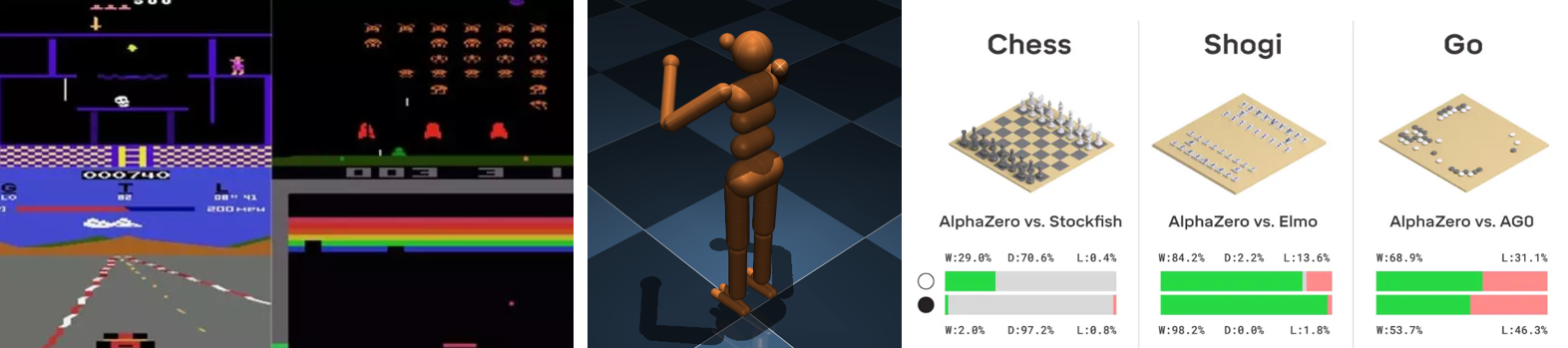

- DQN 算法等变体—— Atari 2600 的按键视频游戏 仿真环境

- DDPG,PPO,SAC 算法—— Gym 环境中的 MuJoCo 机器人控制 仿真环境

- AlphaGo,MuZero 系列算法——Atari 按键视频游戏,围棋,国际象棋,日本将棋

很多人复现了论文中的结果,然后用强化学习解决自己的问题时,才发现自己卡在了仿真环境这一步:

- 忽略一些消耗算力的仿真细节写出了仿真环境,却发现训练好的模型遇到了 “Simulation-to-Real (sim2real)” 的 gap,没法落地。在仿真程度不足的环境里训练后,迁移到真实场景时性能会明显下降。

- 当我们提供一个仿真程度更高的环境 去缩小 sim2real 的 gap 后,仿真速度却降下来了。即便运行很久,也只能收集到到堪堪可用的数据量。

- 虽然数据不多,那就将就着用吧。于