时间序列预测 —— TCN模型

卷积神经网络(Convolutional Neural Network,CNN)在图像处理等领域取得了显著的成就,一般认为在处理时序数据上不如RNN模型,而TCN(Temporal Convolutional Network)模型是一种基于卷积神经网络的时间序列预测模型,具有一定的优势。本文将介绍TCN模型的理论基础、公式推导、优缺点,并通过Python实现TCN的单步预测和多步预测,最后对TCN模型进行总结。

1. TCN模型理论及公式

1.1 TCN模型结构

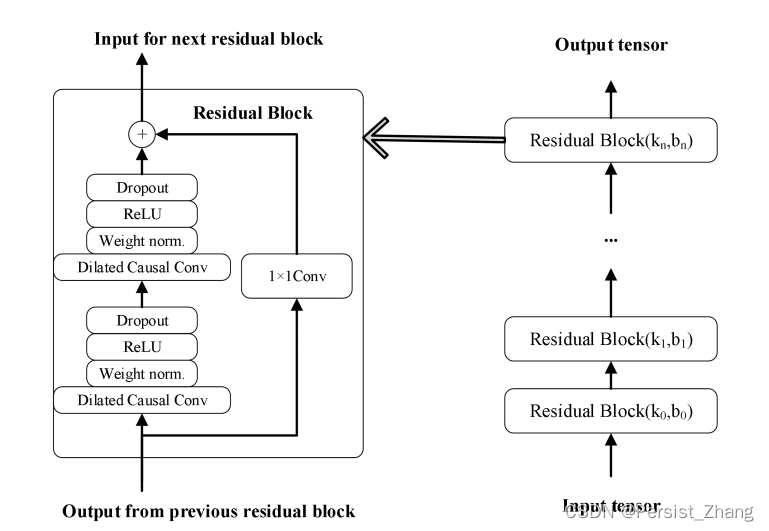

TCN模型主要包含卷积层和残差块。卷积层用于提取序列中的局部特征,而残差块有助于捕捉序列中的长期依赖关系。TCN的典型结构如下:

Input -> [Conv1D] -> [Residual Block] x N -> [Output Layer]

其中,[Conv1D] 表示一维卷积层,[Residual Block] 表示残差块,N 表示残差块的堆叠次数。

1.2 卷积操作

TCN模型的卷积操作采用了膨胀卷积(Dilated Convolution),膨胀卷积通过在卷积核之间插入零元素来扩大感受野。膨胀卷积的数学表达式为:

y [ t ] = ∑ k = 0 K − 1 w [ k ] ⋅ x [ t − d ⋅ k ] y[t] = \sum_{k=0}^{K-1} w[k] \cdot x[t - d \cdot k] y[t]=k=0∑K−1w[k]⋅x[t−d⋅k]

其中, y [ t ] y[t] y[t] 是卷积操作的输出, w [ k ] w[k] w[k] 是卷积核的权重, x [ t − d ⋅ k ] x[t - d \cdot k] x[t−d⋅k] 是输入序列的元素, d d d 是膨胀率。

1.3 残差块

TCN模型的残差块由两个卷积层和一个残差连接组成。残差块的计算过程如下:

- 输入 x x x 经过一个膨胀卷积层,得到输出 y y y。

- 将 y y y 与输入 x x x 相加,得到残差块的输出。

残差块的数学表达式为:

Output = x + Conv1D ( x ) \text{Output} = x + \text{Conv1D}(x) Output=x+Conv1D(x)

1.4 TCN模型的预测

TCN模型的预测过程包括多个残差块的堆叠,以及最后的输出层。整个模型的预测过程可以用以下公式表示:

Output = Output Layer ( Residual Block ( Residual Block ( … ( Residual Block ( Input ) ) … ) ) ) \text{Output} = \text{Output Layer}(\text{Residual Block}(\text{Residual Block}(\ldots(\text{Residual Block}(\text{Input}))\ldots))) Output=Output Layer(Residual Block(Residual Block(…(Residual Block(Input))…)))

2. TCN模型优缺点

2.1 优点

- TCN模型能够捕捉序列中的长期依赖关系,适用于时间序列数据。

- 模型结构相对简单,易于理解和调整。

2.2 缺点

- TCN模型在某些场景下可能对序列中的短期模式抽取效果不如LSTM等模型。

3. TCN模型与LSTM、GRU的区别

TCN模型、LSTM(Long Short-Term Memory)、GRU(Gated Recurrent Unit)都是用于时间序列预测的模型,它们之间有一些区别:

- 结构差异: TCN主要由卷积层和残差块组成,具有较为简单的结构;LSTM和GRU是循环神经网络(Recurrent Neural Network,RNN)的变种,具有包含循环单元的结构。

- 捕捉依赖关系的方式: TCN通过膨胀卷积和残差块来捕捉序列中的依赖关系;LSTM和GRU通过内部的门控机制(门控循环单元)来控制信息的传递和遗忘,从而捕捉长期和短期依赖关系。

4. Python实现TCN的单步预测和多步预测

以下是使用TensorFlow中Keras库实现TCN模型的单步预测和多步预测的代码。

# 导入必要的库

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.preprocessing import MinMaxScaler

from sklearn.metrics import mean_squared_error

from keras.models import Sequential

from keras.layers import Input, Dense

from tcn import TCN, tcn_full_summary# 生成示例数据

def generate_data():t = np.arange(0, 100, 0.1)data = np.sin(t) + 0.1 * np.random.randn(len(t))return data# 数据预处理

def preprocess_data(data, look_back=10):scaler = MinMaxScaler(feature_range=(0, 1))data = scaler.fit_transform(data.reshape(-1, 1)).flatten()X, y = [], []for i in range(len(data) - look_back):X.append(data[i:(i + look_back)])y.append(data[i + look_back])return np.array(X), np.array(y)# 构建 TCN 模型

def build_tcn_model(look_back, filters=64, kernel_size=2, dilations=[1, 2, 4, 8, 16]):model = Sequential()model.add(Input(shape=(look_back, 1)))model.add(TCN(nb_filters=filters, kernel_size=kernel_size, dilations=dilations, use_skip_connections=True, return_sequences=False, activation='tanh'))model.add(Dense(units=1, activation='linear'))model.compile(optimizer='adam', loss='mean_squared_error')tcn_full_summary(model)return model# 单步预测

def tcn_single_step_predict(model, X):return model.predict(X.reshape(1, -1, 1))[0, 0]# 多步预测

def tcn_multi_step_predict(model, X, n_steps):predictions = []for _ in range(n_steps):prediction = tcn_single_step_predict(model, X)predictions.append(prediction)X = np.append(X[0, 1:], prediction).reshape(1, -1, 1)return predictions# 主程序

data = generate_data()

look_back = 10

X, y = preprocess_data(data, look_back)# 划分训练集和测试集

train_size = int(len(X) * 0.8)

X_train, y_train = X[:train_size], y[:train_size]

X_test, y_test = X[train_size:], y[train_size:]# 调整输入形状

X_train = X_train.reshape(X_train.shape[0], look_back, 1)

X_test = X_test.reshape(X_test.shape[0], look_back, 1)# 构建和训练 TCN 模型

tcn_model = build_tcn_model(look_back)

tcn_model.fit(X_train, y_train, epochs=50, batch_size=1, verbose=2)# 单步预测

single_step_prediction = tcn_single_step_predict(tcn_model, X_test[0])# 多步预测

n_steps = 10

multi_step_predictions = tcn_multi_step_predict(tcn_model, X_test[0], n_steps)# 可视化结果

plt.plot(data, label='True Data')

plt.plot([None] * len(X) + multi_step_predictions, label='TCN Predictions')

plt.legend()

plt.show()上述代码实现了使用TCN模型进行时间序列的单步预测和多步预测。在单步预测中,模型使用最后一部分序列进行预测。在多步预测中,模型使用前面预测的结果作为输入来进行多步预测。

5. 总结

本文介绍了TCN模型的理论基础、公式推导、优缺点,并通过Python使用Keras库实现了TCN的单步预测和多步预测。TCN模型在时间序列预测任务中具有一定的优势,特别适用于捕捉序列中的长期依赖关系。然而,在实际应用中,不同任务可能需要根据具体情况选择合适的模型。希望通过本文的介绍和示例代码,读者能够更深入理解TCN模型及其在时间序列预测中的应用。