CNN

卷积网络

输入层:是一张像素图片 h高 * w宽 * c c是通道数,rgb是3通道

把图像分割,每一块

卷积层Conv:提取特征,发现边缘、方向等信息

卷积核:每块像素 和卷积核 相乘 获取边缘信息 一般选择1x1 3x3 5x5

卷积核当中的参数0 1,是自己设置的,根据输出的结果,有差异,然后更新参数

可以通过padding用0填充 保证在卷积过程中特征图大小不变

stride步长 增大 特征图会变小

多通道:

卷积核需要设置3x3x3

filter卷积核

输出特征图的大小

卷积核的创建代码

Pytorch

import torch

import torch.nn as nn

import torch.nn.functional as F# 定义一个卷积层

class ConvolutionalLayer(nn.Module):def __init__(self, in_channels, out_channels, kernel_size):super(ConvolutionalLayer, self).__init__()# 创建卷积核self.conv = nn.Conv2d(in_channels, out_channels, kernel_size)def forward(self, x):# 应用卷积操作x = self.conv(x)return x# 创建一个实例

conv_layer = ConvolutionalLayer(in_channels=3, out_channels=32, kernel_size=3)# 打印卷积层的参数

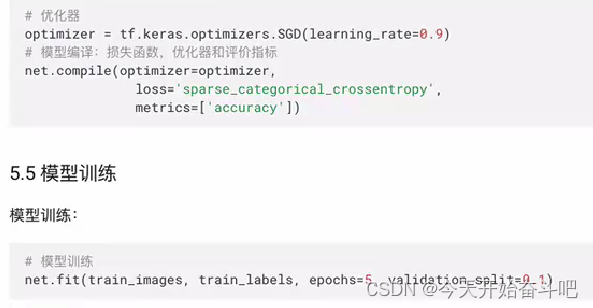

print(conv_layer)tensorflow

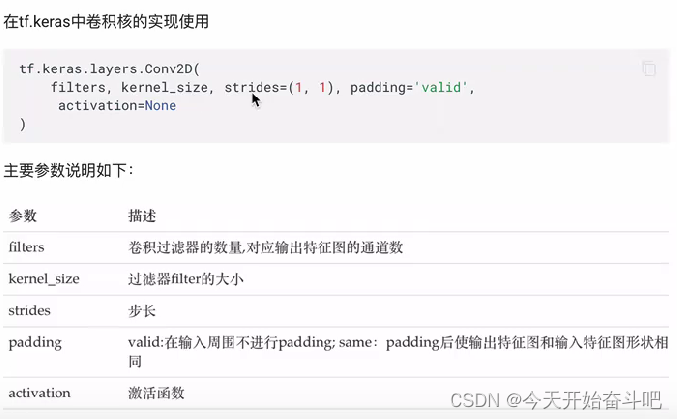

strides=(1,1)表示x和y方向的步长为1

same会补零,valid会直接换下一行 padding会在原图像周围填充

卷积核的数量(输出通道数),(3, 3)是卷积核的大小,activation='relu'指定了激活函数,input_shape=(None, None, 3)指定了输入数据的形状,其中None, None代表高度和宽度可以是任意值,3代表输入数据的通道数

import tensorflow as tf# 创建一个3x3的卷积层

model = tf.keras.Sequential([tf.keras.layers.Conv2D(32, (3, 3), activation='relu', input_shape=(None, None, 3))

])# 打印模型摘要

model.summary()池化层:压缩特征,大幅降低参数量级(降维、防止过拟合),对特征图进行下采样

池化层代码

最大池化: 4个2x2的窗口 选每个窗口中的最大值

pool_size池化窗口的大小

平均池化:

全连接层:输出想要的结果,经过卷积层的特征提取和池化层的降维后,将特征图转化reshape成一维向量,送到全连接层进行分类或回归操作

全连接层代码

使用tf.keras.dense实现

激活函数RELU:通过函数把特征保留并映射出来(保留特征,去除一些数据中是的冗余),这是神经网络能解决非线性问题关键。激活函数还可以构建稀疏矩阵,也就是稀疏性,这个特性可以去除数据中的冗余,最大可能保留数据的特征,也就是大多数为0的稀疏矩阵来表示(这个特性主要是对于Relu)

CNN基础——激活函数_cnn激活函数-CSDN博客

BP算法:信号的向前传播和误差的反向传播

参数量:

卷积层:

参数量 = (卷积核宽 卷积核高 输入通道数 + 1) 输出通道数

全连接层:

参数量 = (输入神经元数目 + 1) 输出神经元数目

LeNet-5