Python 机器学习 基础 之 监督学习 [ 核支持向量机 SVM ] 算法 的简单说明

目录

Python 机器学习 基础 之 监督学习 [ 核支持向量机 SVM ] 算法 的简单说明

一、简单介绍

二、监督学习 算法 说明前的 数据集 说明

三、监督学习 之 核支持向量机

1、线性模型与非线性特征

2、核技巧

3、理解SVM

4、SVM调参

5、为SVM预处理数据

6、优点、缺点和参数

附录

一、参考文献

一、简单介绍

Python是一种跨平台的计算机程序设计语言。是一种面向对象的动态类型语言,最初被设计用于编写自动化脚本(shell),随着版本的不断更新和语言新功能的添加,越多被用于独立的、大型项目的开发。Python是一种解释型脚本语言,可以应用于以下领域: Web 和 Internet开发、科学计算和统计、人工智能、教育、桌面界面开发、软件开发、后端开发、网络爬虫。

Python 机器学习是利用 Python 编程语言中的各种工具和库来实现机器学习算法和技术的过程。Python 是一种功能强大且易于学习和使用的编程语言,因此成为了机器学习领域的首选语言之一。Python 提供了丰富的机器学习库,如Scikit-learn、TensorFlow、Keras、PyTorch等,这些库包含了许多常用的机器学习算法和深度学习框架,使得开发者能够快速实现、测试和部署各种机器学习模型。

Python 机器学习涵盖了许多任务和技术,包括但不限于:

- 监督学习:包括分类、回归等任务。

- 无监督学习:如聚类、降维等。

- 半监督学习:结合了有监督和无监督学习的技术。

- 强化学习:通过与环境的交互学习来优化决策策略。

- 深度学习:利用深度神经网络进行学习和预测。

通过 Python 进行机器学习,开发者可以利用其丰富的工具和库来处理数据、构建模型、评估模型性能,并将模型部署到实际应用中。Python 的易用性和庞大的社区支持使得机器学习在各个领域都得到了广泛的应用和发展。

二、监督学习 算法 说明前的 数据集 说明

相关说明可见如下链接的 < 二、监督学习 算法 说明前的 数据集 说明 >,这里不在赘述:

数据集 说明:Python 机器学习 基础 之 监督学习 K-NN (K-邻近)算法 的简单说明

三、监督学习 之 核支持向量机

我们要讨论的下一种监督学习模型是核支持向量机(kernelized support vector machine)。核支持向量机(通常简称为 SVM)是可以推广到更复杂模型的扩展,这些模型无法被输入空间的超平面定义。虽然支持向量机可以同时用于分类和回归,但我们只会介绍用于分类的情况,它在 SVC 中实现。类似的概念也适用于支持向量回归,后者在 SVR 中实现。

核支持向量机背后的数学有点复杂,这里暂时先做简单说明,后面实际使用中我们再展开细数。

核支持向量机(Kernel Support Vector Machine,简称 Kernel SVM)是一种强大的监督学习算法,用于解决分类和回归问题。它在特征空间中找到一个最优的超平面来划分不同类别的数据点,并且具有良好的泛化性能。

以下是核支持向量机的一些关键概念和特点:

最大间隔分类器: 核支持向量机的目标是找到一个最大间隔的超平面来划分不同类别的数据点。最大间隔分类器可以提高模型的鲁棒性和泛化能力。

核技巧: 核支持向量机使用核函数来将数据点从原始特征空间映射到一个高维特征空间,从而使数据在高维空间中更容易分离。常用的核函数包括线性核、多项式核、径向基函数(RBF)核等。

支持向量: 在核支持向量机中,支持向量是离超平面最近的数据点,它们决定了超平面的位置和方向。只有支持向量才对模型的决策边界有影响,因此核支持向量机是一种高效的算法。

正则化参数: 核支持向量机具有一个正则化参数(C),用于平衡模型的复杂度和训练集的拟合程度。较小的C值会导致更大的间隔,较大的C值会导致更少的间隔错误。

处理非线性可分数据: 核支持向量机通过使用非线性核函数可以有效地处理非线性可分的数据。通过选择适当的核函数,核支持向量机可以在高维空间中找到一个线性可分的超平面,从而实现对非线性数据的分类。

对多类别问题的扩展: 核支持向量机可以直接扩展到多类别分类问题,例如使用一对多(One-vs-Rest)或一对一(One-vs-One)的策略来处理多类别情况。

参数调节: 调节核支持向量机的参数是非常重要的,包括选择适当的核函数、正则化参数C等。通常使用交叉验证等技术来调节参数以优化模型性能。

总的来说,核支持向量机是一种强大且灵活的监督学习算法,适用于各种分类和回归问题,尤其在高维数据和非线性数据上表现优秀。

1、线性模型与非线性特征

线性模型在低维空间中可能非常受限,因为线和平面的灵活性有限。有一种方法可以让线性模型更加灵活,就是添加更多的特征——举个例子,添加输入特征的交互项或多项式

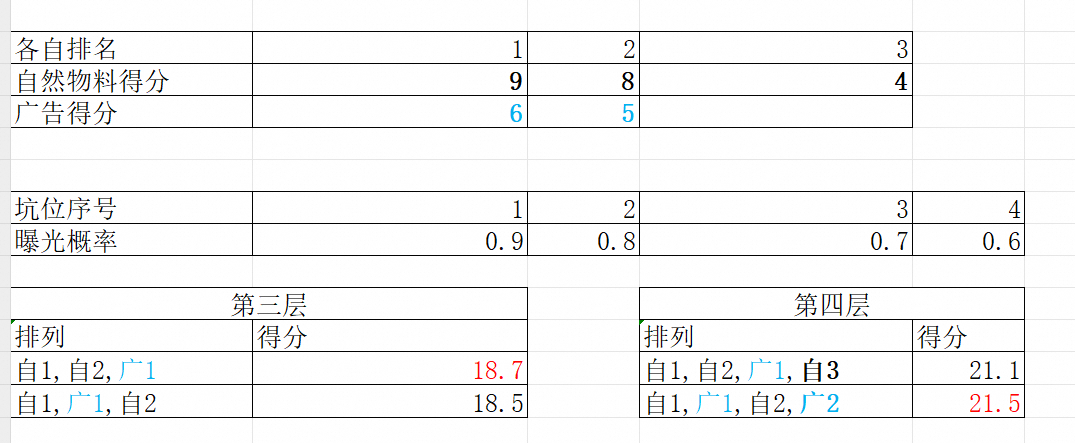

我们来看一下 之前用到的模拟数据集

from sklearn.datasets import make_blobs

import mglearn

import numpy as np

import matplotlib.pyplot as pltX, y = make_blobs(centers=4, random_state=8)

y = y % 2mglearn.discrete_scatter(X[:, 0], X[:, 1], y)

plt.xlabel("Feature 0")

plt.ylabel("Feature 1")

plt.savefig('Images/06KernelSupportVectorMachine-01.png', bbox_inches='tight')

plt.show()

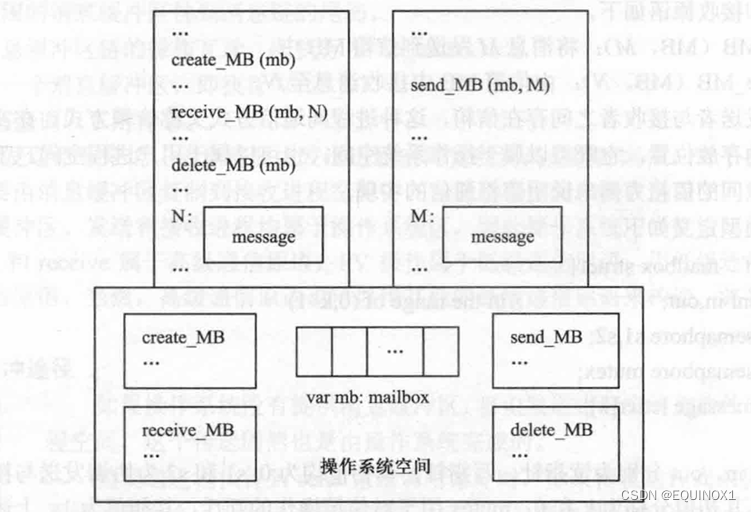

用于分类的线性模型只能用一条直线来划分数据点,对这个数据集无法给出较好的结果

from sklearn.svm import LinearSVC

linear_svm = LinearSVC().fit(X, y)mglearn.plots.plot_2d_separator(linear_svm, X)

mglearn.discrete_scatter(X[:, 0], X[:, 1], y)

plt.xlabel("Feature 0")

plt.ylabel("Feature 1")

plt.savefig('Images/06KernelSupportVectorMachine-02.png', bbox_inches='tight')

plt.show()

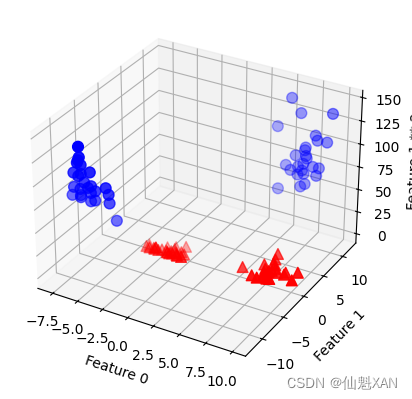

现在我们对输入特征进行扩展,比如说添加第二个特征的平方(feature1 ** 2 )作为一个新特征。现在我们将每个数据点表示为三维点 (feature0, feature1, feature1 ** 2) ,而不是二维点 (feature0, feature1) 。这个新的表示可以画成下图中的三维散点图:

import pandas as pd

import matplotlib.pyplot as plt

from pandas.plotting import scatter_matrix# 添加一个虚拟的第三个特征

X_extended = np.hstack([X, X[:, 1:] ** 2])fig = plt.figure()

ax = fig.add_subplot(111, projection='3d')# 绘制数据点

ax.scatter(X_extended[y == 0, 0], X_extended[y == 0, 1], X_extended[y == 0, 2], c='b', cmap=mglearn.cm2, s=60)

ax.scatter(X_extended[y == 1, 0], X_extended[y == 1, 1], X_extended[y == 1, 2], c='r', marker='^', cmap=mglearn.cm2, s=60)# 设置坐标轴标签

ax.set_xlabel("Feature 0")

ax.set_ylabel("Feature 1")

ax.set_zlabel("Feature 1 ** 2")plt.savefig('Images/06KernelSupportVectorMachine-03.png', bbox_inches='tight')

plt.show()

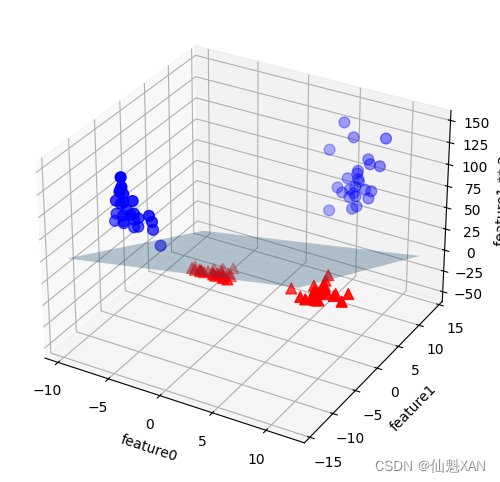

在数据的新表示中,现在可以用线性模型(三维空间中的平面)将这两个类别分开。我们可以用线性模型拟合扩展后的数据来验证这一点

X_new = X_extended

# 首先画出所有y == 0的点,然后画出所有y == 1的点

mask = y == 0# 创建线性支持向量机模型并拟合数据

linear_svm_3d = LinearSVC().fit(X_new, y)

coef, intercept = linear_svm_3d.coef_.ravel(), linear_svm_3d.intercept_# 创建新的图形

fig = plt.figure(figsize=(8, 6))

ax = fig.add_subplot(111, projection='3d')# 定义网格点

xx = np.linspace(X_new[:, 0].min() - 2, X_new[:, 0].max() + 2, 50)

yy = np.linspace(X_new[:, 1].min() - 2, X_new[:, 1].max() + 2, 50)

XX, YY = np.meshgrid(xx, yy)# 计算决策边界

ZZ = (coef[0] * XX + coef[1] * YY + intercept) / -coef[2]# 绘制决策边界和数据点

ax.plot_surface(XX, YY, ZZ, rstride=8, cstride=8, alpha=0.3)

ax.scatter(X_new[mask, 0], X_new[mask, 1], X_new[mask, 2], c='b', cmap=mglearn.cm2, s=60)

ax.scatter(X_new[~mask, 0], X_new[~mask, 1], X_new[~mask, 2], c='r', marker='^', cmap=mglearn.cm2, s=60)# 设置坐标轴标签

ax.set_xlabel("feature0")

ax.set_ylabel("feature1")

ax.set_zlabel("feature1 ** 2")plt.savefig('Images/06KernelSupportVectorMachine-04.png', bbox_inches='tight')

plt.show()

如果将线性 SVM 模型看作原始特征的函数,那么它实际上已经不是线性的了。它不是一条直线,而是一个椭圆,你可以在下图中看出

ZZ = YY ** 2

dec = linear_svm_3d.decision_function(np.c_[XX.ravel(), YY.ravel(), ZZ.ravel()])

plt.contourf(XX, YY, dec.reshape(XX.shape), levels=[dec.min(), 0, dec.max()],cmap=mglearn.cm2, alpha=0.5)

mglearn.discrete_scatter(X[:, 0], X[:, 1], y)

plt.xlabel("Feature 0")

plt.ylabel("Feature 1")

plt.savefig('Images/06KernelSupportVectorMachine-05.png', bbox_inches='tight')

plt.show()

2、核技巧

这里需要记住的是,向数据表示中添加非线性特征,可以让线性模型变得更强大。但是,通常来说我们并不知道要添加哪些特征,而且添加许多特征(比如 100 维特征空间所有可能的交互项)的计算开销可能会很大。幸运的是,有一种巧妙的数学技巧,让我们可以在更高维空间中学习分类器,而不用实际计算可能非常大的新的数据表示。这种技巧叫作核技巧 (kernel trick),它的原理是直接计算扩展特征表示中数据点之间的距离(更准确地说是内积),而不用实际对扩展进行计算。

对于支持向量机,将数据映射到更高维空间中有两种常用的方法:一种是多项式核,在一定阶数内计算原始特征所有可能的多项式(比如 feature1 ** 2 * feature2 ** 5 );另一种是径向基函数(radial basis function,RBF)核,也叫高斯核。高斯核有点难以解释,因为它对应无限维的特征空间。一种对高斯核的解释是它考虑所有阶数的所有可能的多项式,但阶数越高,特征的重要性越小。

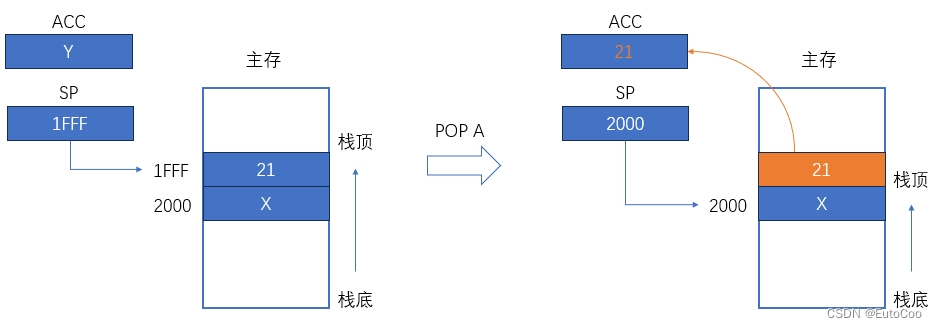

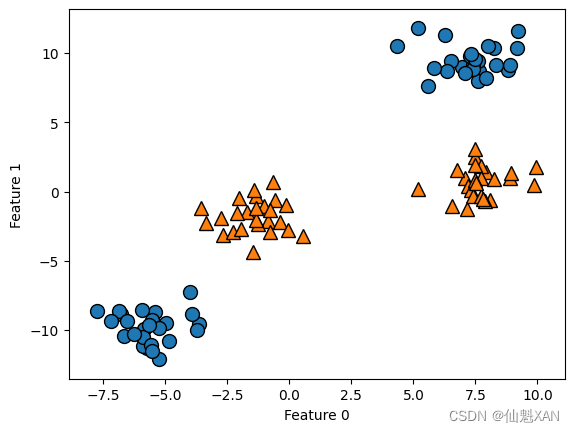

3、理解SVM

在训练过程中,SVM 学习每个训练数据点对于表示两个类别之间的决策边界的重要性。通常只有一部分训练数据点对于定义决策边界来说很重要:位于类别之间边界上的那些点。这些点叫作支持向量 (support vector),支持向量机正是由此得名。

想要对新样本点进行预测,需要测量它与每个支持向量之间的距离。分类决策是基于它与支持向量之间的距离以及在训练过程中学到的支持向量重要性(保存在 SVC 的 dual_coef_ 属性中)来做出的。

数据点之间的距离由高斯核给出:

![]()

这里 x 1 和 x 2 是数据点,‖x 1 - x 2 ‖表示欧氏距离,γ (gamma)是控制高斯核宽度的参数。

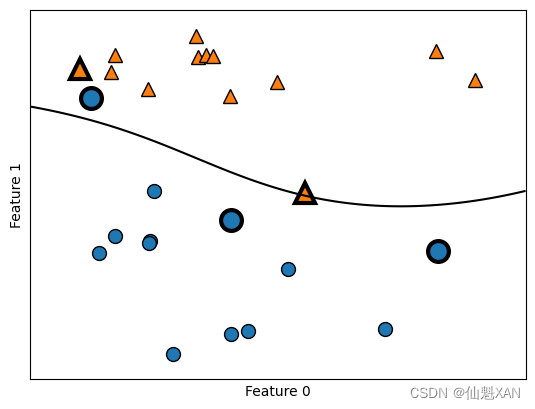

下图是支持向量机对一个二维二分类数据集的训练结果。决策边界用黑色表示,支持向量是尺寸较大的点。下列代码将在 forge 数据集上训练 SVM 并创建此图:

from sklearn.svm import SVC

X, y = mglearn.tools.make_handcrafted_dataset()

svm = SVC(kernel='rbf', C=10, gamma=0.1).fit(X, y)

mglearn.plots.plot_2d_separator(svm, X, eps=.5)

mglearn.discrete_scatter(X[:, 0], X[:, 1], y)

# 画出支持向量

sv = svm.support_vectors_

# 支持向量的类别标签由dual_coef_的正负号给出

sv_labels = svm.dual_coef_.ravel() > 0

mglearn.discrete_scatter(sv[:, 0], sv[:, 1], sv_labels, s=15, markeredgewidth=3)

plt.xlabel("Feature 0")

plt.ylabel("Feature 1")

plt.savefig('Images/06KernelSupportVectorMachine-06.png', bbox_inches='tight')

plt.show()

在这个例子中,SVM 给出了非常平滑且非线性(不是直线)的边界。这里我们调节了两个参数:C 参数和 gamma 参数,下面我们将详细讨论。

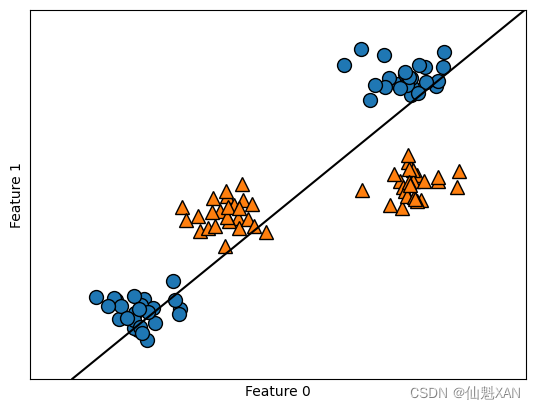

4、SVM调参

gamma 参数是上一节给出的公式中的参数,用于控制高斯核的宽度。它决定了点与点之间“靠近”是指多大的距离。C 参数是正则化参数,与线性模型中用到的类似。它限制每个点的重要性(或者更确切地说,每个点的 dual_coef_ )。

我们来看一下,改变这些参数时会发生什么

fig, axes = plt.subplots(3, 3, figsize=(15, 10))for ax, C in zip(axes, [-1, 0, 3]):for a, gamma in zip(ax, range(-1, 2)):mglearn.plots.plot_svm(log_C=C, log_gamma=gamma, ax=a)axes[0, 0].legend(["class 0", "class 1", "sv class 0", "sv class 1"],ncol=4, loc=(.9, 1.2))

plt.savefig('Images/06KernelSupportVectorMachine-07.png', bbox_inches='tight')

plt.show()

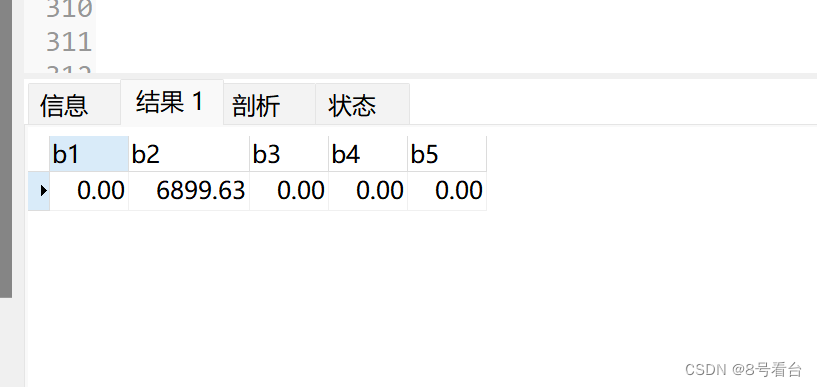

从左到右,我们将参数 gamma 的值从 0.1 增加到 10 。gamma 较小,说明高斯核的半径较大,许多点都被看作比较靠近。这一点可以在图中看出:左侧的图决策边界非常平滑,越向右的图决策边界更关注单个点。小的 gamma 值表示决策边界变化很慢,生成的是复杂度较低的模型,而大的 gamma 值则会生成更为复杂的模型。

从上到下,我们将参数 C 的值从 0.1 增加到 1000 。与线性模型相同,C 值很小,说明模型非常受限,每个数据点的影响范围都有限。你可以看到,左上角的图中,决策边界看起来几乎是线性的,误分类的点对边界几乎没有任何影响。再看左下角的图,增大 C 之后这些点对模型的影响变大,使得决策边界发生弯曲来将这些点正确分类。

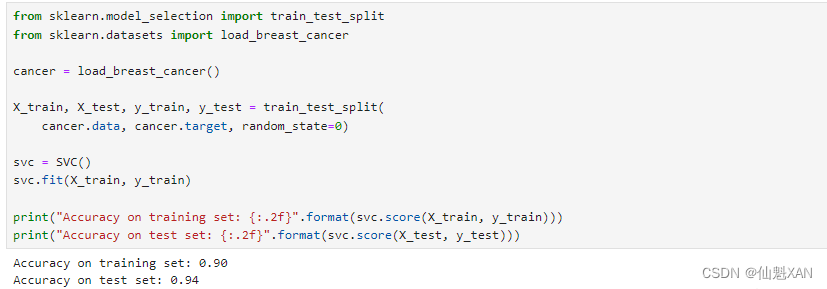

我们将 RBF 核 SVM 应用到乳腺癌数据集上。默认情况下,C=1 ,gamma=1/n_features :

from sklearn.model_selection import train_test_split

from sklearn.datasets import load_breast_cancercancer = load_breast_cancer()X_train, X_test, y_train, y_test = train_test_split(cancer.data, cancer.target, random_state=0)svc = SVC()

svc.fit(X_train, y_train)print("Accuracy on training set: {:.2f}".format(svc.score(X_train, y_train)))

print("Accuracy on test set: {:.2f}".format(svc.score(X_test, y_test)))

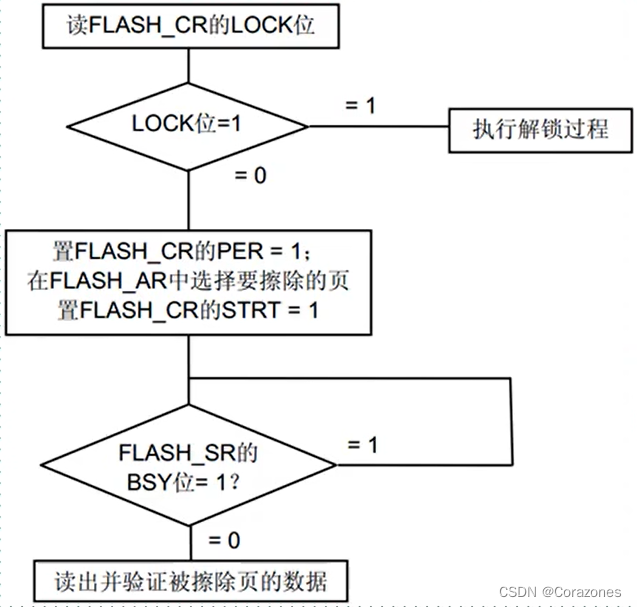

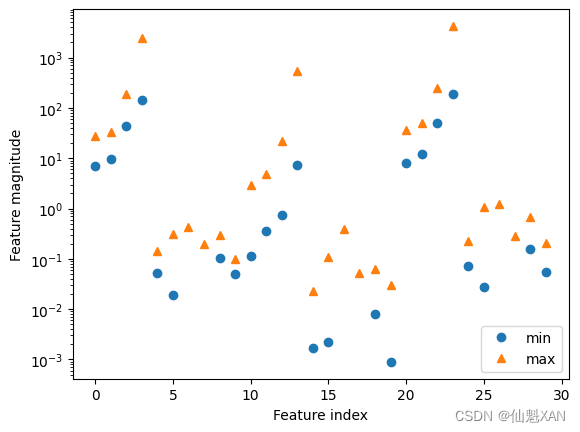

这个模型在训练集上的分数十分完美,但在测试集上的精度只有 63%,存在相当严重的过拟合。虽然 SVM 的表现通常都很好,但它对参数的设定和数据的缩放非常敏感。特别地,它要求所有特征有相似的变化范围。我们来看一下每个特征的最小值和最大值,它们绘制在对数坐标上

plt.plot(X_train.min(axis=0), 'o', label="min")

plt.plot(X_train.max(axis=0), '^', label="max")

plt.legend(loc=4)

plt.xlabel("Feature index")

plt.ylabel("Feature magnitude")

plt.yscale("log")

plt.savefig('Images/06KernelSupportVectorMachine-08.png', bbox_inches='tight')

plt.show()

从这张图中,我们可以确定乳腺癌数据集的特征具有完全不同的数量级。这对其他模型来说(比如线性模型)可能是小问题,但对核 SVM 却有极大影响。

5、为SVM预处理数据

解决这个问题的一种方法就是对每个特征进行缩放,使其大致都位于同一范围。核 SVM 常用的缩放方法就是将所有特征缩放到 0 和 1 之间。现在我们来“人工”做到这一点:

# 计算训练集中每个特征的最小值

min_on_training = X_train.min(axis=0)

# 计算训练集中每个特征的范围(最大值-最小值)

range_on_training = (X_train - min_on_training).max(axis=0)# 减去最小值,然后除以范围

# 这样每个特征都是min=0和max=1

X_train_scaled = (X_train - min_on_training) / range_on_training

print("Minimum for each feature\n{}".format(X_train_scaled.min(axis=0)))

print("Maximum for each feature\n {}".format(X_train_scaled.max(axis=0)))

# 利用训练集的最小值和范围对测试集做相同的变换(详见第3章)

X_test_scaled = (X_test - min_on_training) / range_on_trainingsvc = SVC()

svc.fit(X_train_scaled, y_train)print("Accuracy on training set: {:.3f}".format(svc.score(X_train_scaled, y_train)))

print("Accuracy on test set: {:.3f}".format(svc.score(X_test_scaled, y_test)))

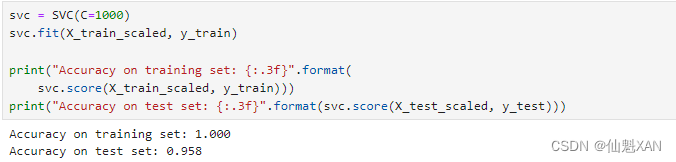

数据缩放的作用很大!实际上模型现在处于欠拟合的状态,因为训练集和测试集的性能非常接近,但还没有接近 100% 的精度。从这里开始,我们可以尝试增大 C 或 gamma 来拟合更为复杂的模型。例如:

svc = SVC(C=1000)

svc.fit(X_train_scaled, y_train)print("Accuracy on training set: {:.3f}".format(svc.score(X_train_scaled, y_train)))

print("Accuracy on test set: {:.3f}".format(svc.score(X_test_scaled, y_test)))

在这个例子中,增大 C 可以显著改进模型,得到 97.2% 的精度。

6、优点、缺点和参数

核支持向量机是非常强大的模型,在各种数据集上的表现都很好。SVM 允许决策边界很复杂,即使数据只有几个特征。它在低维数据和高维数据(即很少特征和很多特征)上的表现都很好,但对样本个数的缩放表现不好。在有多达 10 000 个样本的数据上运行 SVM 可能表现良好,但如果数据量达到 100 000 甚至更大,在运行时间和内存使用方面可能会面临挑战。

SVM 的另一个缺点是,预处理数据和调参都需要非常小心。这也是为什么如今很多应用中用的都是基于树的模型,比如随机森林或梯度提升(需要很少的预处理,甚至不需要预处理)。此外,SVM 模型很难检查,可能很难理解为什么会这么预测,而且也难以将模型向非专家进行解释。

不过 SVM 仍然是值得尝试的,特别是所有特征的测量单位相似(比如都是像素密度)而且范围也差不多时。

核 SVM 的重要参数是正则化参数 C 、核的选择以及与核相关的参数。虽然我们主要讲的是 RBF 核,但 scikit-learn 中还有其他选择。RBF 核只有一个参数 gamma ,它是高斯核宽度的倒数。gamma 和 C 控制的都是模型复杂度,较大的值都对应更为复杂的模型。因此,这两个参数的设定通常是强烈相关的,应该同时调节。

附录

一、参考文献

参考文献:[德] Andreas C. Müller [美] Sarah Guido 《Python Machine Learning Basics Tutorial》