HDFS 高可用集群的搭建

由于条件限制,电脑只够我开3台虚拟机,所以我们就用这3台虚拟机搭建一个HDFS的高可用。

在搭建之前我们先来理清一下3台虚拟机master,node1,node2分别会有哪些进程

在高可用集群中会有2个NameNode,一个是活跃的(ANN),一个是备用的(SNN),每一个NAmeNode节点上都应该有一个故障转移控制器(ZKFC)去管理各自的NameNode,除了NameNode,每个节点上都应该有JN处理日志,ZooKeeper负责进行选举,node1,node2上还应该有DataNode负责存储数据。

master : ANamenode、ZKFC 、JN、ZooKeeper

node1 : SNameNode、DataNode、ZKFC、JN、ZooKeeper

node2 :DataNode、JN、ZooKeeper

在工作中高可用集群一般是有5台节点,其进程分布为:

master1:ANamenode、ZKFC

master2:SNameNode、ZKFC

node1:DataNode、JN、ZooKeeper

node2:DataNode、JN、ZooKeeper

node3:DataNode、JN、ZooKeeper

开始搭建

1、关闭防火墙

service firewalld stop

2、时间同步

yum install ntp

ntpdate -u s2c.time.edu.cn

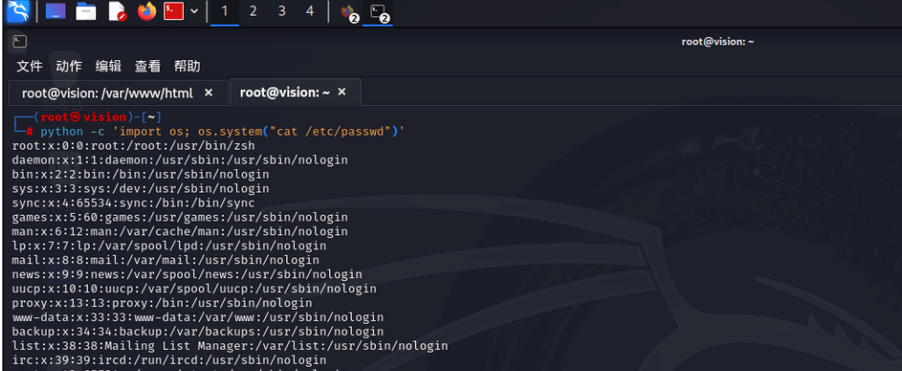

3、免密钥 (远程执行命令)

#在两个主节点生成密钥文件ssh-keygen -t rsassh-copy-id ipmaster-->master,node1,node2node1-->master,node1,node2

4、修改hadoop配置文件

core-site.xml

<configuration><property><name>fs.defaultFS</name><value>hdfs://cluster</value></property><property><name>hadoop.tmp.dir</name><value>/usr/local/soft/hadoop-3.1.2/tmp</value></property><property><name>fs.trash.interval</name><value>1440</value></property><property><name>ha.zookeeper.quorum</name><value>master:2181,node1:2181,node2:2181</value></property>

</configuration>

2181是端口号,如果其他地方没有改那就保持默认不要改

hdfs-site.xml

<configuration>

<!-- 指定hdfs元数据存储的路径 -->

<property>

<name>dfs.namenode.name.dir</name>

<value>/usr/local/soft/hadoop-3.1.2/data/namenode</value>

</property><!-- 指定hdfs数据存储的路径 -->

<property>

<name>dfs.datanode.data.dir</name>

<value>/usr/local/soft/hadoop-3.1.2/data/datanode</value>

</property><!-- 数据备份的个数 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property><!-- 关闭权限验证 -->

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property><!-- 开启WebHDFS功能(基于REST的接口服务) -->

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property><!-- //////////////以下为HDFS HA的配置////////////// -->

<!-- 指定hdfs的nameservices名称为mycluster -->

<property>

<name>dfs.nameservices</name>

<value>cluster</value>

</property><!-- 指定cluster的两个namenode的名称分别为nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.cluster</name>

<value>nn1,nn2</value>

</property><!-- 配置nn1,nn2的rpc通信端口 -->

<property>

<name>dfs.namenode.rpc-address.cluster.nn1</name>

<value>master:8020</value>

</property>

<property>

<name>dfs.namenode.rpc-address.cluster.nn2</name>

<value>node1:8020</value>

</property><!-- 配置nn1,nn2的http通信端口 -->

<property>

<name>dfs.namenode.http-address.cluster.nn1</name>

<value>master:9870</value>

</property>

<property>

<name>dfs.namenode.http-address.cluster.nn2</name>

<value>node1:9870</value>

</property><!-- 指定namenode元数据存储在journalnode中的路径 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://master:8485;node1:8485;node2:8485/cluster</value>

</property><!-- 指定journalnode日志文件存储的路径 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/usr/local/soft/hadoop-3.1.2/data/journal</value>

</property><!-- 指定HDFS客户端连接active namenode的java类 -->

<property>

<name>dfs.client.failover.proxy.provider.cluster</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property><!-- 配置隔离机制为ssh -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property><!-- 指定秘钥的位置 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_rsa</value>

</property><!-- 开启自动故障转移 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

</configuration>

5、同步到其它节点

cd /usr/local/soft/hadoop-3.1.2/etc/hadoopscp ./* node1:`pwd`scp ./* node2:`pwd`

6、删除hadoop数据存储目录下的文件 每个节点都需要删除

rm -rf /usr/local/soft/hadoop-3.1.2/tmp

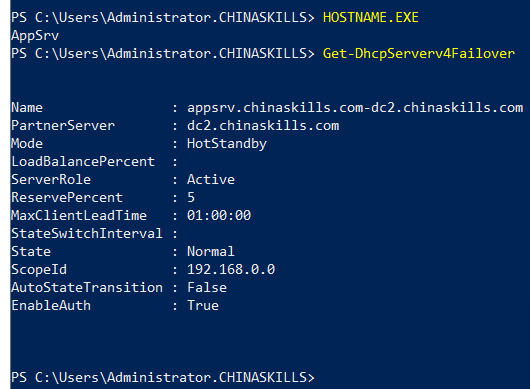

7、启动zookeeper 三台都需要启动

#启动

zkServer.sh start

#查看状态

zkServer.sh status

#当3个节点中有一个leader 2个follower时代表zookeeper启动成功

master

node1

node2

8、启动JN 存储hdfs元数据

#三台JN上执行 启动命令:

hadoop-daemon.sh start journalnode

9、格式化 在一台NN上执行,这里选择master

hdfs namenode -format

#启动当前的NN

hadoop-daemon.sh start namenode

10、执行同步 没有格式化的NN上执行 在另外一个namenode上面执行 这里选择node1

hdfs namenode -bootstrapStandby

11、格式化ZK 在master上面执行

#!!一定要先 把zk集群正常 启动起来

hdfs zkfc -formatZK

12、在hadoop-env.sh文件中配置HDFS_JOURNALNODE_USER和HDFS_ZKFC_USER,给他们设置root用户

export HDFS_JOURNALNODE_USER=root

export HDFS_ZKFC_USER=root

13、启动hdfs集群,在master上执行

start-dfs.sh

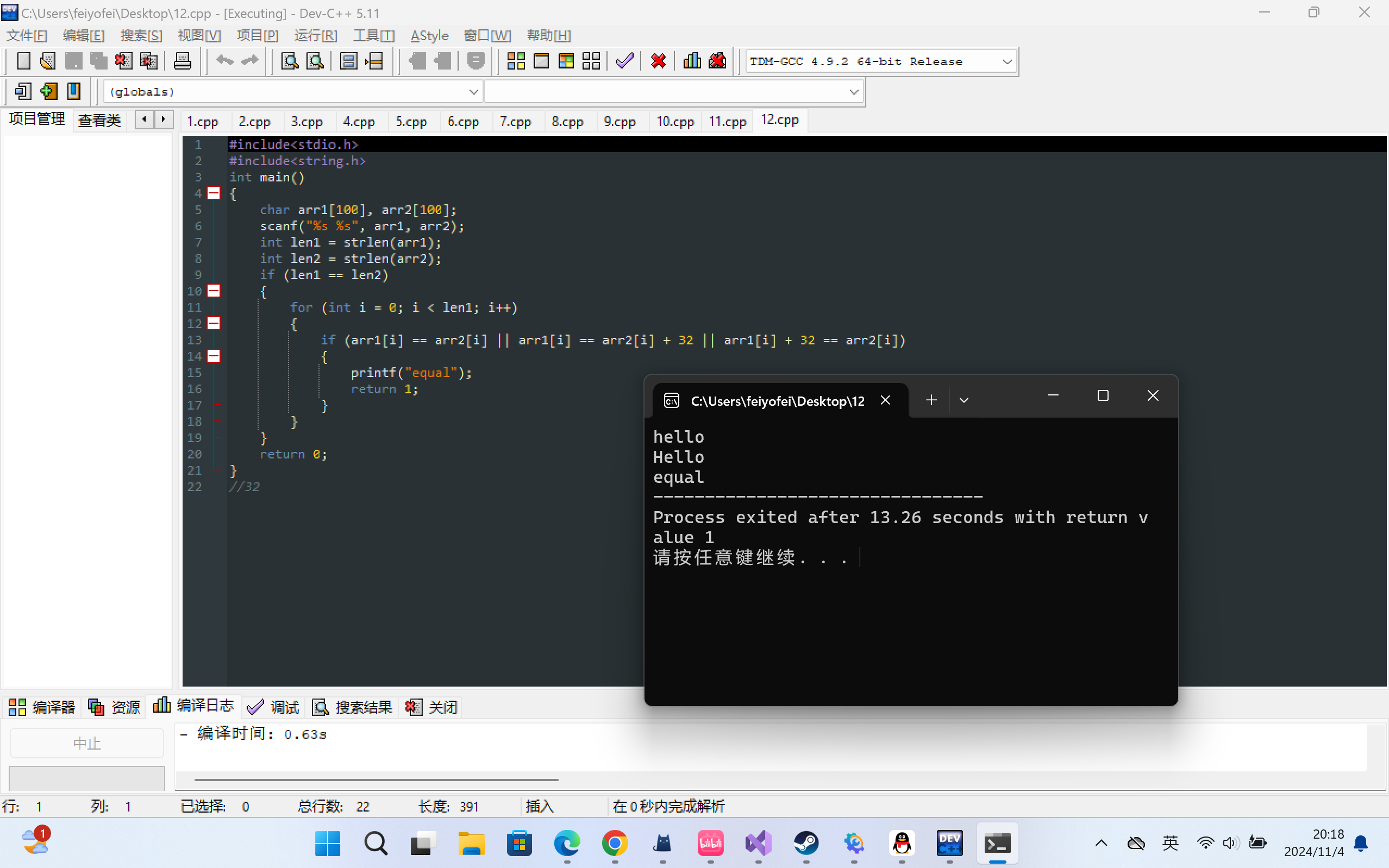

14、jps查看各节点进程

master

node1

node2

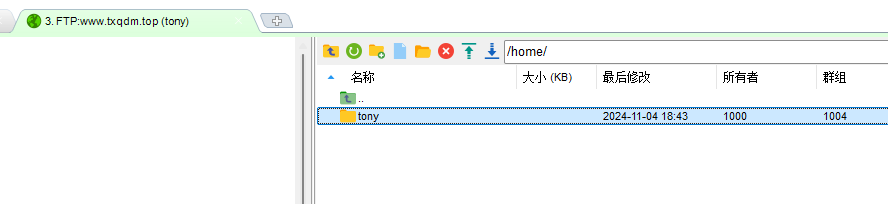

15、浏览器查看9870端口

master

node1

后续使用的时候步骤:

1、开启虚拟机

2、每台机器先启动zk

3、在master上执行start-dfs.sh

4、关闭高可用hdfs stop-dfs.sh

咱们工作的时候,公司一般都会采用高可用集群模式,给工作加上一重保险