介绍

摘要

通道或空间注意力机制在许多计算机视觉任务中表现出显著的效果,可以生成更清晰的特征表示。然而,通过通道维度缩减来建模跨通道关系可能会对提取深度视觉表示带来副作用。本文提出了一种新颖高效的多尺度注意力(EMA)模块。该模块着重于保留每个通道的信息并减少计算开销,我们将部分通道重新调整为批次维度,并将通道维度分组为多个子特征,使空间语义特征在每个特征组内分布均匀。具体来说,除了在每个并行分支中对全局信息进行编码以重新校准通道权重外,这两个并行分支的输出特征还通过跨维度交互进一步聚合,以捕捉像素级的成对关系。我们在图像分类和目标检测任务上进行了广泛的消融研究和实验,使用流行的基准数据集(如CIFAR-100、ImageNet-1k、MS COCO和VisDrone2019)来评估其性能。

YOLOv11目标检测创新改进与实战案例专栏

点击查看文章目录: YOLOv11创新改进系列及项目实战目录 包含卷积,主干 注意力,检测头等创新机制 以及 各种目标检测分割项目实战案例

点击查看专栏链接: YOLOv11目标检测创新改进与实战案例

文章链接

论文地址:论文地址

代码地址:代码地址

基本原理

EMA(Efficient Multi-Scale Attention)模块是一种新颖的高效多尺度注意力机制,旨在提高计算机视觉任务中的特征表示效果。 EMA注意力模块通过结合通道和空间信息、采用多尺度并行子网络结构以及优化坐标注意力机制,实现了更加高效和有效的特征表示,为计算机视觉任务的性能提升提供了重要的技术支持。

-

通道和空间注意力的结合:EMA模块通过将通道和空间信息相结合,实现了通道维度的信息保留和降低计算负担。这种结合有助于在特征表示中捕捉跨通道关系,同时避免了通道维度的削减,从而提高了模型的表现效果。

-

多尺度并行子网络:EMA模块采用多尺度并行子网络结构,其中包括一个处理1x1卷积核和一个处理3x3卷积核的并行子网络。这种结构有助于有效捕获跨维度交互作用,建立不同维度之间的依赖关系,从而提高特征表示的能力。

-

坐标注意力(CA)的再审视:EMA模块在坐标注意力(CA)的基础上进行了改进和优化。CA模块通过将位置信息嵌入通道注意力图中,实现了跨通道和空间信息的融合。EMA模块在此基础上进一步发展,通过并行子网络块有效捕获跨维度交互作用,建立不同维度之间的依赖关系。

-

特征聚合和交互:EMA模块通过并行子网络的设计,有助于实现特征的聚合和交互,从而提高模型对长距离依赖关系的建模能力。这种设计避免了更多的顺序处理和大规模深度,使模型更加高效和有效。

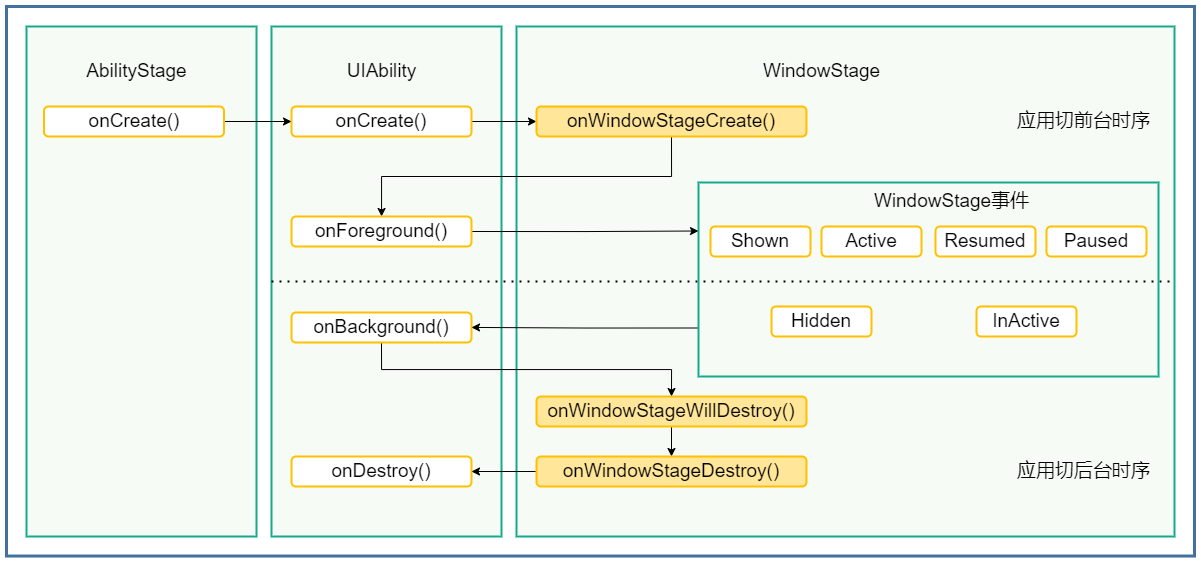

下图是结构,其中包括输入、特征重组、通道注意力和输出步骤。

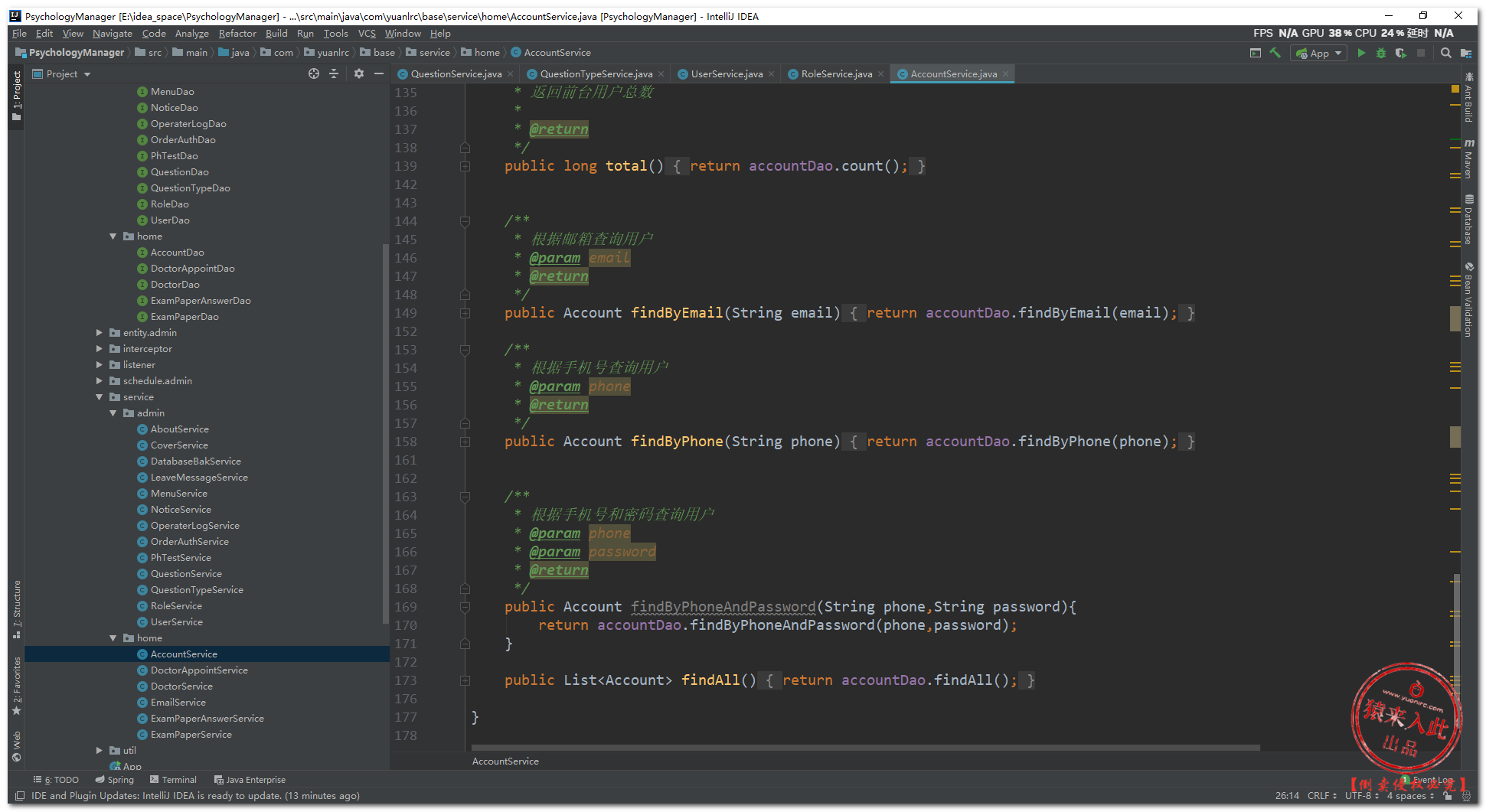

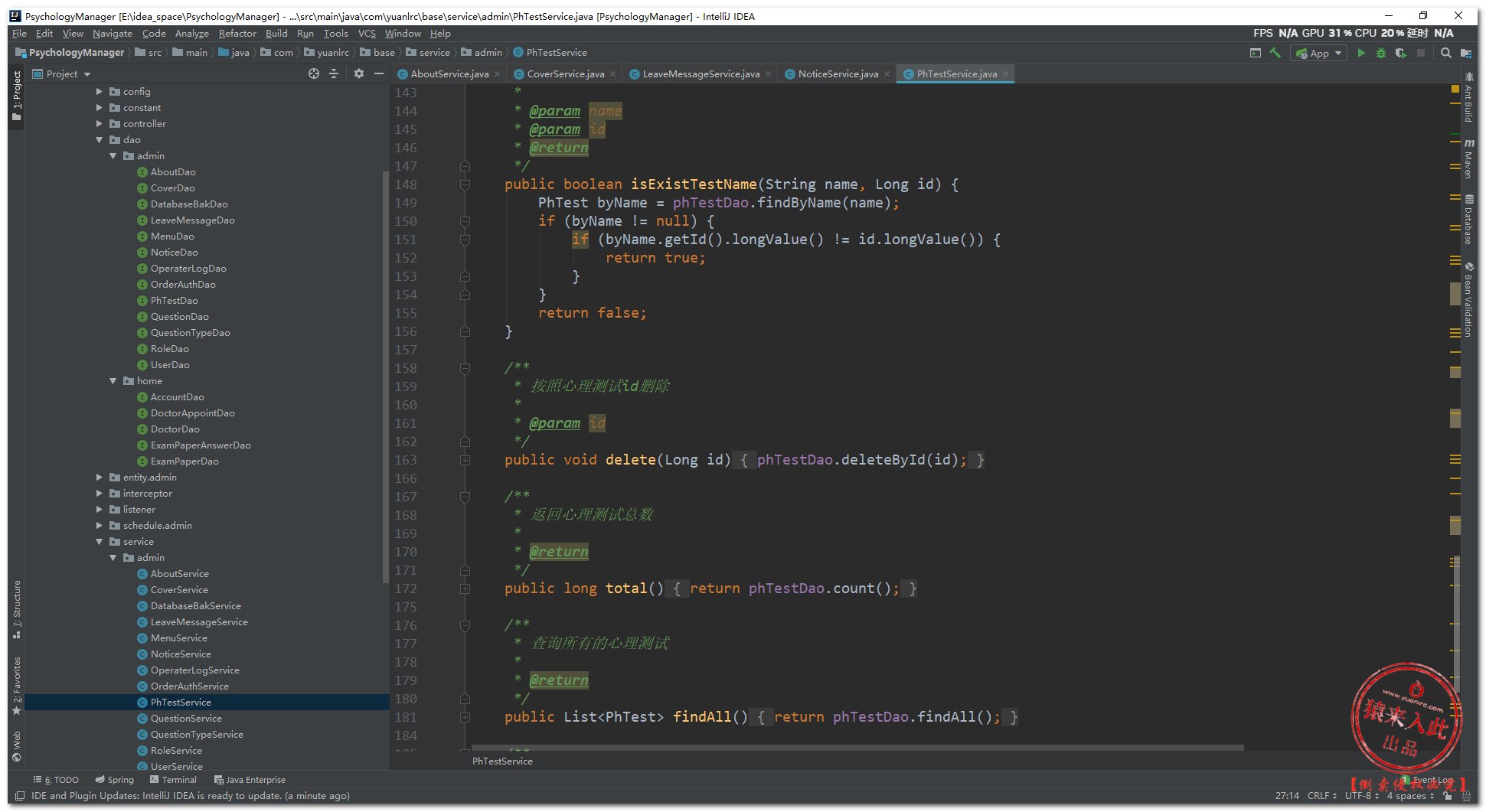

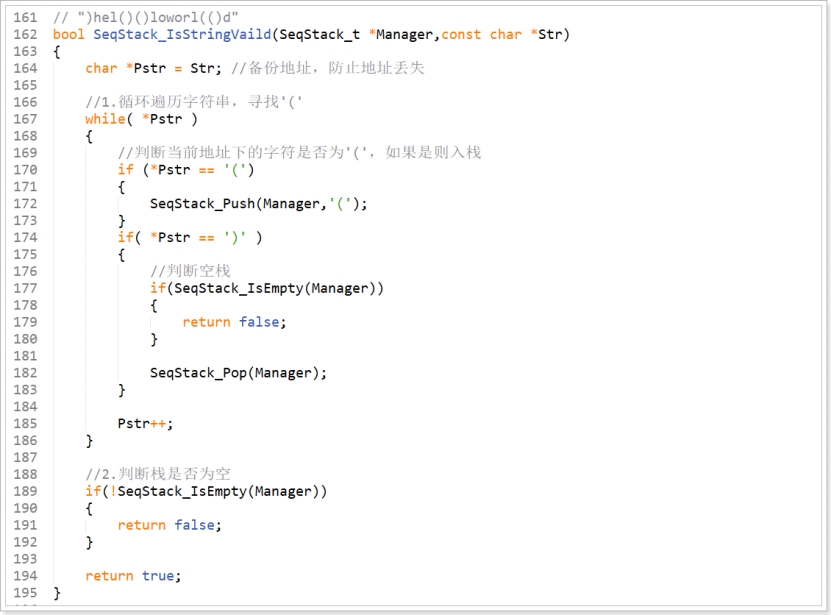

核心代码

import torch

from torch import nnclass EMA(nn.Module):def __init__(self, channels, c2=None, factor=32):super(EMA, self).__init__()self.groups = factor # 分组数,默认为32assert channels // self.groups > 0 # 确保通道数能够被分组数整除self.softmax = nn.Softmax(-1) # 定义 Softmax 层,用于最后一维度的归一化self.agp = nn.AdaptiveAvgPool2d((1, 1)) # 自适应平均池化,将特征图缩小为1x1self.pool_h = nn.AdaptiveAvgPool2d((None, 1)) # 自适应平均池化,保留高度维度,将宽度压缩为1self.pool_w = nn.AdaptiveAvgPool2d((1, None)) # 自适应平均池化,保留宽度维度,将高度压缩为1self.gn = nn.GroupNorm(channels // self.groups, channels // self.groups) # 分组归一化self.conv1x1 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=1, stride=1, padding=0) # 1x1卷积self.conv3x3 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=3, stride=1, padding=1) # 3x3卷积def forward(self, x):b, c, h, w = x.size() # 获取输入张量的尺寸:批次、通道、高度、宽度group_x = x.reshape(b * self.groups, -1, h, w) # 将张量按组重构:批次*组数, 通道/组数, 高度, 宽度x_h = self.pool_h(group_x) # 对高度方向进行池化,结果形状为 (b*groups, c//groups, h, 1)x_w = self.pool_w(group_x).permute(0, 1, 3, 2) # 对宽度方向进行池化,并转置结果形状为 (b*groups, c//groups, 1, w)hw = self.conv1x1(torch.cat([x_h, x_w], dim=2)) # 将池化后的特征在高度方向拼接后进行1x1卷积x_h, x_w = torch.split(hw, [h, w], dim=2) # 将卷积后的特征分为高度特征和宽度特征x1 = self.gn(group_x * x_h.sigmoid() * x_w.permute(0, 1, 3, 2).sigmoid()) # 结合高度和宽度特征,应用分组归一化x2 = self.conv3x3(group_x) # 对重构后的张量应用3x3卷积x11 = self.softmax(self.agp(x1).reshape(b * self.groups, -1, 1).permute(0, 2, 1)) # 对 x1 进行自适应平均池化并应用Softmaxx12 = x2.reshape(b * self.groups, c // self.groups, -1) # 重构 x2 的形状为 (b*groups, c//groups, h*w)x21 = self.softmax(self.agp(x2).reshape(b * self.groups, -1, 1).permute(0, 2, 1)) # 对 x2 进行自适应平均池化并应用Softmaxx22 = x1.reshape(b * self.groups, c // self.groups, -1) # 重构 x1 的形状为 (b*groups, c//groups, h*w)weights = (torch.matmul(x11, x12) + torch.matmul(x21, x22)).reshape(b * self.groups, 1, h, w) # 计算权重,并重构为 (b*groups, 1, h, w)return (group_x * weights.sigmoid()).reshape(b, c, h, w) # 将权重应用于原始张量,并重构为原始输入形状

YOLOv11引入代码

在根目录下的ultralytics/nn/目录,新建一个attention目录,然后新建一个以 EMA_attention为文件名的py文件, 把代码拷贝进去。

task与yaml配置

详见:https://blog.csdn.net/shangyanaf/article/details/143041421

![[63] (多校联训) A层冲刺NOIP2024模拟赛19](https://img2024.cnblogs.com/blog/3389876/202410/3389876-20241013073822955-1536431906.png)