主要是加入先验知识。

朴素:指特征之间独立。

贝叶斯算法是指一类基于贝叶斯定理的算法,用于解决统计分类和推断问题。贝叶斯定理是概率论中的一个定理,它描述了在已知一些条件下,某事件的概率。在机器学习中,贝叶斯算法通常用于处理不确定性,通过已知的先验概率和新的证据来更新我们对某个假设的概率估计。

在机器学习中,贝叶斯分类器是一种基于贝叶斯定理的统计分类方法。最简单的贝叶斯分类器是朴素贝叶斯分类器,它假设特征之间相互独立。朴素贝叶斯分类器的目标是通过已知的先验概率和特征条件概率来计算后验概率,然后选择具有最高后验概率的类别作为预测结果。

当然可以。贝叶斯算法在文本分类中的应用通常是通过朴素贝叶斯分类器来实现的。朴素贝叶斯是一种简单但有效的分类方法,特别是在处理高维数据时,如文本分类问题。下面是一个使用朴素贝叶斯进行文本分类的例子:

假设场景

假设一个包含多个电子邮件的数据库,每封邮件都被标记为“垃圾邮件”或“非垃圾邮件”。我们的任务是创建一个分类器,该分类器能够根据邮件的内容自动判断新邮件是否为垃圾邮件。

数据准备

1.收集数据:收集一定数量的电子邮件作为训练数据集。

2.预处理:对邮件内容进行预处理,包括去除停用词、标点符号、数字等,并将文本转换为单词列表。

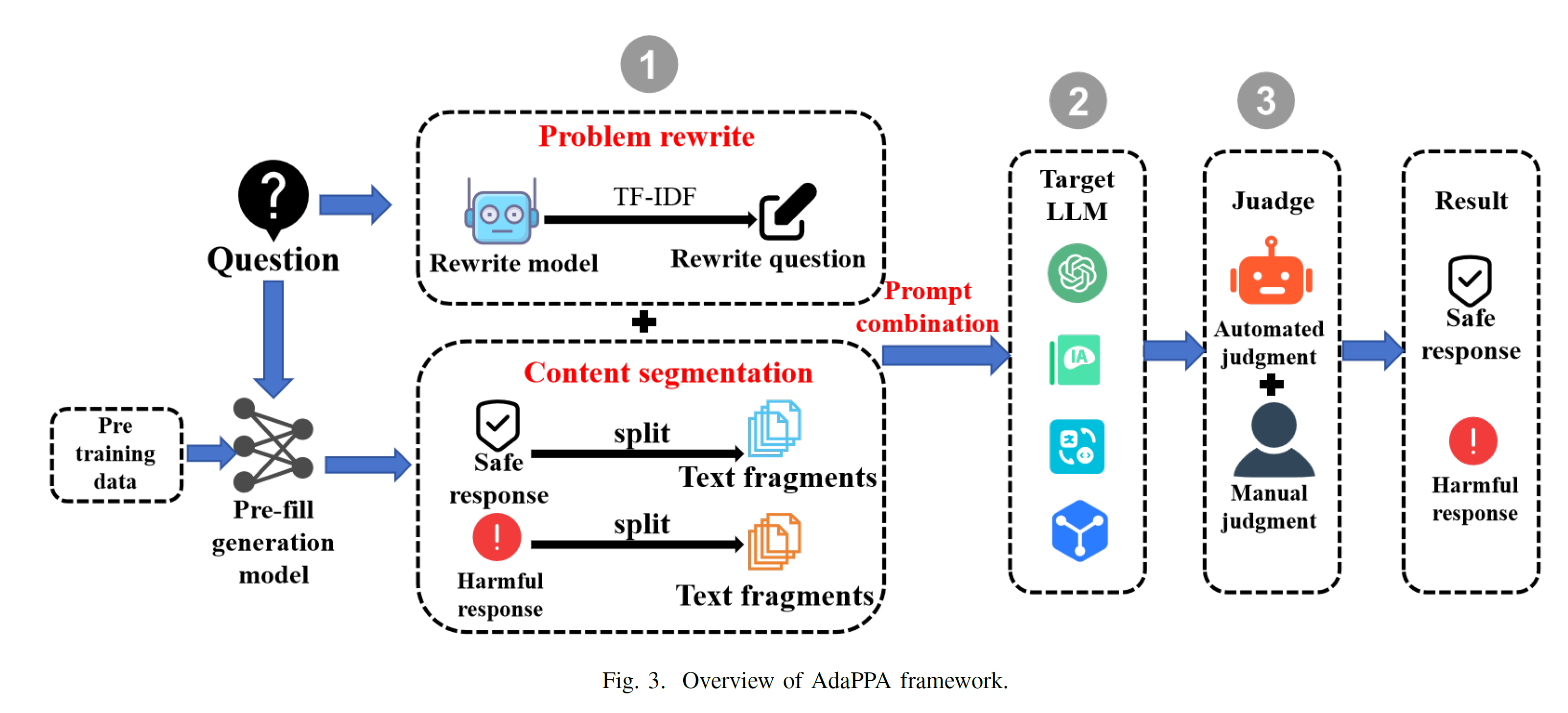

3.特征提取:将每封邮件转换为特征向量。这通常是通过词袋模型(Bag of Words)或TF-IDF(Term Frequency-Inverse Document Frequency)来实现的。

训练分类器

1.计算先验概率:计算每个类别的先验概率 P(垃圾邮件) 和 P(非垃圾邮件})。

2.计算条件概率:对于每个单词,计算在给定类别下的条件概率 $P(\text{单词}| \text{垃圾邮件})$ 和 $P(\text{单词}| \text{非垃圾邮件})$。

3.应用贝叶斯定理:对于新邮件,使用贝叶斯定理计算它属于每个类别的后验概率。

预测

1.特征向量:将新邮件转换为特征向量。

2.概率计算:对于每个类别,使用训练得到的概率模型计算后验概率 $P(\text{类别}| \text{特征向量})$。

3.分类:选择具有最高后验概率的类别作为预测结果。