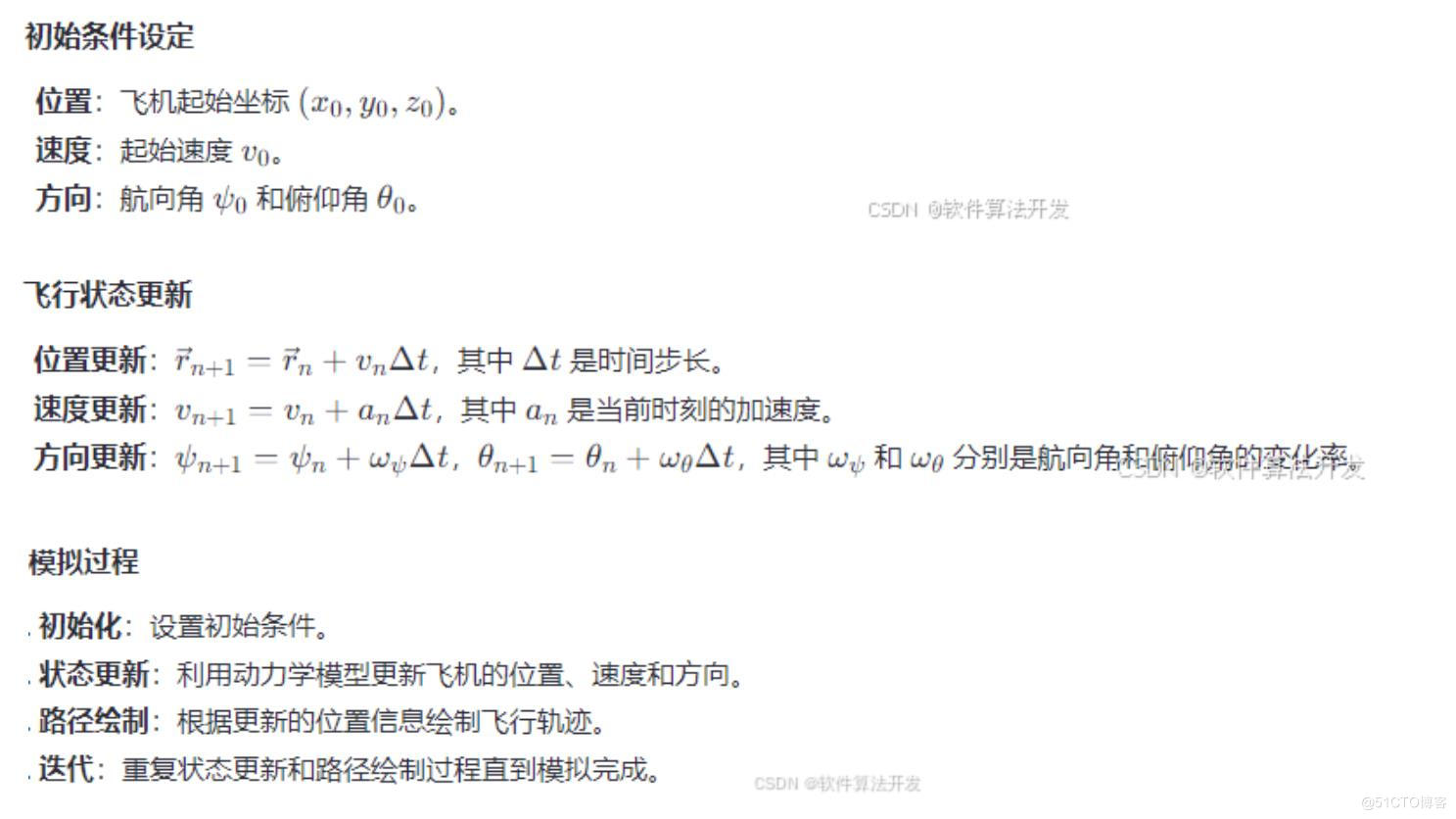

MaxPool2d,全称为二维最大池化层(Max Pooling Layer),是卷积神经网络(CNN)中常用的一种池化(pooling)操作。池化层的主要作用是降低特征图的空间尺寸(即高度和宽度),从而减少模型的参数数量和计算量,同时提高模型对输入变化的鲁棒性。MaxPool2d的工作原理

MaxPool2d通过在输入的特征图上滑动一个固定大小的窗口(称为池化窗口或池化核),并在窗口内选择最大值作为输出。这个过程在特征图的整个空间维度上进行,从而生成一个更小的特征图。MaxPool2d的关键参数

-

kernel_size:

-

池化窗口的大小。例如,

kernel_size=2表示2x2的窗口。 -

常见的选择有2x2、3x3等。

-

-

stride:

-

池化窗口滑动的步长。步长决定了池化窗口在特征图上移动的像素数。

-

默认情况下,

stride等于kernel_size,即每次移动一个窗口的距离。

-

-

padding:

-

填充的大小。填充是在输入特征图的边缘添加零,以控制输出特征图的大小。

-

常见的填充方式有“valid”(无填充)和“same”(输出大小与输入大小相同)。

-

MaxPool2d的优点

-

降低计算量:

-

通过减少特征图的尺寸,可以显著降低后续层的计算量。

-

-

减少过拟合:

-

降低模型的参数数量,有助于减少过拟合的风险。

-

-

提高鲁棒性:

-

池化操作使模型对输入的微小变化(如平移、旋转等)更加鲁棒。

-

-

增加感受野:

-

通过降低特征图的尺寸,可以增加每个神经元的感受野,从而捕捉更大的上下文信息。

-

示例代码(PyTorch)

Python复制

import torch

import torch.nn as nn# 创建一个二维最大池化层

max_pool = nn.MaxPool2d(kernel_size=2, stride=2)# 创建一个随机生成的输入特征图(批次大小为1,3个通道,32x32像素)

input_feature_map = torch.randn(1, 3, 32, 32)# 前向传播

output_feature_map = max_pool(input_feature_map)

print(output_feature_map.shape) # 输出:torch.Size([1, 3, 16, 16])在这个示例中,我们创建了一个

MaxPool2d层,池化窗口大小为2x2,步长为2。输入特征图的尺寸为32x32,经过最大池化操作后,输出特征图的尺寸变为16x16。MaxPool2d是卷积神经网络中常用的池化操作之一,它在图像分类、目标检测、语义分割等计算机视觉任务中发挥着重要作用。

![[AI/GPT/综述] AI Agent的设计模式综述](https://blog-static.cnblogs.com/files/johnnyzen/cnblogs-qq-group-qrcode.gif?t=1679679148)