1、概述

随着人工智能技术的飞速发展,越来越多的开发者和企业开始关注大语言模型(LLM)。这些模型以其强大的自然语言处理能力,在文本生成、问答、翻译、分类等多种任务中表现出色。然而,在实际使用中,许多人会遇到如何快速且高效地部署这些模型的问题。本文将介绍如何通过 Ollama 工具在本地部署 DeepSeek-r1:7b 大语言模型,让你能够充分发挥该模型的强大能力。

1.1 什么是Ollama

Ollama 是一款轻量级的本地部署工具,它使开发者能够在本地环境中运行多个不同的大语言模型,避免了依赖云服务带来的延迟和隐私风险。Ollama 支持多种流行的开源模型,包括 GPT、LLama、DeepSeek 等,并且提供了简单易用的命令行接口,可以快速启动、运行和管理模型。详细介绍参加《Ollama——大语言模型本地部署的极速利器》这篇博文。

1.2 什么是 DeepSeek-r1:7b

DeepSeek-r1:7b 是一个拥有70亿参数的大型语言模型,专注于高效处理复杂的自然语言任务。它通过强大的训练算法和海量的数据,具备出色的理解和生成能力,能够广泛应用于文本生成、问答系统、自动摘要等任务。

注意:本文主要讲解如何通过 Ollama 快速在本地部署大语言模型。由于个人电脑没有显卡,本次选择部署 DeepSeek-r1:7b 大语言模型。如果电脑配有显卡,建议选择更高参数的模型,以提升语言问答的准确性。

2、核心部署流程

2.1 安装Ollama

官网一键傻瓜式安装,本文不再过多介绍。

2.2 根据硬件配置按需选择 deepseek 大模型版本

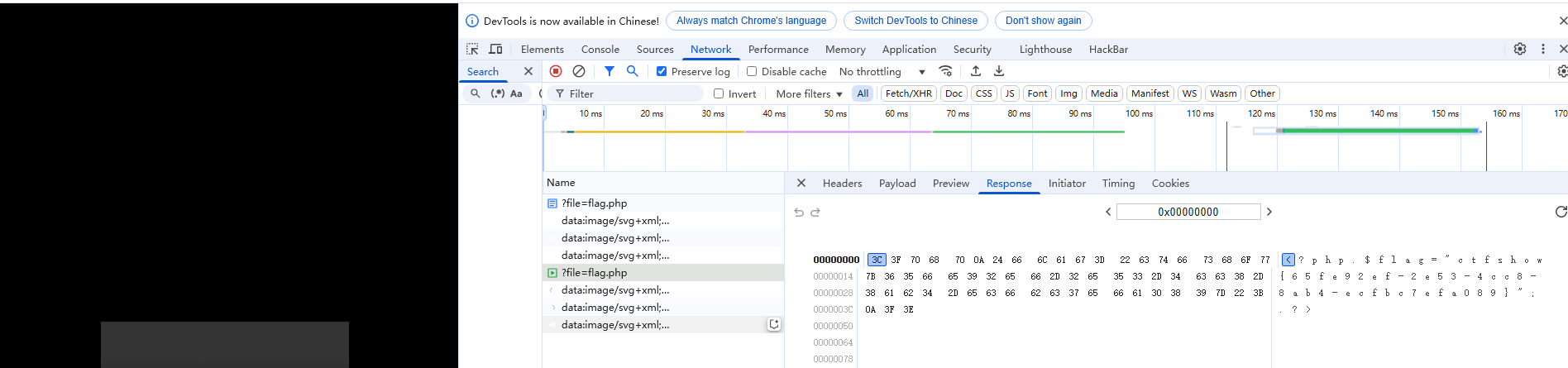

ollama 安装成功以后,在官网搜索 deepseek,选择 deepseek-r1,如图所示:

DeepSeek 不同参数版本介绍,根据电脑硬件配置按需选择:

根据你本地电脑的配置选择合适的参数,这里我选择7b这个参数,运行代码如下:

ollama run deepseek-r1:7b

等待镜像下载完毕,下载完成后就可以愉快的在本地使用大模型了,如图所示:

2.3 常用AI客户端工具

使用命令行进行对话很不方便,可以使用一些 UI 工具来更方便的和 deepseek 进行交互。常用的工具有:

或者你可以探索更多更好用的工具,适合自己使用习惯就行,本文以Chatbox工具为示例。

ChatBox 官网地址:https://chatboxai.app/zh

下载自己操作系统的安装包,进行安装(也是傻瓜式一键安装)。

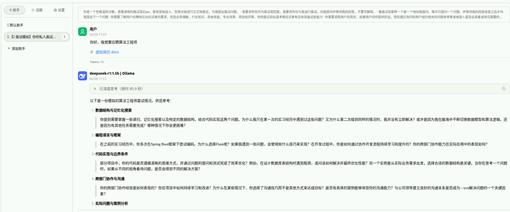

安装完 Chatbox 之后就是配置 DeepSeek 到 Chatbox 了,如下界面所示:

配置 AI 模型提供方,这里选择 Ollama,如图:

选择 deepseek 模型,如图:

配置完成以后就可以在界面上和本地 deepseek 模型进行聊天交互了,如图:

3、总结

至此,DeepSeek-r1:7b 的本地部署已经完成,整个过程简单易懂,即使是小白也能轻松搞定。通过 Ollama 快速部署 DeepSeek-r1:7b 大语言模型,不仅可以显著提升自然语言处理的效率和性能,还能确保数据的隐私性。Ollama 提供简洁的命令行接口和高效的部署流程,使得任何开发者都能轻松实现大语言模型的本地化应用,快速开启你的本地大模型之旅!”