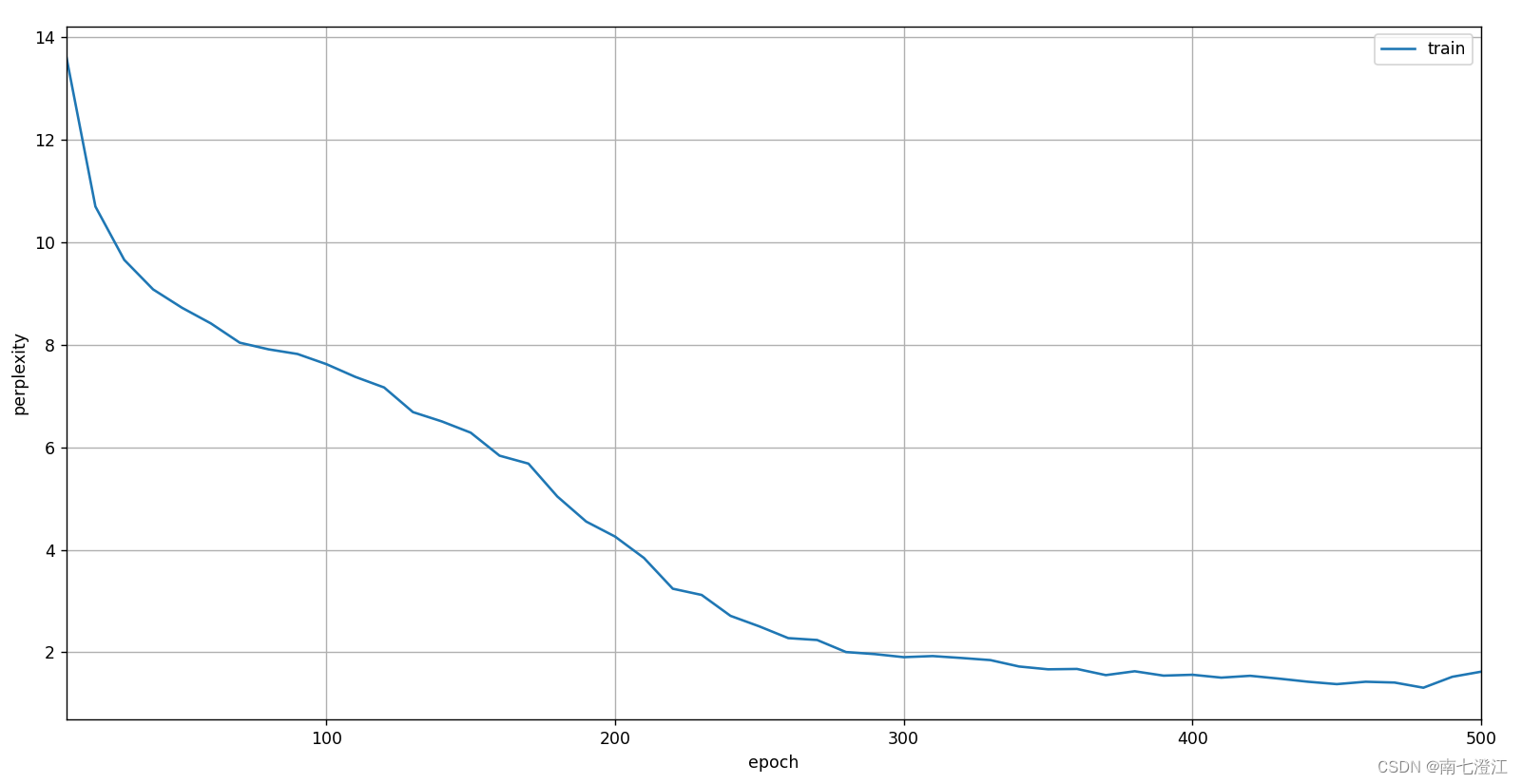

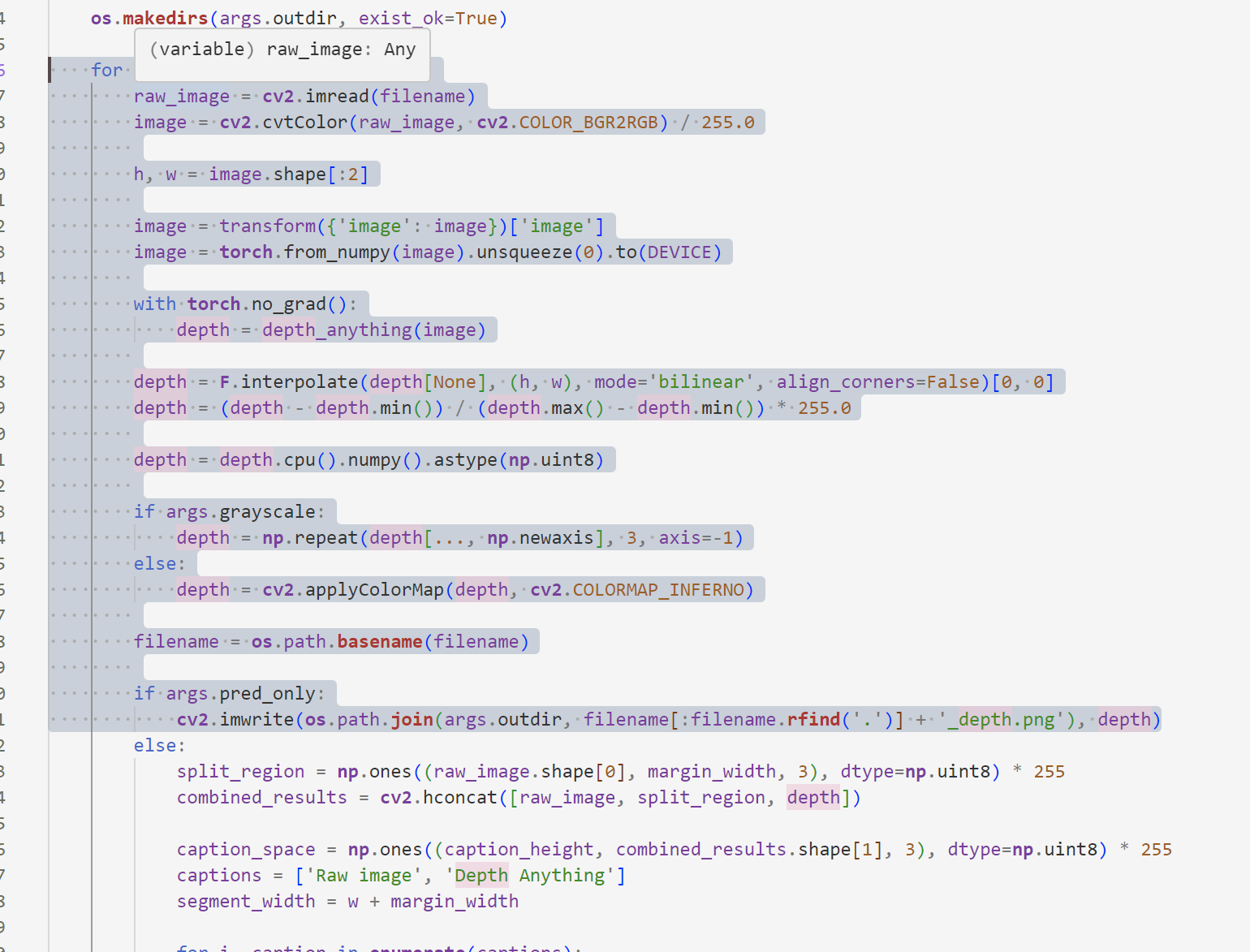

这是Depth Anything的深度值depth,这个depth通过depth = depth_anything(image)求得。

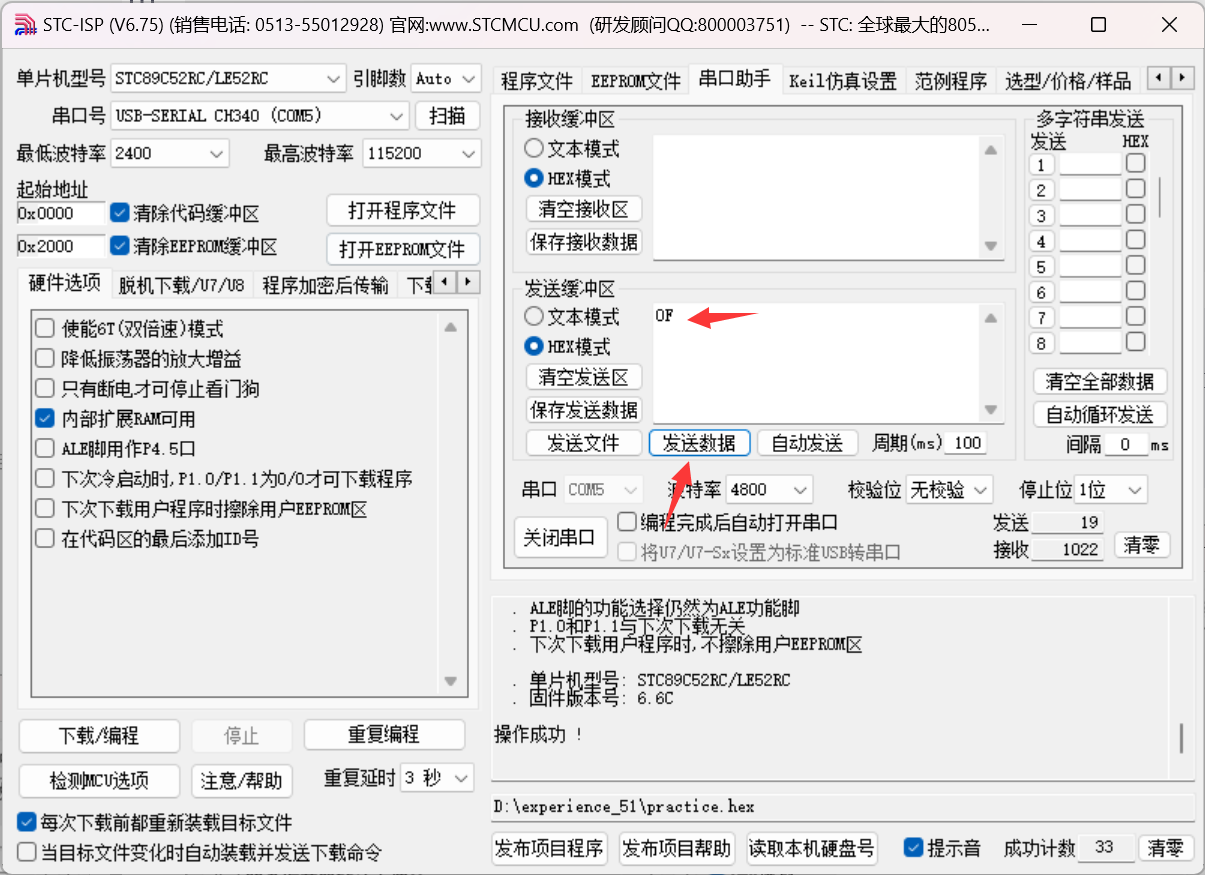

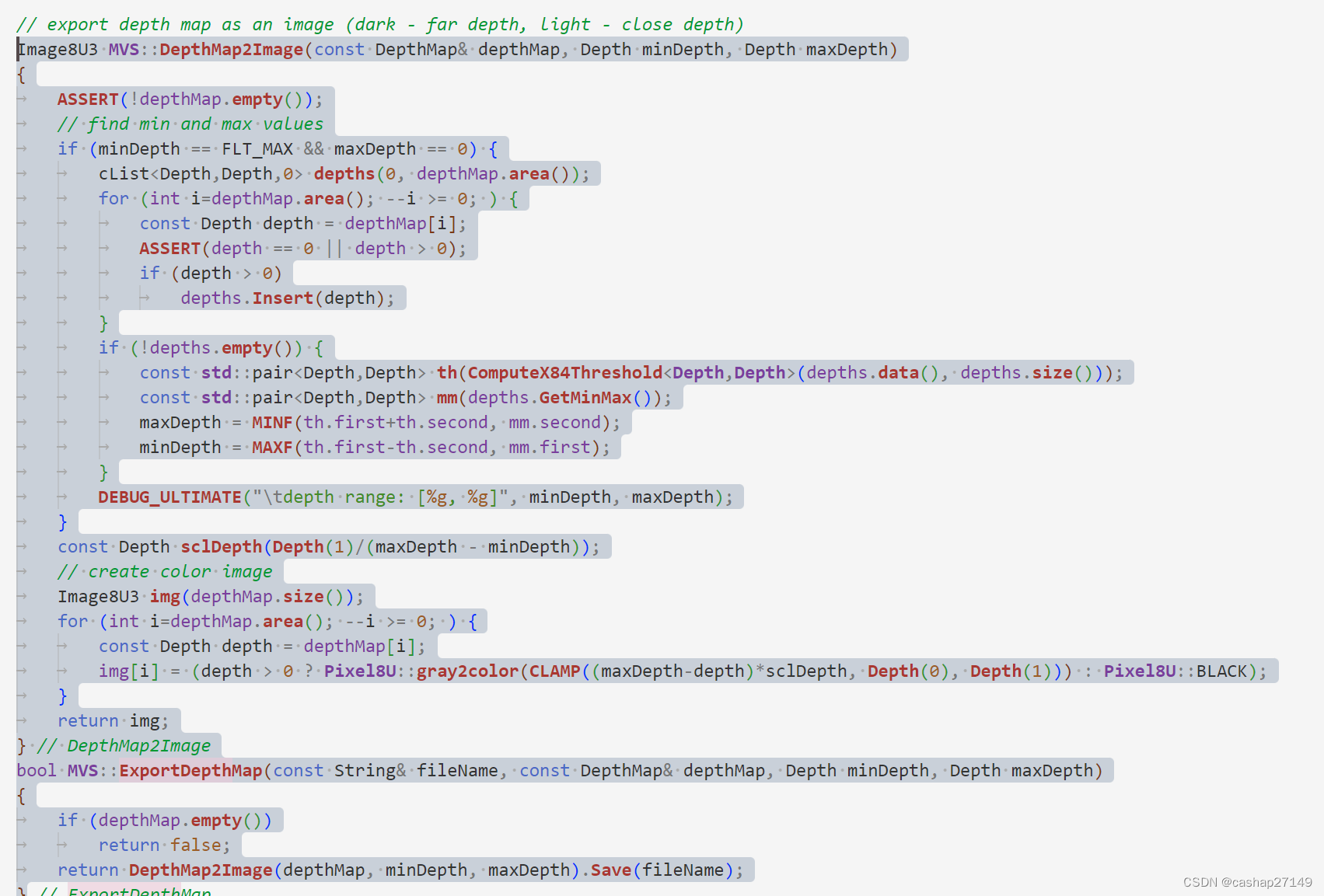

但想要把这个深度值depth嵌入到三维重建算法框架中,并不是一件容易得事情,拿OpenMVS举例,下图是OpenMVS输出深度图的函数。

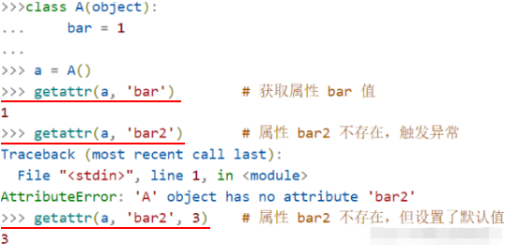

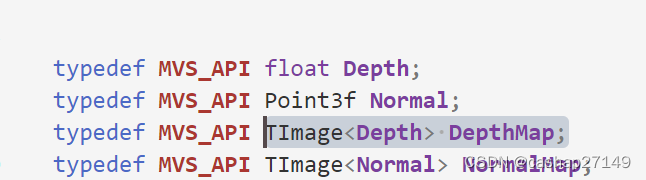

OpenMVS的深度值保存在depthMap中,我们来看看depthMap的具体结构,可以看到OpenMVS使用TImage模板类实例化为Depth类型的深度图:

Depth Anything只是简单的将图片的深度值放到一个列表中,没有给出其他信息,想要把其求得的深度值衔接到OpenMVS(或者其他MVS算法),需要对MVS算法 有特别深的理解,而且MVS算法其实还需要法向量信息,只是单纯地给个深度值,但法向量随机取值?这样经过OpenMVS算法得到的点云可能效果并没有多大提升。

我们完全可以针对OpenMVS本身去做改进,把Depth Anything算法,或者一些其他的SOTA算法里面的可取之处(创新点)放入OpenMVS算法或者其他主流MVS算法中,没必要直接生搬硬套Depth Anything算法的结果。

另外,我试过使用OpenMVS算法去三维建模,效果很不错,我想在此基础上,结合最新的论文思路改进OpenMVS。

![[office] Excel表格中自动添加的超连接怎么取消? #媒体#其他#知识分享](https://img-blog.csdnimg.cn/img_convert/4c83c23a2e39f1d24ad1526ed5af5b2a.jpeg)