2月16日凌晨,OpenAI发布了文生视频模型Sora。官方是这样描述的:Sora is an AI model that can create realistic and imaginative scenes from text instructions.Sora一个人工智能模型,它可以根据文本指令创建逼真和富有想象力的场景。Sora能够在同时保持视觉质量和遵循用户提示的情况下,生成长达一分钟的视频。Sora 与 ChatGPT 一样采用 Transformer 架构,并使用了 DALL-E 3 中的重述技术。除了文本生成视频之外,Sora 还能根据图像生成视频,并能准确地对图像内容进行动画处理。也能提取视频中的元素,对其进行扩展或填充缺失的帧。

几乎在同一时间,OpenAI也发布了关于Sora相关的技术报告:《Video generation models as world simulators》视频生成模型:构建虚拟世界的模拟器,这篇技术报告的侧重点在于将所有类型的视觉数据转化为统一表示的方法,该方法能够对生成模型进行大规模训练,以及对Sora的能力和局限性进行定性评估,而Sora的模型和实现细节未包含在报告中。

很多的权威媒体或自媒体过分夸大了“Sora的威力”,各种标题党层出不穷,但我认为Sora到目前为止仅为视频生成提供一种新的解决方案,就像ChatGPT,将来作为一种工具服务于人类,而不必过分夸大。对于所处这个行业的技术人员,应该跟随这个趋势,研究Sora的内涵,追赶前沿技术。

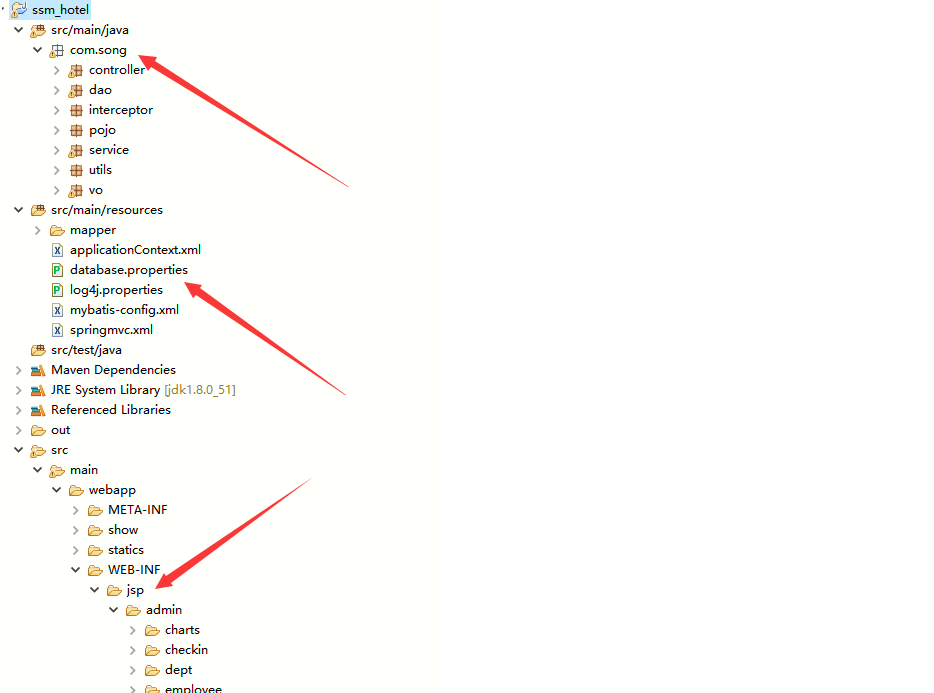

具体的我们看一下报告的内容。报告中指出,人们已经使用各种方法研究了视频数据的生成建模,包括循环网络(recurrent networks)、生成对抗网络(generative adversarial networks)、自回归变换器(autoregressive transformers)和扩散模型(diffusion models)。这些工作通常集中在视觉数据的狭窄类别、较短的视频或固定大小的视频上。Sora是一个视觉数据的通用模型——它可以生成跨越不同时长、宽高比和分辨率的视频和图像,最长可达一分钟的高清视频。以下为报告引用的一些学术研究文章。

我们来看看文生视频的原理:

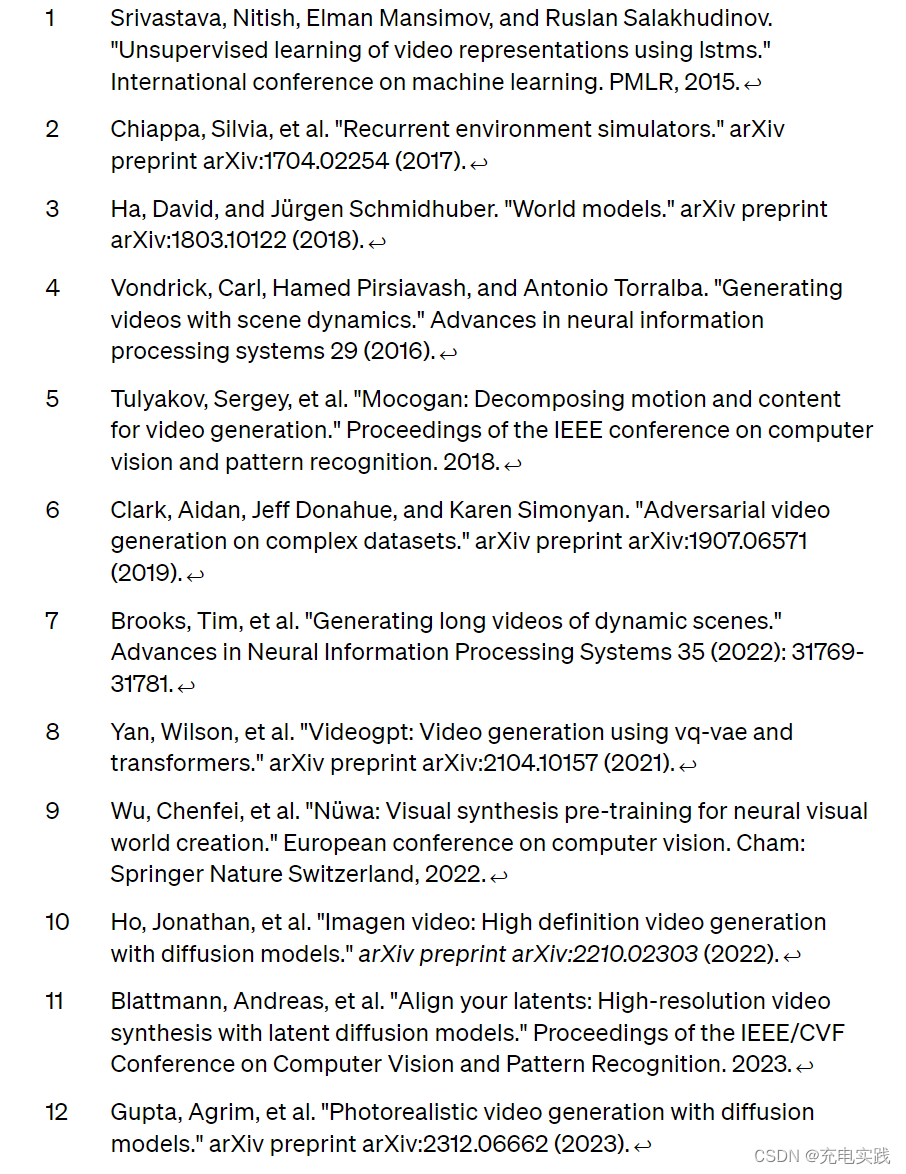

1.将视觉数据转化为图块(patch)

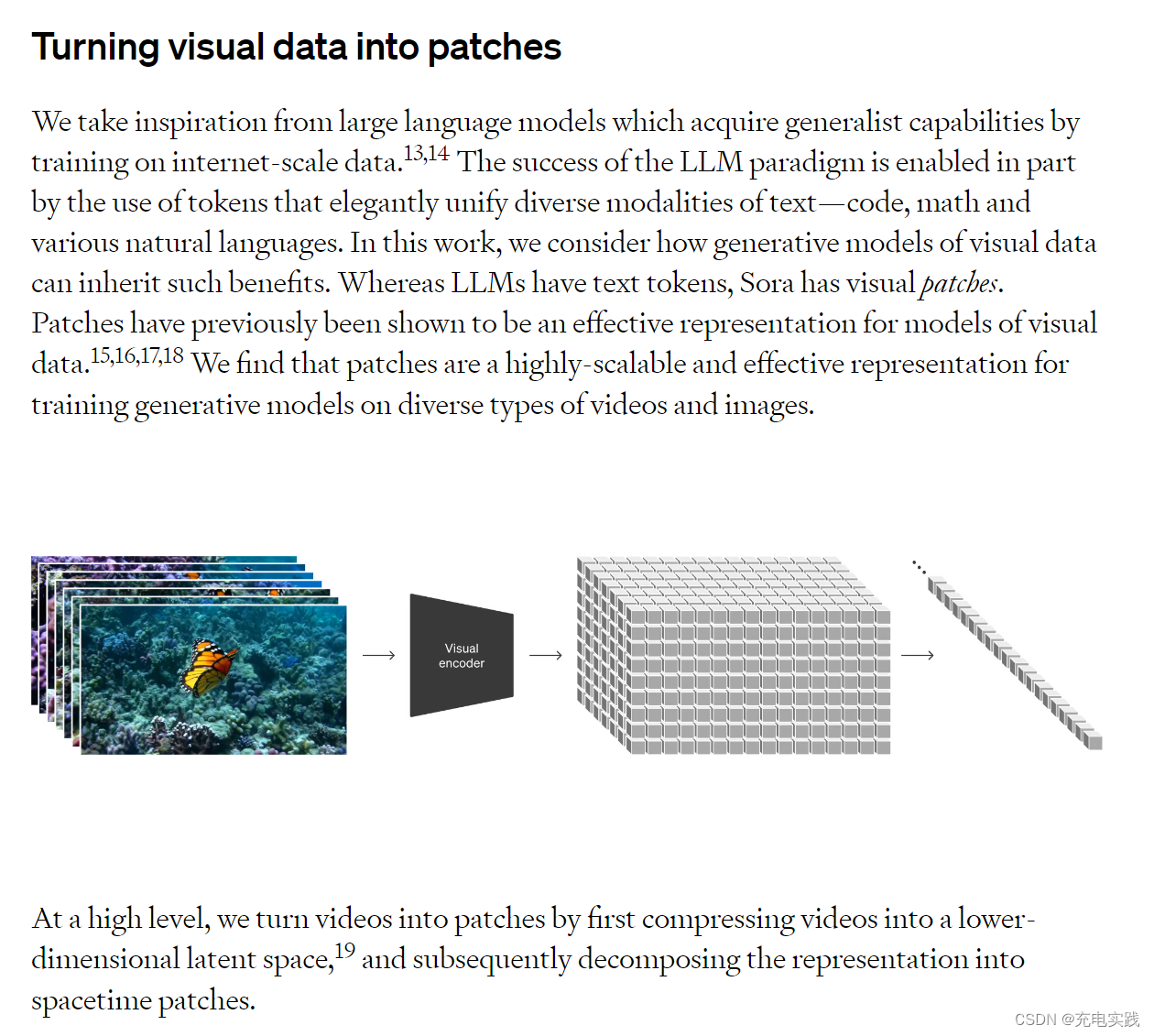

我们从大型语言模型中获得灵感,这些模型通过在互联网规模数据上训练获得通用能力。大型语言模型的成功在一定程度上得益于使用能够统一文本的多样化(如代码、数学和各种自然语言)的标记。在这项工作中,我们考虑视觉数据的生成模型如何继承这些优势。与大型语言模型拥有文本标记一样,Sora拥有视觉图块。先前的研究已经表明,图块是视觉数据模型的一种有效表示。我们发现,图块是一种高度可扩展且有效的表示,用于在各种类型的视频和图像上训练生成模型。

参考文献如下:

2.训练一个降低视觉数据维度的网络

3.时空潜在图块处理

基于patch,使得Sora能够训练不同分辨率、持续时间和宽高比的视频和图像。在推理时,通过在适当大小的网格中排列随机初始化的patches来控制生成视频的大小。

在图像和视频生成的早期方法中,通常会将视频调整大小、裁剪或修剪到标准大小——例如,4秒长的视频,分辨率为256x256。但是如果直接在原始数据上进行训练有几个好处:

(1)采样灵活性

Sora能够采样宽屏1920x1080p视频、竖屏1080x1920p视频以及介于两者之间的所有内容。它还允许我们在生成全分辨率内容之前,快速原型设计较小尺寸的内容——所有这些都使用同一个模型。

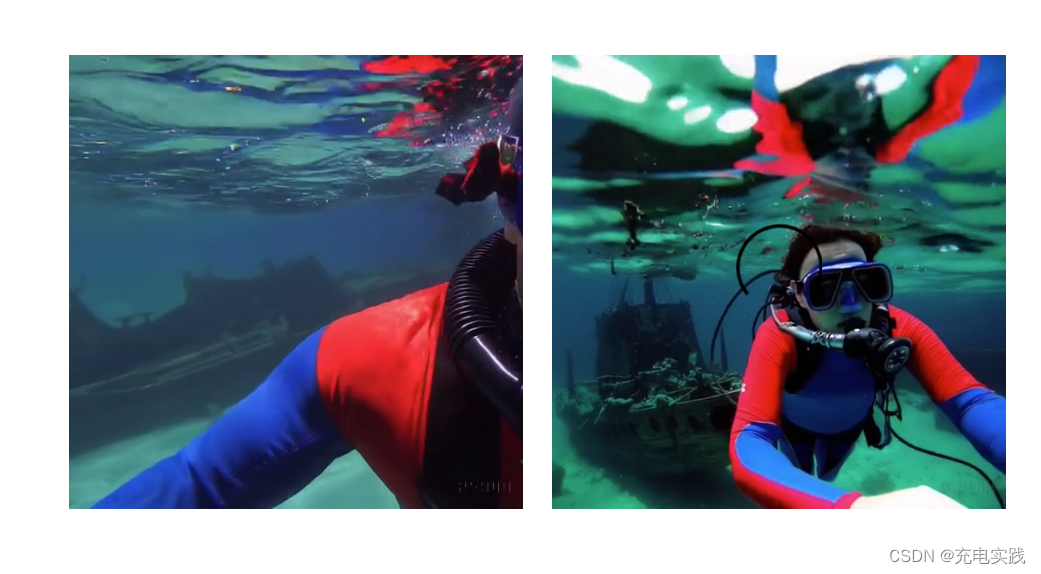

(2)提高了构图和布局

通过实证发现,在其原生宽高比上训练视频能够改进构图和布局。将Sora与模型的另一个版本进行比较,该版本将所有训练视频裁剪为正方形,这是训练生成模型时的常见做法。在正方形裁剪上训练的模型(左侧)有时会生成主题只部分可见的视频。相比之下,Sora的视频(右侧)具有改进的构图。

4.语言理解

训练文本到视频生成系统需要大量带有对应文本标题的视频。Sora应用了在DALL-E 3中引入的重新标题技术(re-captioning technique)到视频上。首先训练一个高度描述性的标题生成模型,然后使用它为我们训练集中的所有视频生成文本标题。基于高度描述性视频标题的训练提高了文本保真度以及视频的整体质量。

Sora除了能够实现文本到视频的输出,也可以通过其他输入,如预先存在的图像或视频,来进行提示。这种能力使得Sora能够执行广泛的图像和视频编辑任务——创建完美循环的视频、为静态图像添加动画、向前或向后扩展视频等。

挑选了官网有意思的两个demo,其一个视频截图体现了视频连接:

另外一个视频体现了视频编辑:

当然Sora目前还存在许多局限性。例如,它不能准确地仿真许多基本交互的物理,如玻璃破碎。其他交互,如吃食物,并不总是产生正确的物体状态变化。报告中也列举了模型的其他常见失败模式——例如,长时间样本中发展出的不连贯性或物体的自发出现。

![写一个程序,输入数量不确定的[0,9]范围内的整数,统计每一种数字出现的次数输入-1表示结束](https://img-blog.csdnimg.cn/direct/e87514bd7a404b4fb5e3fa0ca874f706.png)