- 卷积神经网络(CNN)

- 卷积神经网络原理

- 卷积神经网络的数学推导

- 卷积层反向传播算法数学推导

- 卷积层实现代码

卷积神经网络(CNN)

卷积神经网络原理

卷积神经网络是一种用于图像、语音、自然语言等数据的深度学习模型,其核心思想是使用卷积操作提取输入数据的特征,从而实现数据分类、目标检测、图像分割等任务。

卷积操作是卷积神经网络的核心操作,它通过卷积核(也称为滤波器)对输入数据进行卷积运算,提取出输入数据的特征。具体来说,卷积操作对于每个位置,将卷积核中的值与输入数据的对应位置相乘,然后将所有乘积相加得到输出数据的对应位置的值。卷积核的大小、步长和填充方式都可以影响卷积操作的输出结果。

卷积神经网络通常包括卷积层、池化层、全连接层等多个层次。卷积层用于提取输入数据的特征,通过多个卷积核进行卷积操作,得到多个特征图(feature map)。池化层用于降低特征图的空间分辨率,减少计算量和参数数量。全连接层用于将特征图映射到目标类别,通常包含多个神经元,并使用softmax函数进行输出。

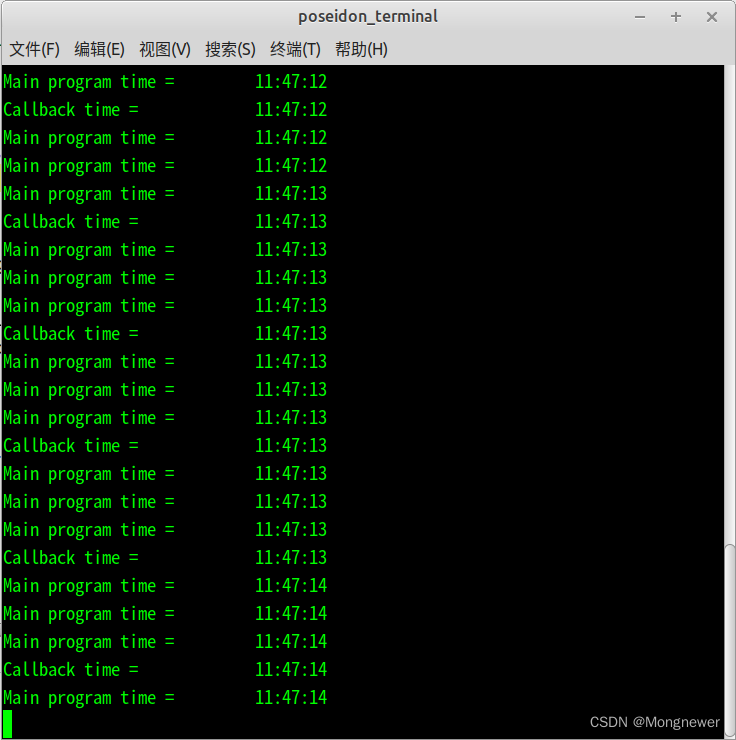

卷积神经网络在训练过程中通常使用反向传播算法进行梯度下降优化。反向传播算法可以通过将目标函数的梯度反向传递回网络中的每个神经元,计算每个神经元的梯度,并使用梯度下降更新网络参数,从而最小化目标函数。

卷积神经网络的数学推导

卷积神经网络(CNN)的核心操作是卷积(convolution),卷积的本质是信号处理中的一种数学运算,将两个函数进行叠加并积分,得到一个新的函数。

在CNN中,卷积的输入是一个二维矩阵(通常是图像)和一个卷积核(也称为滤波器)。卷积核是一个小的二维矩阵,大小通常为3x3或5x5,其内部的数值是需要通过训练学习得到的。

下面是卷积的数学推导过程:

设输入矩阵为 X ∈ R H × W X\in R^{H\times W} X∈RH×W,卷积核为 K ∈ R K h × K w K\in R^{K_h\times K_w} K∈RKh×Kw,其中 H H H表示矩阵的高度, W W W表示矩阵的宽度, K h K_h Kh表示卷积核的高度, K w K_w Kw表示卷积核的宽度。

在进行卷积操作时,将卷积核沿着输入矩阵的每个位置进行滑动,对应位置的元素相乘并相加,得到输出矩阵 Y ∈ R ( H − K h + 1 ) × ( W − K w + 1 ) Y\in R^{(H-K_h+1)\times(W-K_w+1)} Y∈R(H−Kh+1)×(W−Kw+1)。具体来说,输出矩阵 Y Y Y的第 i i i行第 j j j列的元素为:

y i , j = ∑ m = 1 K h ∑ n = 1 K w x i + m − 1 , j + n − 1 k m , n y_{i,j}=\sum\limits_{m=1}^{K_h}\sum\limits_{n=1}^{K_w}x_{i+m-1,j+n-1}k_{m,n} yi,j=m=1∑Khn=1∑Kwxi+m−1,j+n−1km,n

其中, x i + m − 1 , j + n − 1 x_{i+m-1,j+n-1} xi+m−1,j+n−1表示输入矩阵 X X X的第 i + m − 1 i+m-1 i+m−1行第 j + n − 1 j+n-1 j+n−1列的元素, k m , n k_{m,n} km,n表示卷积核 K K K的第 m m m行第 n n n列的元素。

需要注意的是,在卷积操作时通常还会进行填充(padding)和步长(stride)的设置。填充是在输入矩阵的边缘添加一些额外的元素,使得卷积操作后输出矩阵的大小与输入矩阵相同;步长是在滑动卷积核时的间隔,可以控制输出矩阵的大小。

卷积神经网络通常会在卷积层后加入激活函数,如ReLU函数,来增加非线性能力。此外,卷积神经网络还可以通过池化(pooling)层来减小特征图的大小,从而减少计算量和参数数量。池化层通常采用最大池化(max pooling)或平均池化(average pooling)操作,对每个特征图的每个小区域进行取最大值或取平均值的操作,从而得到更小的特征图。

卷积神经网络的数学推导主要是通过卷积操作、激活函数和池化操作实现。在卷积神经网络中,每个卷积层通常包含多个卷积核,每个卷积核对应一个特征图(也称为卷积映射)。因此,每个卷积层输出的是多个特征图,这些特征图可以进一步传递到下一层进行计算。

在进行卷积神经网络的训练过程中,通常采用反向传播算法(backpropagation)来求解模型参数。反向传播算法基于梯度下降的思想,通过计算损失函数对模型参数的偏导数(梯度),从而不断更新模型参数,使得模型能够更好地拟合训练数据。

总之,卷积神经网络的数学推导涉及到卷积操作、激活函数和池化操作,这些操作是卷积神经网络的核心。在进行训练时,通常采用反向传播算法来求解模型参数,从而使得模型能够更好地拟合训练数据。

卷积层反向传播算法数学推导

卷积层反向传播算法是卷积神经网络中最为核心的算法之一,其目的是求解每个卷积核的权重参数和偏置项的梯度,从而进行模型参数的更新。

卷积层反向传播算法的数学推导主要分为两个步骤:前向传播和反向传播。前向传播通过卷积操作和激活函数对输入数据进行处理,得到输出数据;反向传播根据误差对输出数据的梯度,利用卷积操作对输入数据的梯度进行计算,进而求解每个卷积核的梯度。

下面是卷积层反向传播算法的数学推导:

假设输入数据为 X X X,卷积核为 W W W,偏置项为 b b b,输出数据为 Y Y Y。其中, X X X 和 W W W 的维度分别为 C i n × H i n × W i n C_{in} \times H_{in} \times W_{in} Cin×Hin×Win 和 C o u t × C i n × K h × K w C_{out} \times C_{in} \times K_h \times K_w Cout×Cin×Kh×Kw, Y Y Y 的维度为 C o u t × H o u t × W o u t C_{out} \times H_{out} \times W_{out} Cout×Hout×Wout。 K h K_h Kh 和 K w K_w Kw 分别表示卷积核的高度和宽度, H o u t H_{out} Hout 和 W o u t W_{out} Wout 分别表示输出数据的高度和宽度。

前向传播的数学表达式为:

Y k , i , j = σ ( ∑ c = 1 C i n ∑ p = 1 K h ∑ q = 1 K w X c , i + p − 1 , j + q − 1 W k , c , p , q + b k ) Y_{k,i,j}=\sigma(\sum_{c=1}^{C_{in}}\sum_{p=1}^{K_h}\sum_{q=1}^{K_w}X_{c,i+p-1,j+q-1}W_{k,c,p,q}+b_k) Yk,i,j=σ(c=1∑Cinp=1∑Khq=1∑KwXc,i+p−1,j+q−1Wk,c,p,q+bk)

其中, σ \sigma σ 表示激活函数。这里使用了 k k k、 i i i、 j j j 分别表示第 k k k 个特征图、第 i i i 行、第 j j j 列的像素点。通过前向传播,我们可以得到输出数据 Y Y Y。

反向传播的数学表达式为:

∂ L ∂ X c , i , j = ∑ k = 1 C o u t ∑ p = 1 K h ∑ q = 1 K w W k , c , p , q ∂ L ∂ Y k , i + p − 1 , j + q − 1 \frac{\partial L}{\partial X_{c,i,j}}=\sum_{k=1}^{C_{out}}\sum_{p=1}^{K_h}\sum_{q=1}^{K_w}W_{k,c,p,q}\frac{\partial L}{\partial Y_{k,i+p-1,j+q-1}} ∂Xc,i,j∂L=k=1∑Coutp=1∑Khq=1∑KwWk,c,p,q∂Yk,i+p−1,j+q−1∂L

∂ L ∂ W k , c , p , q = ∑ i = 1 H o u t ∑ j = 1 W o u t X c , i + p − 1 , j + q − 1 ∂ L ∂ Y k , i , j \frac{\partial L}{\partial W_{k,c,p,q}}=\sum_{i=1}^{H_{out}}\sum_{j=1}^{W_{out}}X_{c,i+p-1,j+q-1}\frac{\partial L}{\partial Y_{k,i,j}} ∂Wk,c,p,q∂L=i=1∑Houtj=1∑WoutXc,i+p−1,j+q−1∂Yk,i,j∂L

∂ L ∂ b k = ∑ i = 1 H o u t ∑ j = 1 W o u t ∂ L ∂ Y k , i , j \frac{\partial L}{\partial b_k}=\sum_{i=1}^{H_{out}}\sum_{j=1}^{W_{out}}\frac{\partial L}{\partial Y_{k,i,j}} ∂bk∂L=i=1∑Houtj=1∑Wout∂Yk,i,j∂L

其中, L L L 表示损失函数。通过反向传播,我们可以求解出每个卷积核的梯度,从而进行模型参数的更新。

解释一下上述公式的含义:

首先,由于卷积操作是可微分的,因此可以通过链式法则来求解输入数据 X X X 的梯度。假设 L L L 表示损失函数,则 Y Y Y 对 L L L 的梯度为 ∂ L ∂ Y k , i , j \frac{\partial L}{\partial Y_{k,i,j}} ∂Yk,i,j∂L,因此可以通过卷积操作来计算 X X X 对 L L L 的梯度。

反向传播中第一个公式表示, X c , i , j X_{c,i,j} Xc,i,j 对 L L L 的梯度等于所有输出数据 Y k , i + p − 1 , j + q − 1 Y_{k,i+p-1,j+q-1} Yk,i+p−1,j+q−1 对 L L L 的梯度乘以对应的权重 W k , c , p , q W_{k,c,p,q} Wk,c,p,q 的和。其中, k k k 取遍所有特征图, p p p 和 q q q 分别表示卷积核在 H H H 和 W W W 方向上的偏移量。

反向传播中第二个公式表示, W k , c , p , q W_{k,c,p,q} Wk,c,p,q 对 L L L 的梯度等于所有输入数据 X c , i + p − 1 , j + q − 1 X_{c,i+p-1,j+q-1} Xc,i+p−1,j+q−1 对 L L L 的梯度乘以对应的输出数据 Y k , i , j Y_{k,i,j} Yk,i,j 的和。同样地, k k k 取遍所有特征图, i i i 和 j j j 分别表示输出数据在 H H H 和 W W W 方向上的偏移量。(解释与公式矛盾)

反向传播中第三个公式表示, b k b_k bk 对 L L L 的梯度等于所有输出数据 Y k , i , j Y_{k,i,j} Yk,i,j 对 L L L 的梯度的和。

在实际应用中,通常会采用基于梯度下降的优化算法来进行模型参数的更新。在卷积层反向传播算法中,可以通过上述公式计算出每个卷积核的梯度,然后利用梯度下降算法对模型参数进行更新,从而提高模型的性能。

卷积层实现代码

下面是一个使用 NumPy 实现的简单 Conv2d 类的示例代码:

import numpy as npclass Conv2d:def __init__(self, in_channels, out_channels, kernel_size, stride=1, padding=0, bias=True):self.in_channels = in_channelsself.out_channels = out_channelsself.kernel_size = kernel_sizeself.stride = strideself.padding = paddingself.bias = bias# 初始化卷积核和偏置项self.weights = np.random.randn(out_channels, in_channels, kernel_size, kernel_size)self.bias_values = np.zeros(out_channels)def forward(self, x):# 计算输出大小out_h = int((x.shape[2] + 2*self.padding - self.kernel_size) / self.stride + 1)out_w = int((x.shape[3] + 2*self.padding - self.kernel_size) / self.stride + 1)# 对输入数据进行填充x = np.pad(x, [(0, 0), (0, 0), (self.padding, self.padding), (self.padding, self.padding)], mode='constant')# 初始化输出数据output = np.zeros((x.shape[0], self.out_channels, out_h, out_w))# 对每个通道进行卷积操作for i in range(self.out_channels):# 对每个像素进行卷积操作for h in range(out_h):for w in range(out_w):# 计算卷积结果conv = np.sum(x[:, :, h*self.stride:h*self.stride+self.kernel_size, w*self.stride:w*self.stride+self.kernel_size] * self.weights[i, :, :, :], axis=(1,2,3))# 加上偏置项conv += self.bias_values[i]# 存储卷积结果output[:, i, h, w] = convreturn output

这个示例实现了一个简单的 Conv2d 类,其构造函数接受输入通道数、输出通道数、卷积核大小、步长、填充和偏置项等参数。在构造函数中,我们随机初始化了卷积核和偏置项。

forward 函数接受输入数据 x,并根据卷积核大小、步长和填充对输入数据进行填充。然后,我们对每个通道和每个像素进行卷积操作,并将结果存储在输出数据中。在卷积操作中,我们使用 NumPy 的数组乘法和求和操作实现了卷积运算,并加上了偏置项。