目录

1.调度约束

调度过程

指定调度节点

查看详细事件

获取标签帮助

修改成 nodeSelector 调度方式

2.亲和性

节点亲和性

Pod 亲和性

键值运算关系

硬策略

软策略

Pod亲和性与反亲和性

创建一个标签为 app=myapp01 的 Pod

使用 Pod 亲和性调度,创建多个 Pod 资源

使用 Pod 反亲和性调度

3.污点(Taint) 和 容忍(Tolerations)

污点(Taint)

容忍(Tolerations)

4.Pod启动阶段(相位 phase)

phase 的可能状态有

如何删除 Unknown 状态的 Pod

5.故障排除步骤

6.总结

scheduler的调度策略

标签的管理操作

如何指定node节点调度Pod

Pod的3种亲和性

如何判断node节点是否在同一个拓扑域

亲和性的2种策略

污点的管理操作

Pod的启动过程

Pod生命周期的5种状态

K8S常见的排障手段

1.调度约束

- Kubernetes 是通过 List-Watch 的机制进行每个组件的协作,保持数据同步的,每个组件之间的设计实现了解耦。

- 用户是通过 kubectl 根据配置文件,向 APIServer 发送命令,在 Node 节点上面建立 Pod 和 Container。

- APIServer 经过 API 调用,权限控制,调用资源和存储资源的过程,实际上还没有真正开始部署应用。这里 需要 Controller Manager、Scheduler 和 kubelet 的协助才能完成整个部署过程。

- 在 Kubernetes 中,所有部署的信息都会写到 etcd 中保存。实际上 etcd 在存储部署信息的时候,会发送 Create 事件给 APIServer,而 APIServer 会通过监听(Watch)etcd 发过来的事件。其他组件也会监听(Watch)APIServer 发出来的事件。

Pod 是 Kubernetes 的基础单元,Pod 启动典型创建过程如下:

- 这里有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。 他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

- 用户通过 kubectl 或其他 API 客户端提交请求给 APIServer 来建立一个 Pod 对象副本。

- APIServer 尝试着将 Pod 对象的相关元信息存入 etcd 中,待写入操作执行完成,APIServer 即会返回确认信息至客户端。

- 当 etcd 接受创建 Pod 信息以后,会发送一个 Create 事件给 APIServer。

- 由于 Controller Manager 一直在监听(Watch,通过https的6443端口)APIServer 中的事件。此时 APIServer 接受到了 Create 事件,又会发送给 Controller Manager。

- Controller Manager 在接到 Create 事件以后,调用其中的 Replication Controller 来保证 Node 上面需要创建的副本数量。一旦副本数量少于 RC 中定义的数量,RC 会自动创建副本。总之它是保证副本数量的 Controller(PS:扩容缩容的担当)。

- 在 Controller Manager 创建 Pod 副本以后,APIServer 会在 etcd 中记录这个 Pod 的详细信息。例如 Pod 的副本数,Container 的内容是什么。

- 同样的 etcd 会将创建 Pod 的信息通过事件发送给 APIServer。

- 由于 Scheduler 在监听(Watch)APIServer,并且它在系统中起到了“承上启下”的作用,“承上”是指它负责接收创建的 Pod 事件,为其安排 Node;“启下”是指安置工作完成后,Node 上的 kubelet 进程会接管后继工作,负责 Pod 生命周期中的“下半生”。 换句话说,Scheduler 的作用是将待调度的 Pod 按照调度算法和策略绑定到集群中 Node 上。

- Scheduler 调度完毕以后会更新 Pod 的信息,此时的信息更加丰富了。除了知道 Pod 的副本数量,副本内容。还知道部署到哪个 Node 上面了。并将上面的 Pod 信息更新至 API Server,由 APIServer 更新至 etcd 中,保存起来。

- etcd 将更新成功的事件发送给 APIServer,APIServer 也开始反映此 Pod 对象的调度结果。

- kubelet 是在 Node 上面运行的进程,它也通过 List-Watch 的方式监听(Watch,通过https的6443端口)APIServer 发送的 Pod 更新的事件。kubelet 会尝试在当前节点上调用 Docker 启动容器,并将 Pod 以及容器的结果状态回送至 APIServer。

- APIServer 将 Pod 状态信息存入 etcd 中。在 etcd 确认写入操作成功完成后,APIServer将确认信息发送至相关的 kubelet,事件将通过它被接受。

#注意:在创建 Pod 的工作就已经完成了后,为什么 kubelet 还要一直监听呢?原因很简单,假设这个时候 kubectl 发命令,要扩充 Pod 副本数量,那么上面的流程又会触发一遍,kubelet 会根据最新的 Pod 的部署情况调整 Node 的资源。又或者 Pod 副本数量没有发生变化,但是其中的镜像文件升级了,kubelet 也会自动获取最新的镜像文件并且加载。

调度过程

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。其主要考虑的问题如下:

- 公平:如何保证每个节点都能被分配资源

- 资源高效利用:集群所有资源最大化被使用

- 效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

- 灵活:允许用户根据自己的需求控制调度的逻辑

Sheduler 是作为单独的程序运行的,启动之后会一直监听 APIServer,获取 spec.nodeName 为空的 pod,对每个 pod 都会创建一个 binding,表明该 pod 应该放到哪个节点上。

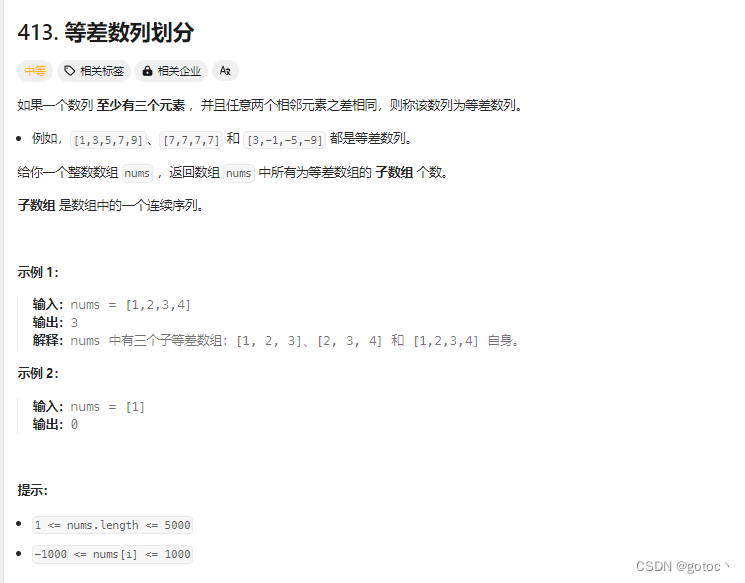

调度分为几个部分:首先是过滤掉不满足条件的节点,这个过程称为预算策略(predicate);然后对通过的节点按照优先级排序,这个是优选策略(priorities);最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误。

Predicate 有一系列的常见的算法可以使用

- PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源。

- PodFitsHost:如果 pod 指定了 NodeName,检查节点名称是否和 NodeName 匹配。

- PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突。

- PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点。

- NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。 经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程:按照优先级大小对节点排序。

优先级由一系列键值对组成,键是该优先级项的名称,值是它的权重(该项的重要性)。有一系列的常见的优先级选项包括:

- LeastRequestedPriority:通过计算CPU和Memory的使用率来决定权重,使用率越低权重越高。也就是说,这个优先级指标倾向于资源使用比例更低的节点。

- BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个一般和上面的一起使用,不单独使用。比如 node01 的 CPU 和 Memory 使用率 20:60,node02 的 CPU 和 Memory 使用率 50:50,虽然 node01 的总使用率比 node02 低,但 node02 的 CPU 和 Memory 使用率更接近,从而调度时会优选 node02。

- ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高。

通过算法对所有的优先级项目和权重进行计算,得出最终的结果。

指定调度节点

- pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配

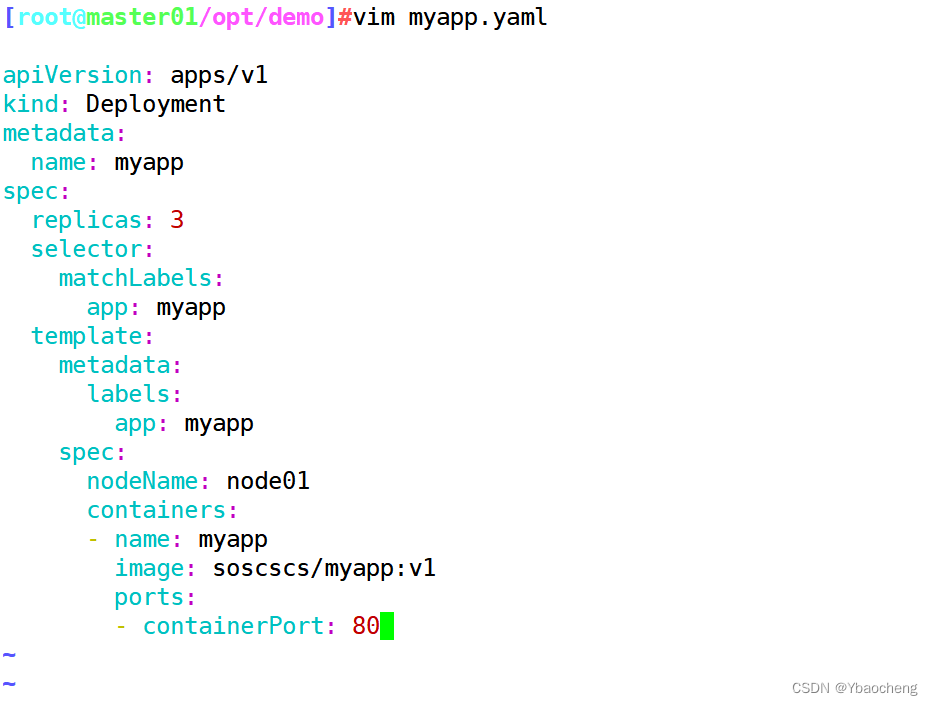

vim myapp.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp

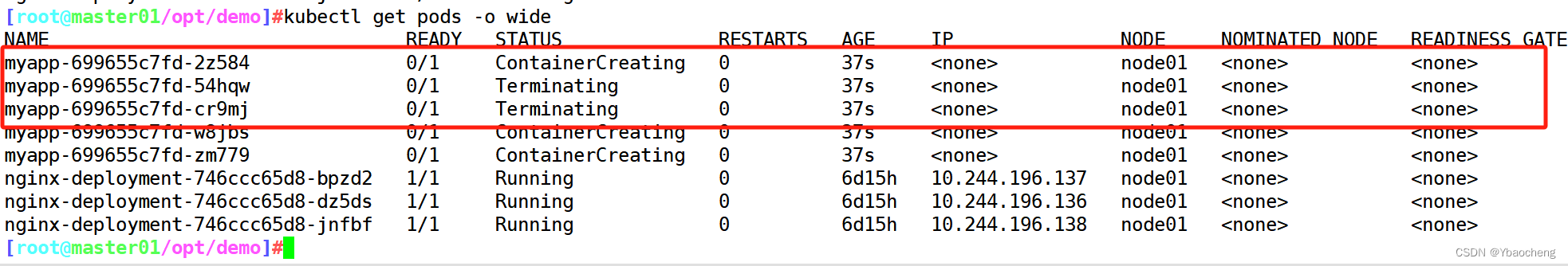

spec:replicas: 3selector:matchLabels:app: myapptemplate:metadata:labels:app: myappspec:nodeName: node01containers:- name: myappimage: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp.yamlkubectl get pods -o wide

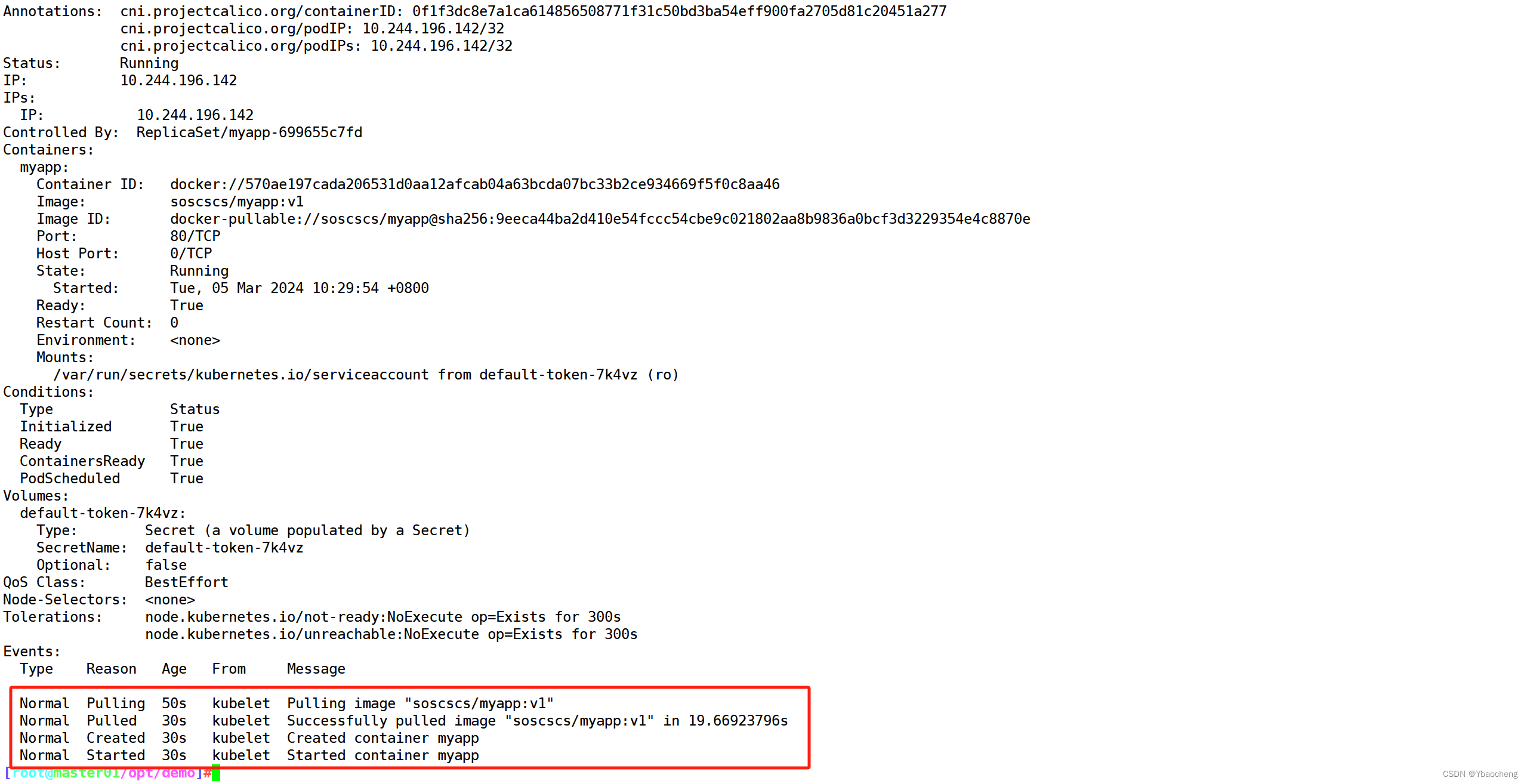

查看详细事件

- (发现未经过 scheduler 调度分配)

pod.spec.nodeSelector:通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,然后调度 Pod 到目标节点,该匹配规则属于强制约束

获取标签帮助

kubectl label --help

Usage:kubectl label [--overwrite] (-f FILENAME | TYPE NAME) KEY_1=VAL_1 ... KEY_N=VAL_N [--resource-version=version] [options]

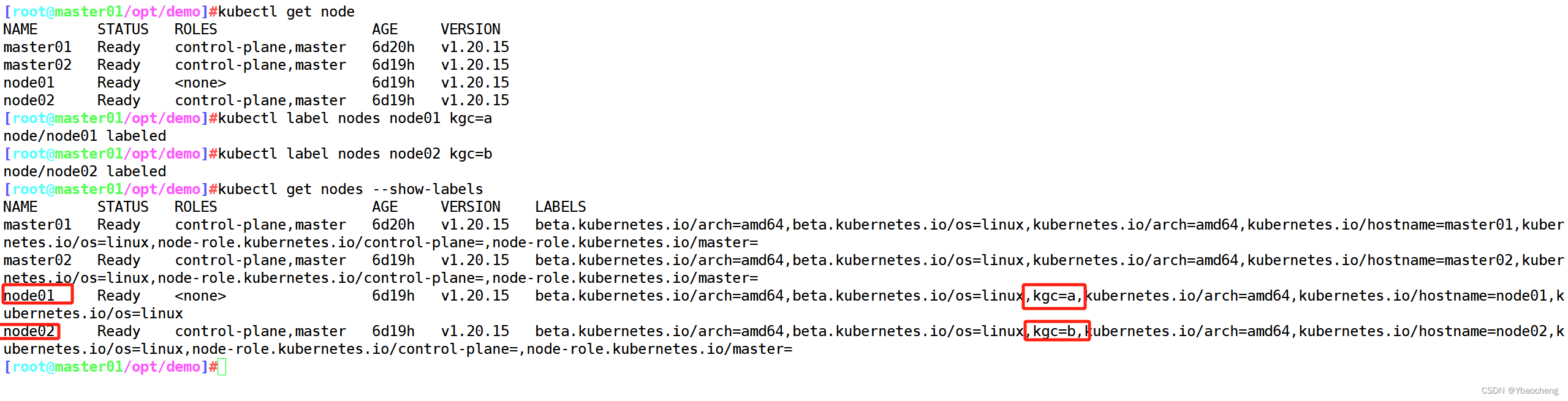

需要获取 node 上的 NAME 名称

给对应的 node 设置标签分别为 kgc=a 和 kgc=b

kubectl label nodes node01 kgc=akubectl label nodes node02 kgc=b查看标签

kubectl get nodes --show-labe

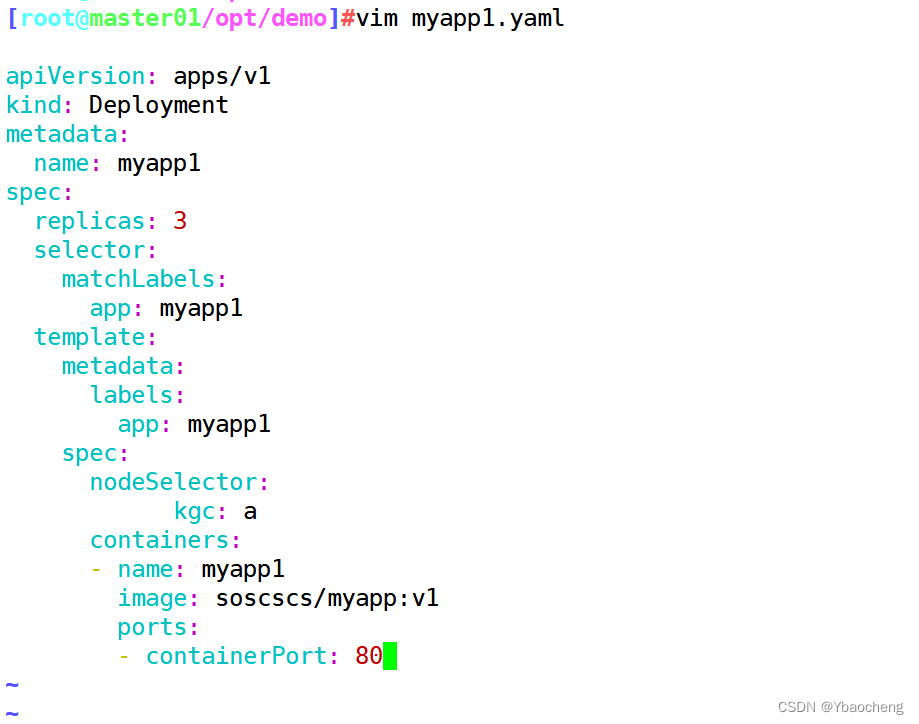

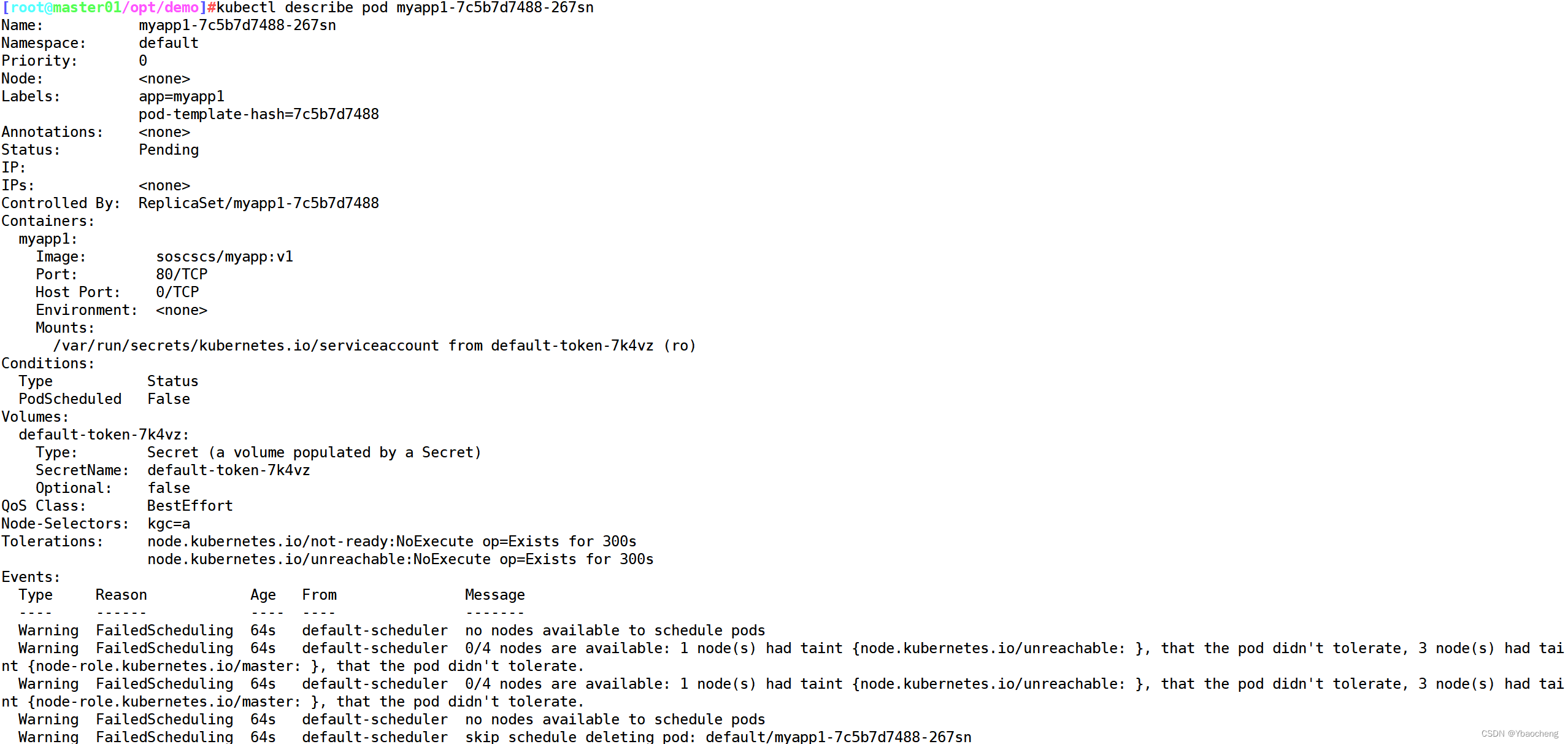

修改成 nodeSelector 调度方式

vim myapp1.yaml

apiVersion: apps/v1

kind: Deployment

metadata:name: myapp1

spec:replicas: 3selector:matchLabels:app: myapp1template:metadata:labels:app: myapp1spec:nodeSelector:kgc: acontainers:- name: myapp1image: soscscs/myapp:v1ports:- containerPort: 80kubectl apply -f myapp1.yaml kubectl get pods -o wide

修改一个 label 的值,需要加上 --overwrite 参数

kubectl label nodes node02 kgc=a --overwrite//删除一个 label,只需在命令行最后指定 label 的 key 名并与一个减号相连即可:

kubectl label nodes node02 kgc-//指定标签查询 node 节点

kubectl get node -l kgc=a2.亲和性

节点亲和性

pod.spec.nodeAffinity

preferredDuringSchedulingIgnoredDuringExecution:软策略

requiredDuringSchedulingIgnoredDuringExecution:硬策略Pod 亲和性

pod.spec.affinity.podAffinity/podAntiAffinity

preferredDuringSchedulingIgnoredDuringExecution:软策略

requiredDuringSchedulingIgnoredDuringExecution:硬策略可以把自己理解成一个Pod,当你报名来学云计算,如果你更倾向去zhangsan老师带的班级,把不同老师带的班级当作一个node的话,这个就是节点亲和性。如果你是必须要去zhangsan老师带的班级,这就是硬策略;而你说你想去并且最好能去zhangsan老师带的班级,这就是软策略。

键值运算关系

- In:label 的值在某个列表中

- NotIn:label 的值不在某个列表中

- Gt:label 的值大于某个值

- Lt:label 的值小于某个值

- Exists:某个 label 存在

- DoesNotExist:某个 label 不存在

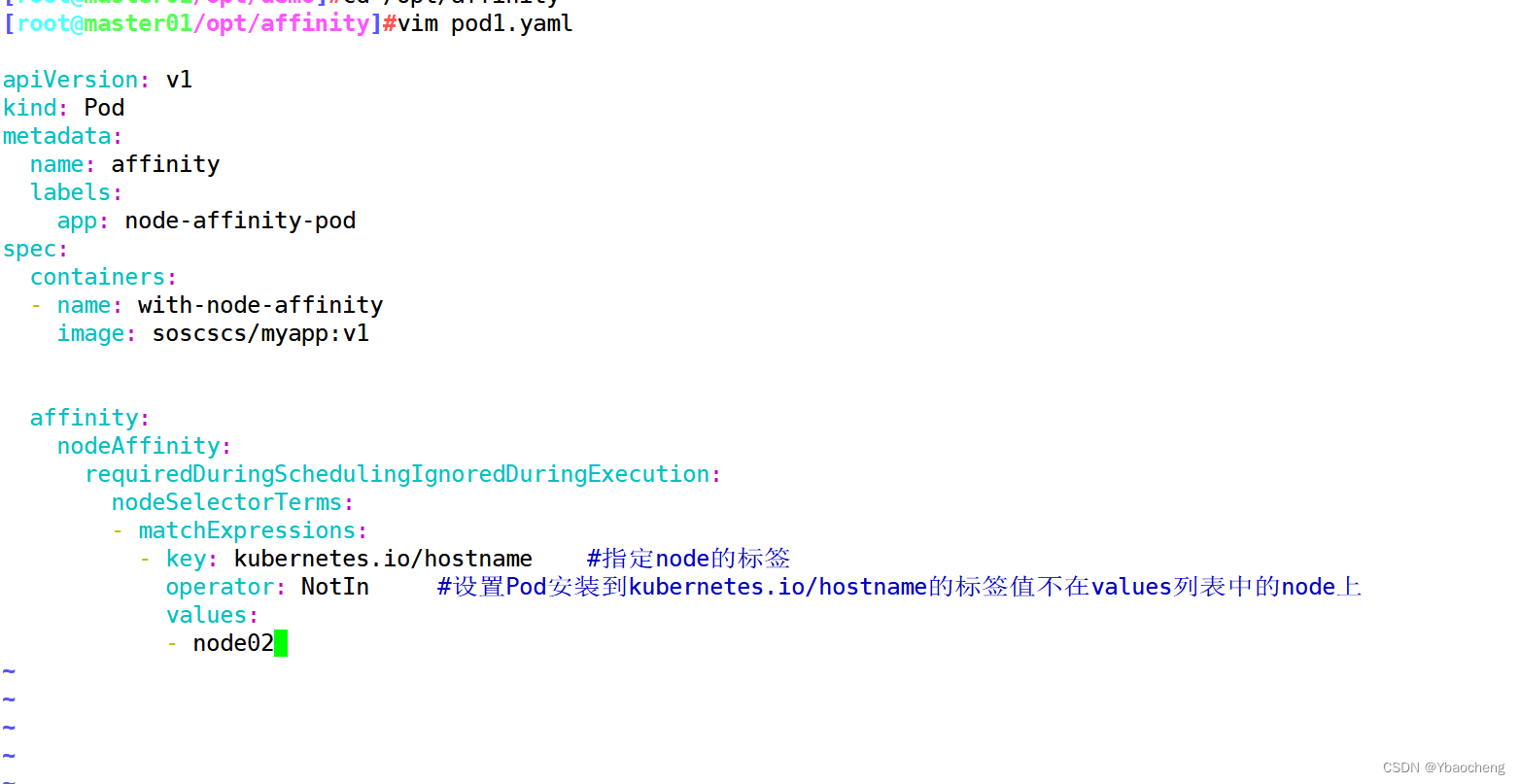

硬策略

mkdir /opt/affinity

cd /opt/affinityvim pod1.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution:nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostname #指定node的标签operator: NotIn #设置Pod安装到kubernetes.io/hostname的标签值不在values列表中的node上values:- node02kubectl apply -f pod1.yaml

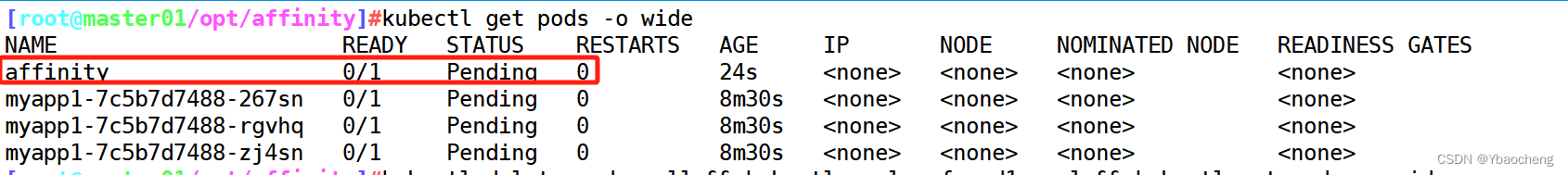

kubectl get pods -o wide

kubectl delete pod --all && kubectl apply -f pod1.yaml && kubectl get pods -o wide

#如果硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

软策略

vim pod2.yaml

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 1 #如果有多个软策略选项的话,权重越大,优先级越高preference:matchExpressions:- key: kubernetes.io/hostnameoperator: Invalues:- node03kubectl apply -f pod2.yamlkubectl get pods -o wide//把values:的值改成node01,则会优先在node01上创建Pod

kubectl delete pod --all && kubectl apply -f pod2.yaml && kubectl get pods -o wide//如果把硬策略和软策略合在一起使用,则要先满足硬策略之后才会满足软策略

//示例:

apiVersion: v1

kind: Pod

metadata:name: affinitylabels:app: node-affinity-pod

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution: #先满足硬策略,排除有kubernetes.io/hostname=node02标签的节点nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/hostnameoperator: NotInvalues:- node02preferredDuringSchedulingIgnoredDuringExecution: #再满足软策略,优先选择有kgc=a标签的节点- weight: 1preference:matchExpressions:- key: kgcoperator: Invalues:- a

Pod亲和性与反亲和性

调度策略 匹配标签 操作符 拓扑域支持 调度目标

nodeAffinity 主机 In, NotIn, Exists,DoesNotExist, Gt, Lt 否 指定主机

podAffinity Pod In, NotIn, Exists,DoesNotExist 是 Pod与指定Pod同一拓扑域

podAntiAffinity Pod In, NotIn, Exists,DoesNotExist 是 Pod与指定Pod不在同一拓扑域kubectl label nodes node01 kgc=a

kubectl label nodes node02 kgc=a创建一个标签为 app=myapp01 的 Pod

vim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1kubectl apply -f pod3.yamlkubectl get pods --show-labels -o wide

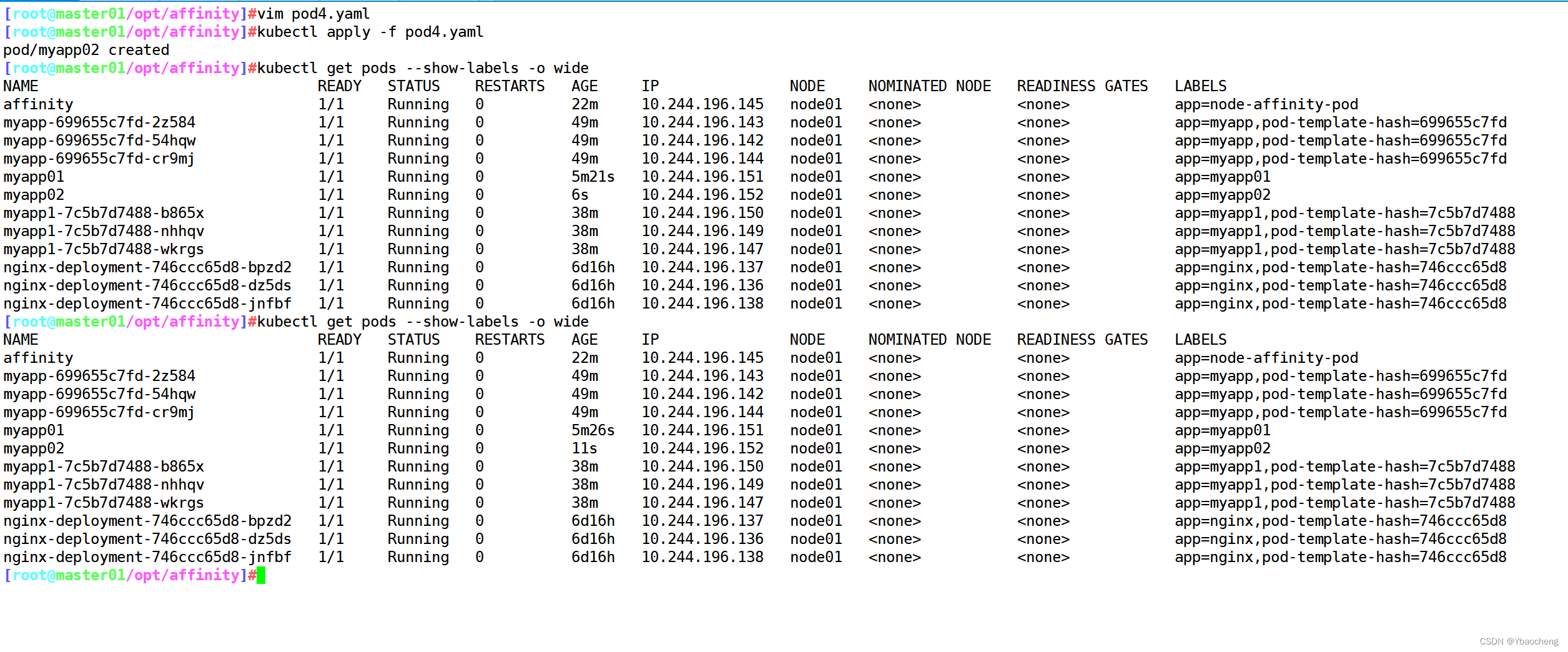

使用 Pod 亲和性调度,创建多个 Pod 资源

vim pod4.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp02labels:app: myapp02

spec:containers:- name: myapp02image: soscscs/myapp:v1affinity:podAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kgc#仅当节点和至少一个已运行且有键为“app”且值为“myapp01”的标签 的 Pod 处于同一拓扑域时,才可以将该 Pod 调度到节点上。 (更确切的说,如果节点 N 具有带有键 kgc 和某个值 V 的标签,则 Pod 有资格在节点 N 上运行,以便集群中至少有一个具有键 kgc 和值为 V 的节点正在运行具有键“app”和值 “myapp01”的标签的 pod。)

#topologyKey 是节点标签的键。如果两个节点使用此键标记并且具有相同的标签值,则调度器会将这两个节点视为处于同一拓扑域中。 调度器试图在每个拓扑域中放置数量均衡的 Pod。

#如果 kgc 对应的值不一样就是不同的拓扑域。比如 Pod1 在 kgc=a 的 Node 上,Pod2 在 kgc=b 的 Node 上,Pod3 在 kgc=a 的 Node 上,则 Pod2 和 Pod1、Pod3 不在同一个拓扑域,而Pod1 和 Pod3在同一个拓扑域。kubectl apply -f pod4.yamlkubectl get pods --show-labels -o wide

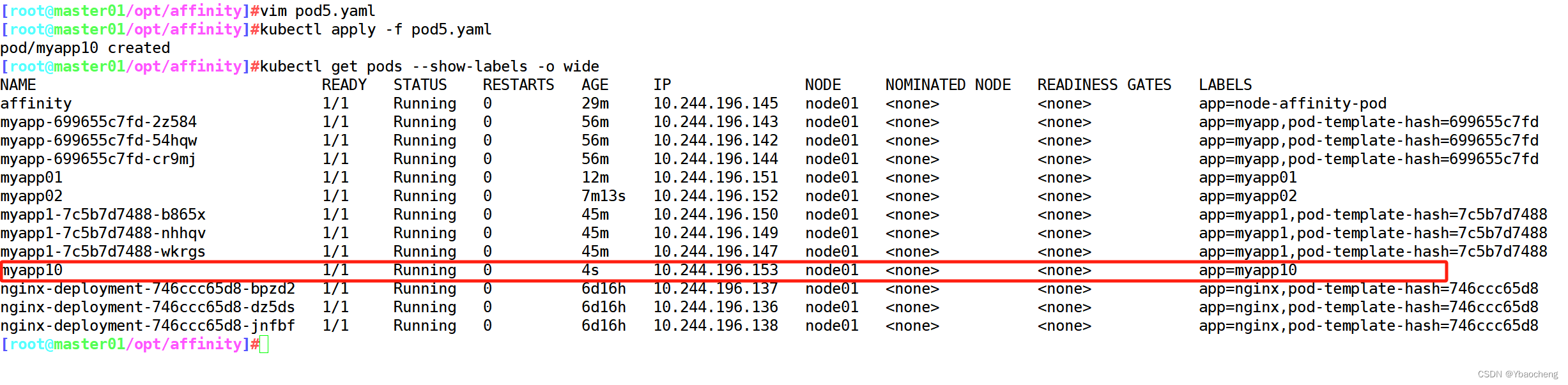

使用 Pod 反亲和性调度

示例1

vim pod5.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp10labels:app: myapp10

spec:containers:- name: myapp10image: soscscs/myapp:v1affinity:podAntiAffinity:preferredDuringSchedulingIgnoredDuringExecution:- weight: 100podAffinityTerm:labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kubernetes.io/hostname#如果节点处于 Pod 所在的同一拓扑域且具有键“app”和值“myapp01”的标签, 则该 pod 不应将其调度到该节点上。 (如果 topologyKey 为 kubernetes.io/hostname,则意味着当节点和具有键 “app”和值“myapp01”的 Pod 处于相同的拓扑域,Pod 不能被调度到该节点上。)kubectl apply -f pod5.yamlkubectl get pods --show-labels -o wide

示例2

vim pod6.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp20labels:app: myapp20

spec:containers:- name: myapp20image: soscscs/myapp:v1affinity:podAntiAffinity:requiredDuringSchedulingIgnoredDuringExecution:- labelSelector:matchExpressions:- key: appoperator: Invalues:- myapp01topologyKey: kgc//由于指定 Pod 所在的 node01 节点上具有带有键 kgc 和标签值 a 的标签,node02 也有这个kgc=a的标签,所以 node01 和 node02 是在一个拓扑域中,反亲和要求新 Pod 与指定 Pod 不在同一拓扑域,所以新 Pod 没有可用的 node 节点,即为 Pending 状态。

kubectl get pod --show-labels -owidekubectl label nodes node02 kgc=b --overwritekubectl get pod --show-labels -o wide3.污点(Taint) 和 容忍(Tolerations)

污点(Taint)

- 节点亲和性,是Pod的一种属性(偏好或硬性要求),它使Pod被吸引到一类特定的节点。Taint 则相反,它使节点能够排斥一类特定的 Pod。

- Taint 和 Toleration 相互配合,可以用来避免 Pod 被分配到不合适的节点上。每个节点上都可以应用一个或多个 taint ,这表示对于那些不能容忍这些 taint 的 Pod,是不会被该节点接受的。如果将 toleration 应用于 Pod 上,则表示这些 Pod 可以(但不一定)被调度到具有匹配 taint 的节点上。

- 使用 kubectl taint 命令可以给某个 Node 节点设置污点,Node 被设置上污点之后就和 Pod 之间存在了一种相斥的关系,可以让 Node 拒绝 Pod 的调度执行,甚至将 Node 已经存在的 Pod 驱逐出去。

污点的组成格式如下

key=value:effect

每个污点有一个 key 和 value 作为污点的标签,其中 value 可以为空,effect 描述污点的作用。

当前 taint effect 支持如下三个选项

- NoSchedule:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上

- PreferNoSchedule:表示 k8s 将尽量避免将 Pod 调度到具有该污点的 Node 上

- NoExecute:表示 k8s 将不会将 Pod 调度到具有该污点的 Node 上,同时会将 Node 上已经存在的 Pod 驱逐出去

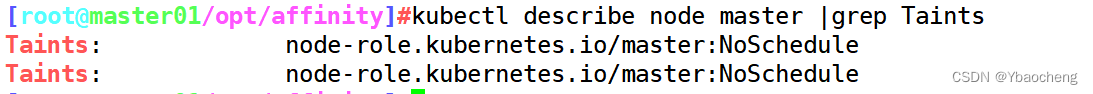

master 就是因为有 NoSchedule 污点,k8s 才不会将 Pod 调度到 master 节点上

#设置污点

kubectl taint node node01 key1=value1:NoSchedule#节点说明中,查找 Taints 字段

kubectl describe node node-name #去除污点

kubectl taint node node01 key1:NoSchedule-kubectl taint node node02 check=mycheck:NoExecute查看 Pod 状态,会发现 node02 上的 Pod 已经被全部驱逐(注:如果是 Deployment 或者 StatefulSet 资源类型,为了维持副本数量则会在别的 Node 上再创建新的 Pod)kubectl get pods -o wide容忍(Tolerations)

设置了污点的 Node 将根据 taint 的 effect:NoSchedule、PreferNoSchedule、NoExecute 和 Pod 之间产生互斥的关系,Pod 将在一定程度上不会被调度到 Node 上。但我们可以在 Pod 上设置容忍(Tolerations),意思是设置了容忍的 Pod 将可以容忍污点的存在,可以被调度到存在污点的 Node 上。

kubectl taint node node01 check=mycheck:NoExecutevim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1kubectl apply -f pod3.yaml//在两个 Node 上都设置了污点后,此时 Pod 将无法创建成功

kubectl get pods -o widevim pod3.yaml

apiVersion: v1

kind: Pod

metadata:name: myapp01labels:app: myapp01

spec:containers:- name: with-node-affinityimage: soscscs/myapp:v1tolerations:- key: "check"operator: "Equal"value: "mycheck"effect: "NoExecute"tolerationSeconds: 3600#其中的 key、vaule、effect 都要与 Node 上设置的 taint 保持一致

#operator 的值为 Exists 将会忽略 value 值,即存在即可

#tolerationSeconds 用于描述当 Pod 需要被驱逐时可以在 Node 上继续保留运行的时间kubectl apply -f pod3.yaml//在设置了容忍之后,Pod 创建成功

kubectl get pods -o wide其它注意事项

1)当不指定 key 值时,表示容忍所有的污点 keytolerations:- operator: "Exists"(2)当不指定 effect 值时,表示容忍所有的污点作用tolerations:- key: "key"operator: "Exists"(3)有多个 Master 存在时,防止资源浪费,可以如下设置

kubectl taint node Master-Name node-role.kubernetes.io/master=:PreferNoSchedule//如果某个 Node 更新升级系统组件,为了防止业务长时间中断,可以先在该 Node 设置 NoExecute 污点,把该 Node 上的 Pod 都驱逐出去

kubectl taint node node01 check=mycheck:NoExecute//此时如果别的 Node 资源不够用,可临时给 Master 设置 PreferNoSchedule 污点,让 Pod 可在 Master 上临时创建

kubectl taint node master node-role.kubernetes.io/master=:PreferNoSchedule//待所有 Node 的更新操作都完成后,再去除污点

kubectl taint node node01 check=mycheck:NoExecute-//cordon 和 drain

##对节点执行维护操作:

kubectl get nodes//将 Node 标记为不可调度的状态,这样就不会让新创建的 Pod 在此 Node 上运行

kubectl cordon <NODE_NAME> #该node将会变为SchedulingDisabled状态//kubectl drain 可以让 Node 节点开始释放所有 pod,并且不接收新的 pod 进程。drain 本意排水,意思是将出问题的 Node 下的 Pod 转移到其它 Node 下运行

kubectl drain <NODE_NAME> --ignore-daemonsets --delete-emptydir-data --force--ignore-daemonsets:无视 DaemonSet 管理下的 Pod。

--delete-emptydir-data:如果有 mount local volume 的 pod,会强制杀掉该 pod。

--force:强制释放不是控制器管理的 Pod。注:执行 drain 命令,会自动做了两件事情:

(1)设定此 node 为不可调度状态(cordon)

(2)evict(驱逐)了 Pod//kubectl uncordon 将 Node 标记为可调度的状态

kubectl uncordon <NODE_NAME>

4.Pod启动阶段(相位 phase)

Pod 创建完之后,一直到持久运行起来,中间有很多步骤,也就有很多出错的可能,因此会有很多不同的状态。

一般来说,pod 这个过程包含以下几个步骤

- 调度到某台 node 上。kubernetes 根据一定的优先级算法选择一台 node 节点将其作为 Pod 运行的 node

- 拉取镜像

- 挂载存储配置等

- 容器运行起来。如果有健康检查,会根据检查的结果来设置其状态。

phase 的可能状态有

Pending:表示APIServer创建了Pod资源对象并已经存入了etcd中,但是它并未被调度完成(比如还没有调度到某台node上),或者仍然处于从仓库下载镜像的过程中。

●Running:Pod已经被调度到某节点之上,并且Pod中所有容器都已经被kubelet创建。至少有一个容器正在运行,或者正处于启动或者重启状态(也就是说Running状态下的Pod不一定能被正常访问)。

●Succeeded:有些pod不是长久运行的,比如job、cronjob,一段时间后Pod中的所有容器都被成功终止,并且不会再重启。需要反馈任务执行的结果。

●Failed:Pod中的所有容器都已终止了,并且至少有一个容器是因为失败终止。也就是说,容器以非0状态退出或者被系统终止,比如 command 写的有问题。

●Unknown:表示无法读取 Pod 状态,通常是 kube-controller-manager 无法与 Pod 通信。Pod 所在的 Node 出了问题或失联,从而导致 Pod 的状态为 Unknow

如何删除 Unknown 状态的 Pod

●从集群中删除有问题的 Node。使用公有云时,kube-controller-manager 会在 VM 删除后自动删除对应的 Node。 而在物理机部署的集群中,需要管理员手动删除 Node(kubectl delete node <node_name>)。

●被动等待 Node 恢复正常,Kubelet 会重新跟 kube-apiserver 通信确认这些 Pod 的期待状态,进而再决定删除或者继续运行这些 Pod。

●主动删除 Pod,通过执行 kubectl delete pod <pod_name> --grace-period=0 --force 强制删除 Pod。但是这里需要注意的是,除非明确知道 Pod 的确处于停止状态(比如 Node 所在 VM 或物理机已经关机),否则不建议使用该方法。特别是 StatefulSet 管理的 Pod,强制删除容易导致脑裂或者数据丢失等问题。

5.故障排除步骤

//查看Pod事件

kubectl describe TYPE NAME_PREFIX //查看Pod日志(Failed状态下)

kubectl logs <POD_NAME> [-c Container_NAME]//进入Pod(状态为running,但是服务没有提供)

kubectl exec –it <POD_NAME> bash//查看集群信息

kubectl get nodes//发现集群状态正常

kubectl cluster-info//查看kubelet日志发现

journalctl -xefu kubelet

6.总结

scheduler的调度策略

预选策略(predicate):通过调度算法过滤掉不满足条件的node节点;如果没有满足条件的node节点,Pod会处于pending状态,直到有符合条件的node节点出现,PodFitsResources、PodFitsHost、PodFitsHostPorts、PodSelectorMatches、NoDiskConflict

优选策略(priorities):根据优先级选项为满足预选策略条件的node节点进行优先级排序,最终选择优先级最高的node节点来调度Pod,LeastRequestedPriority、BalancedResourceAllocation、ImageLocalityPriority

标签的管理操作

kubectl label <资源类型> <资源名称> 标签key=value

kubectl label <资源类型> <资源名称> 标签key=value --overwrite

kubectl label <资源类型> <资源名称> 标签key-kubectl get <资源类型> [资源名称] --show-labels

kubectl get <资源类型> -l 标签key[=value]

如何指定node节点调度Pod

1)使用 nodeName 字段指定node节点名称

2)使用 nodeSelector 字段指定node节点的标签

3)使用 节点亲和性、Pod亲和性、Pod反亲和性

4)使用 给node节点设置污点,Pod设置容忍

Pod的3种亲和性

节点亲和性(nodeAffinity):匹配指定node节点的标签,将待部署的Pod调度到满足条件的node节点上Pod亲和性(podAffinity):匹配指定Pod的标签,将待部署的Pod调度到与指定Pod所在的node节点处于同一个拓扑域的node节点上如果有多个node节点属于同一个拓扑域,通过Pod亲和性部署Pod时,scheduler会试图将Pod均衡的调度到处于同一个拓扑域的node节点上Pod反亲和性(podAntiAffinity):匹配指定Pod的标签,将待部署的Pod调度到与指定Pod所在的node节点处于不同的拓扑域的node节点上如果有多个node节点不属于同一个拓扑域,通过Pod反亲和性部署Pod时,scheduler会试图将Pod均衡的调度到不处于同一个拓扑域的node节点上如何判断node节点是否在同一个拓扑域

根拓扑域key(topologyKey)判断,如果有其它node节点拥有与指定Pod所在的node节点相同的拓扑域key和value,那么这些node节点就属于同一个拓扑域

亲和性的2种策略

硬策略(required....):要强制性的满足条件,如果没有满足条件的node节点,Pod会处于pending状态,直到有符合条件的node节点出现可理解成必须要满足条件,不满足不行软策略(preferred....):非强制性的,会优先选择满足条件的node节点进行调度,即使没有满足条件的node节点,Pod依然会完成调度可理解成最好能满足条件,不满足也行污点的管理操作

ubectl taint node <node节点名称> 污点key=[value]:effectNoSchedule(一定不被调度) PreferNoSchedule(尽量不被调度) NoExecute(不会被调度,并驱逐Pod)

kubectl taint node <node节点名称> 污点key=[value]:effect --overwritekubectl taint node <node节点名称> 污点key[=value:effect]-kubectl describe nodes <node节点名称> | grep -A5 TaintsPod设置容忍 tolerations(与containers字段同一层级)

spec:tolerations:- operator: Equal|Existskey: 污点keyvalue: 污点键值effect: NoSchedule|PreferNoSchedule|NoExecute设置节点不可调度

kubectl cordon <node节点名称>

kubectl uncordon <node节点名称> kubectl taint node <node节点名称> key=value:NoSchedule设置节点不可调度,并驱逐Pod

kubectl drain <node节点名称> --ignore-daemonsets --delete-emptydir-data --forcekubectl taint node <node节点名称> key=value:NoExecute

Pod的启动过程

0)controller manager管理的控制器创建Pod副本

1)scheduler调度器根据调度算法选择最适合的node节点调度Pod

2)kubelet拉取镜像

3)kubelet挂载存储卷

4)kubelet创建并运行容器

5)kubelet根据容器探针的探测结果设置Pod状态

Pod生命周期的5种状态

Pending:Pod已经创建,但是Pod还处于包括未完成调度到node节点或者还处于在拉取镜像的过程中、存储卷挂载失败的情况

Running:Pod所有容器已被创建,且至少有一个容器正在运行

Succeeded:Pod所有容器都已经成功退出,且不再重启。(Completed)

Failed:Pod所有容器都已经退出,且至少有一个容器是异常退出的。(Error)

Unknown:master节点的controller manager无法获取到Pod的状态信息,通常是因为master节点的apiserver与Pod所在node节点的kubelet通信失联导致的(比如node节点宕机或kubelet进程故障)总结:Pod遵循预定于的生命周期,起始于Pend阶段,如果至少有一个容器正常运行,则进Running阶段,之后取决于Pod是否有容器以失败状态退出而进入Succeeded或Failed阶段。

K8S常见的排障手段

kubectl get nodes 查看node节点运行状态

kubectl describe nodes <node节点名称> 查看node节点的详细信息和资源描述

kubectl get cs 查看master组件的健康状态

kubectl cluster-info 查看集群信息journalctl -u -f kubelet 跟踪查看kubelet进程日志kubectl get pods -o wide 查看Pod的运行状态和就绪状态

kubectl describe <pods|其它资源类型> <资源名称> 查看资源的详细信息和事件描述,主要是针对处于Pending状态的故障

kubectl logs <Pod资源名称> -c <容器名称> -f -p 查看Pod容器的主进程日志,主要是针对进入Running状态后的故障,比如Failed异常问题

kubectl exec -it <Pod资源名称> -c <容器名称> sh|bash 进入Pod容器查看容器内部相关的状态信息,比如进程、端口、文件、流量等状态信息

kubectl debug -it <Pod资源名称> --image=<临时工具容器的镜像名> --target=<目标容器> 在Pod中创建临时工具容器进入目标容器进行调试,主要针对没有调试工具的容器使用

nsenter -n --target <容器ID> 在Pod容器宿主机使用nsenter转换网络namespace,直接在宿主机进入目标容器的网络命名空间进行抓包等调试工作kubectl get svc 查看service资源的clusterIP、port、nodePort等信息

kubectl describe svc <svc资源名称> 查看service资源的标签选择器、endpoints端点等信息

kubectl get pods --show-lables 查看Pod的标签