系列文章链接

论文一:2020 Informer:长时序数据预测

论文二:2021 Autoformer:长序列数据预测

论文三:2022 FEDformer:长序列数据预测

论文四:2022 Non-Stationary Transformers:非平稳性时序预测

论文五:2022 Pyraformer:基于金字塔图结构的时序预测

论文六:2023 Crossformer:多变量时序预测

论文七:2023 LSFT-Linear:质疑transformer能力的线性预测模型

论文链接:https://openreview.net/forum?id=vSVLM2j9eie

github链接:https://github.com/Thinklab-SJTU/Crossformer

参考解读:https://blog.csdn.net/qq_33431368/article/details/129483613

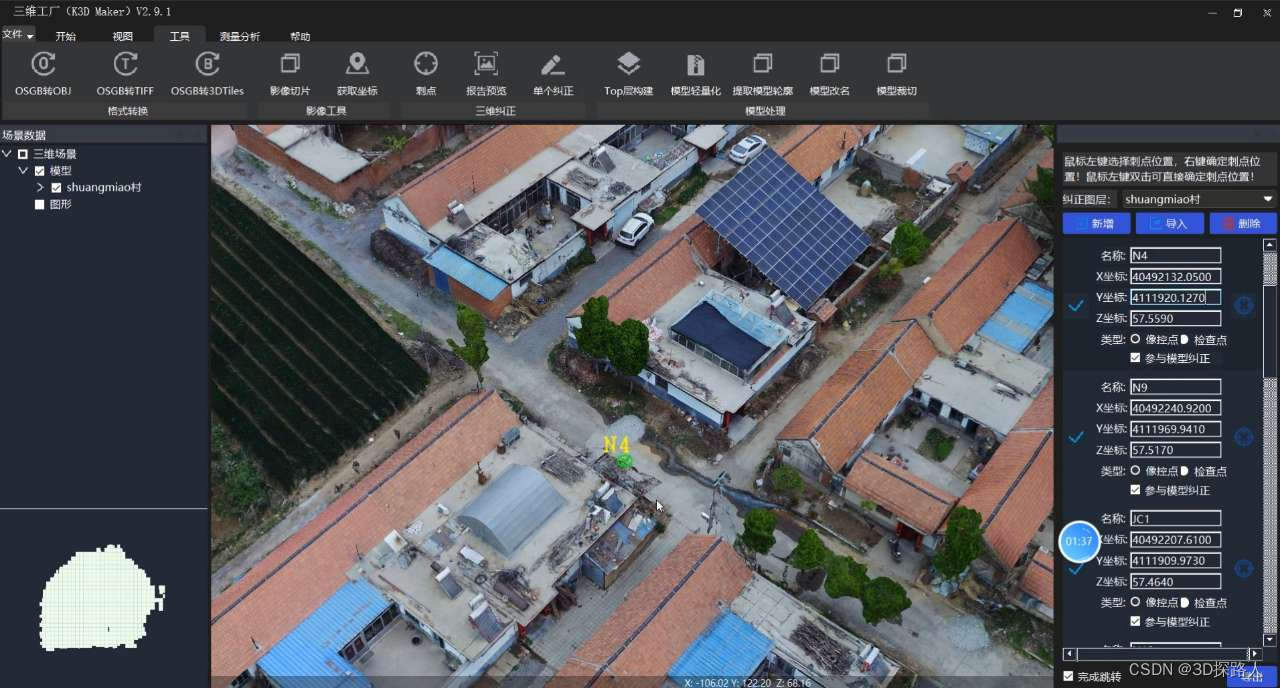

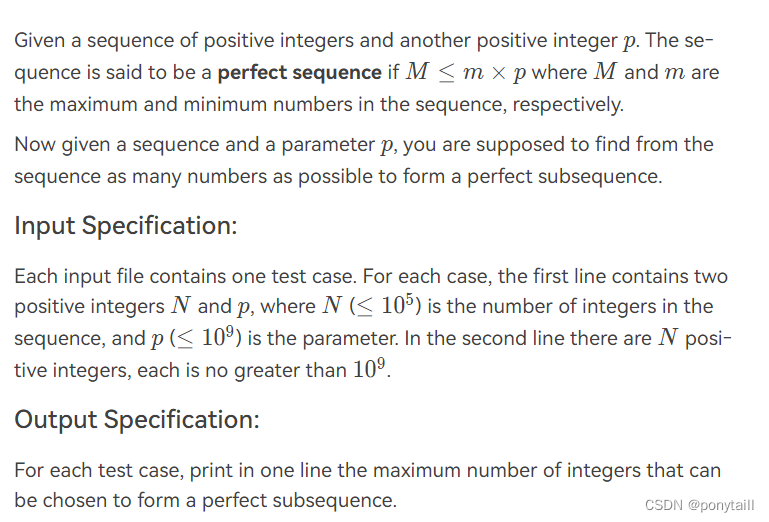

上海交通大学发表的论文,主要是解决多个变量之间时序关系的建模,解决基于多变量指标的时序数据处理,本文的创新点主要提现在以下几点:

-

Dimension-Segment-Wise Embedding:对于多维时间序列,应该对每个维度的数据进行单独的数据表征,而不是在每个点位基于所有维度的数据进行数据表征,因此本文针对每个维度的指标进行独立向量化表征(线性转换+位置编码),更好地捕捉单变量的数据信息;

-

Two-Stage注意力模块:第一步是时间维度的注意力机制,采用传统的时序transformer思想进行单维度内的时序数据建模;然后第二步再进行空间维度的建模,也就是提取多个变量之间的关联信息,也就是在变量维度进行attention计算,但是这样计算复杂度会很高,本文设计了中间变量运算简化了计算;

-

多层级Encoder-Decoder:由于上一步会进行two-stage的注意力运算,因此在Decoder中会分别对不同阶段的结果进行解码,模型的输入最开始是细粒度patch,随着层数增加逐渐聚合成更粗粒度的patch。这种形式可以让模型从不同的粒度提取信息,也有点像空洞卷积的架构。Decoder会利用不同层次的编码进行预测,各层的预测结果加和到一起,得到最终的预测结果(参考描述)。