文章目录

- 梯度累积

- 什么是梯度累积

- 如何理解理解梯度累积

- 梯度累积的工作原理

- 梯度累积的数学原理

- 梯度累积过程

- 如何实现梯度累积

- 梯度累积的可视化

梯度累积

什么是梯度累积

随着深度学习模型变得越来越复杂,模型的训练通常需要更多的计算资源,特别是在训练期间需要更多的内存。在训练深度学习模型时,在硬件资源有限的情况下,很难使用大批量数据进行有效学习。大批量数据通常可以带来更好的梯度估计,但同时也需要大量的内存。

梯度累积是一种巧妙的技术,它允许在不增加内存需求的情况下,有效地使用更大的批量数据来训练深度学习模型。

如何理解理解梯度累积

梯度累积本质上涉及将大批量划分为较小的子批量,并在这些子批量上累积计算出的梯度。这一过程模拟了使用较大批量训练的情况。

梯度累积的工作原理

以下是梯度累积过程的逐步分解:

- 分而治之:将你的硬件无法处理的大批量划分为更小的、可管理的子批量。

- 累积梯度:不是在处理每个子批量后更新模型参数,而是在几个子批量上累积梯度。

- 参数更新:在处理了预定义数量的子批量后,使用累积的梯度来更新模型参数。

这种方法使得模型能够利用大批量的稳定性和收敛性,而不必提高内存成本。

梯度累积的数学原理

梯度累积过程

在深度学习模型中,一个完整的前向和反向传播过程如下:

-

前向传播:数据通过神经网络,层层处理后得到预测结果。

-

损失计算:使用损失函数计算预测结果与实际值之间的差异。以平方误差损失函数为例:

L ( θ ) = 1 2 ( h ( x k ) − y k ) 2 L(\theta) = \frac{1}{2} (h(x_k) - y_k)^2 L(θ)=21(h(xk)−yk)2

这里 L ( θ ) L(\theta) L(θ) 表示损失函数, θ \theta θ 代表模型参数, h ( x k ) h(x_k) h(xk) 是对输入 x k x_k xk 的预测输出, y k y_k yk 是对应的真实输出。

-

反向传播:计算损失函数相对于模型参数的梯度(对上式求导):

∇ θ L ( θ ) = ( h ( x k ) − y k ) ⋅ ∇ θ h ( x k ) \nabla_\theta L(\theta) = (h(x_k) - y_k) \cdot \nabla_\theta h(x_k) ∇θL(θ)=(h(xk)−yk)⋅∇θh(xk)

-

梯度累积:在传统的训练过程中,每完成一个批次的数据处理后就会更新模型参数。而在梯度累积中,梯度不是立即用来更新参数,而是累加多个小批次的梯度:

G = ∑ i = 1 n ∇ θ L i ( θ ) G = \sum_{i=1}^{n} \nabla_{\theta} L_i(\theta) G=i=1∑n∇θLi(θ)

这里 G G G 是累积梯度, L i ( θ ) L_i(\theta) Li(θ) 是第 i i i 个batch的损失函数。

-

参数更新:累积足够的梯度后,使用以下公式更新参数:

θ = θ − η ⋅ G \theta = \theta - \eta \cdot G θ=θ−η⋅G

其中 l r lr lr 是学习率,用于控制更新的步长。

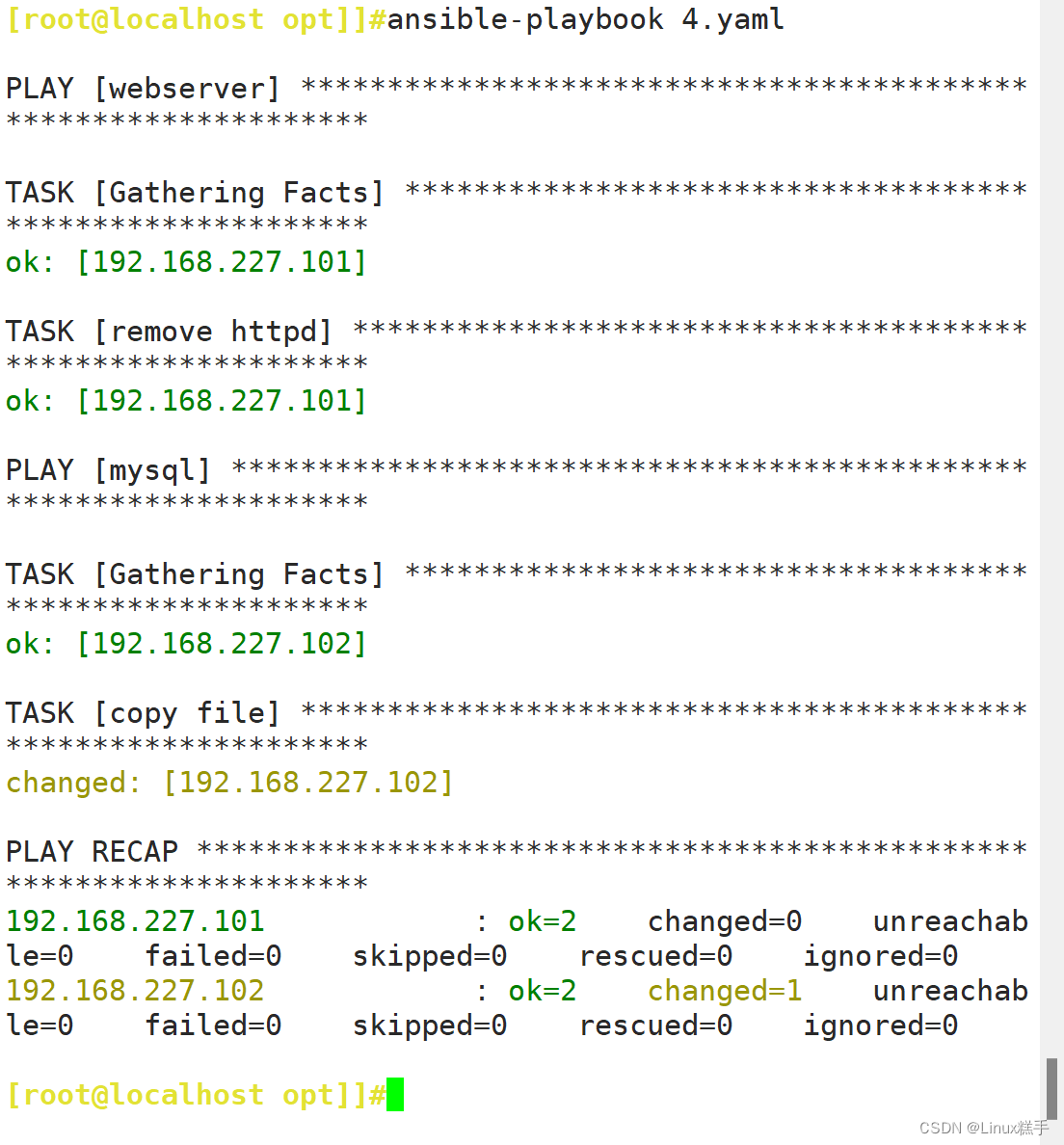

如何实现梯度累积

以下是在 PyTorch 中实现梯度累积的示例:

# 模型定义

model = ...

optimizer = ...# 累积步骤数

accumulation_steps = 4for epoch in range(num_epochs):optimizer.zero_grad()for i, (inputs, labels) in enumerate(dataloader):outputs = model(inputs)loss = criterion(outputs, labels)loss.backward()# 只有在处理足够数量的子批量后才更新参数if (i + 1) % accumulation_steps == 0:optimizer.step()optimizer.zero_grad()# 如果批量大小不是累积步数的倍数,确保在每个epoch结束时更新if (i + 1) % accumulation_steps != 0:optimizer.step()optimizer.zero_grad()

这个例子中,accumulation_steps 定义了在参数更新前需要累积的batch数量。

梯度累积的可视化

为了更好地理解梯度累积的影响,可视化可以非常有帮助。以下是一个例子,说明如何在神经网络中可视化梯度流,以监控梯度是如何被累积和应用的:

import matplotlib.pyplot as plt# 绘制梯度流动的函数

def plot_grad_flow(named_parameters):ave_grads = []layers = []for n, p in named_parameters:if (p.requires_grad) and ("bias" not in n):layers.append(n)ave_grads.append(p.grad.abs().mean())plt.plot(ave_grads, alpha=0.3, color="b")plt.hlines(0, 0, len(ave_grads)+1, linewidth=1, color="k")plt.xticks(range(0, len(ave_grads), 1), layers, rotation="vertical")plt.xlim(xmin=0, xmax=len(ave_grads))plt.xlabel("层")plt.ylabel("平均梯度")plt.title("网络中的梯度流")plt.grid(True)plt.show()# 在训练过程中或训练后调用此函数以可视化梯度流

plot_grad_flow(model.named_parameters())

参考资料:

-

Gradient Accumulation Algorithm

-

Performing gradient accumulation with 🤗 Accelerate

-

梯度累加(Gradient Accumulation)

![[微信小程序] 入门笔记2-自定义一个显示组件](https://img-blog.csdnimg.cn/direct/4f11639794bb454ba7f8c5bb3144d775.png)