Muse

Abstract

我们介绍了Muse,一个文本到图像的Transformer模型,它实现了最先进的图像生成性能,同时比扩散或自回归模型更有效。Muse是在离散标记空间中的掩码建模任务上进行训练的:给定从预训练的大型语言模型(LLM)中提取的文本嵌入,Muse被训练来预测随机掩码图像标记。与Imagen和dall - e2等像素空间扩散模型相比,Muse由于使用离散令牌和需要更少的采样迭代而显着提高了效率;与自回归模型(如Parti)相比,Muse由于使用并行解码而效率更高。使用预训练的LLM可以实现细粒度的语言理解,转化为高保真的图像生成和对视觉概念的理解,如物体,它们的空间关系,姿势,基数等。我们的900M参数模型在CC3M上实现了新的SOTA, FID评分为6.06。Muse 3B参数模型在零射击COCO评估中实现了7.88的FID,以及0.32的CLIP评分。Muse还直接启用了许多图像编辑应用程序,而无需对模型进行微调或反转:内涂,外涂和无蒙版编辑。更多的结果可以在http://muse-model.github.io上找到。

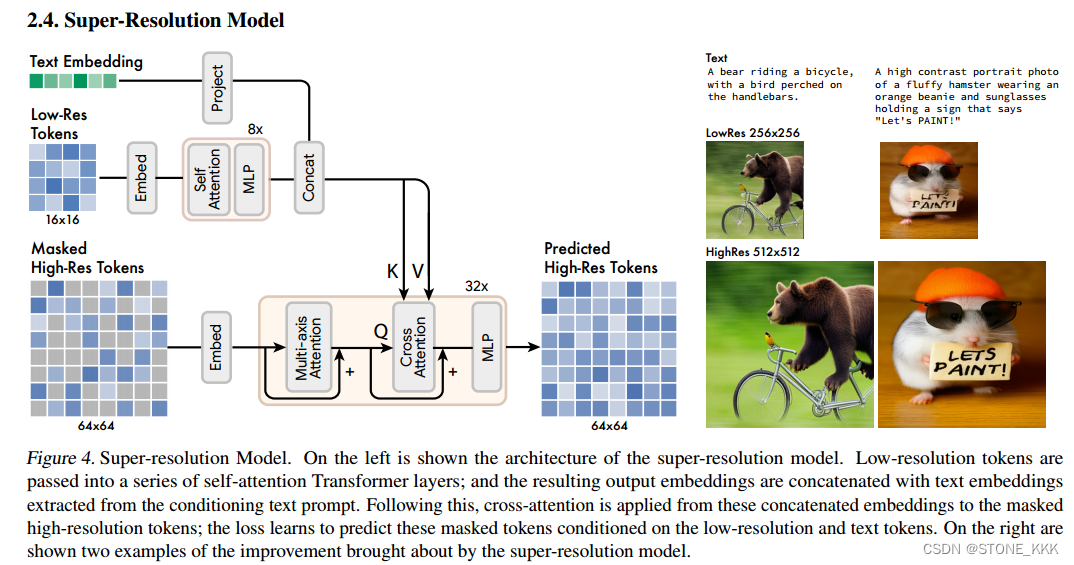

我们的基本模型是一个masked transformer,其中输入是投影的T5嵌入和图像标记。我们保留所有的文本嵌入,并随机屏蔽不同比例的图像标记,并用一个特殊的[mask]标记替换它们。然后,我们将图像标记线性映射到所需Transformer输入/隐藏大小的图像输入嵌入以及学习的2D位置嵌入。根据之前的变压器架构,我们使用多个变压器层,包括自注意块、交叉注意块和MLP块来提取特征。在输出层,使用MLP将每个掩膜图像嵌入转换为一组logits,并以ground truth令牌标签为目标应用交叉熵损失。在训练时,训练基本模型在每一步预测所有掩码令牌。然而,对于推理,掩码预测以迭代的方式执行,这大大提高了质量。

Contribution

1.性能表现

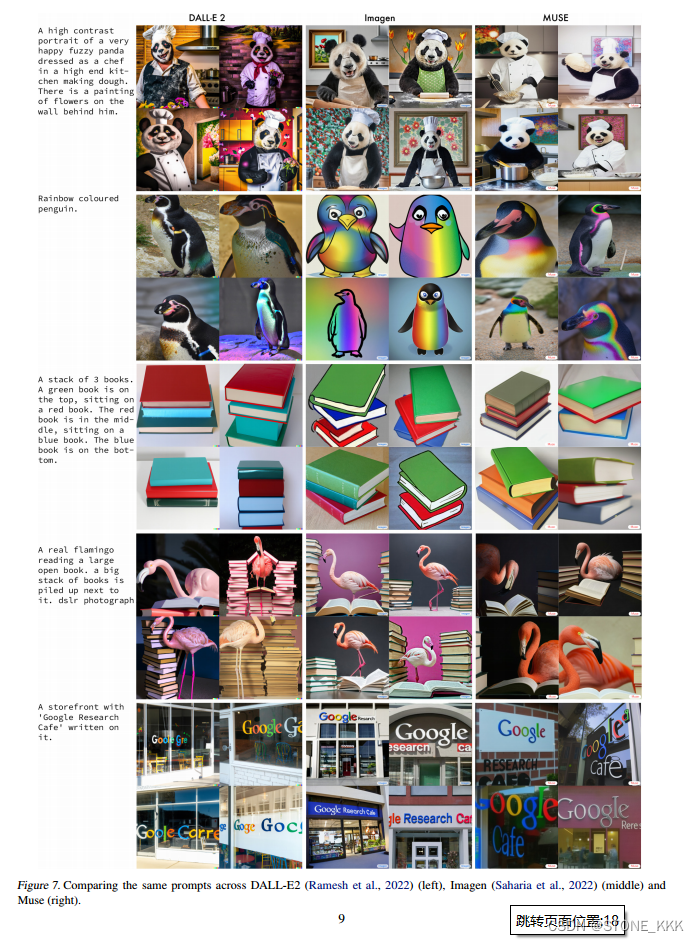

图7显示了Muse、Dall-E2和Imagen在一些选择提示上的比较,表明Muse与Imagen相当,并且在许多提示上的质量优于Dall-E2。

“灰色”和“吃花生”),可能的单词和短语的虚拟连续体要求模型以不同的方式学习。相反,它必须学习对短语、单词和字母的分层理解。图6的左下角展示了Muse在呈现时使用整个文本提示符,而不是聚焦

图7显示了Muse、Dall-E2 (Ramesh等人,2022)和Imagen(撒哈拉等人,2022)在一些选择提示上的比较,表明Muse与Imagen相当,并且在许多提示上的质量优于Dall-E2。

2.量化性能(Quantitative Performance)

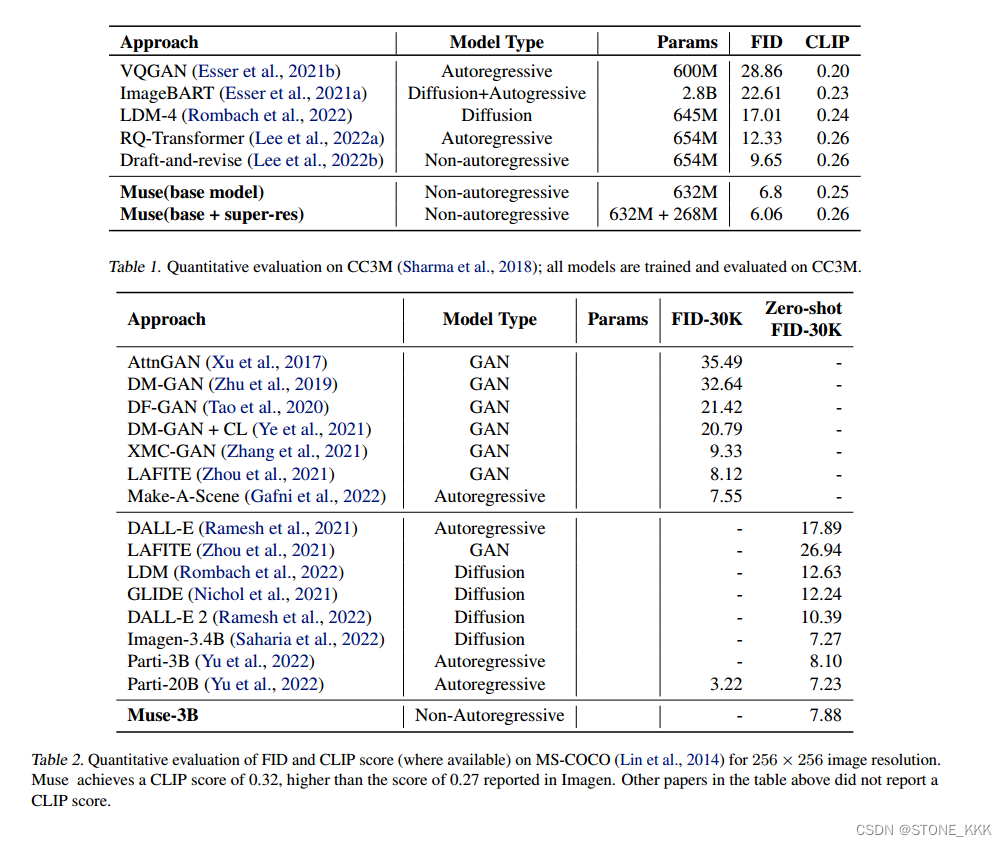

在表1和表2中

结果表明,两个Muse模型都在CC3M数据集上进行了训练。COCO结果是zero-shot,使用与Imagen相同的数据集训练的模型。

我们的632M模型在CC3M上达到了SOTA结果,显著提高了FID评分的水平,也达到了CLIP评分的水平。

我们的3B模型的FID得分为7.88,略好于参数数量相似的part -3B模型的8:1得分。我们的CLIP得分为0.32,高于Imagen的CLIP得分0.29。对于FID为7.27,Imagen的CLIP得分约为0.27。

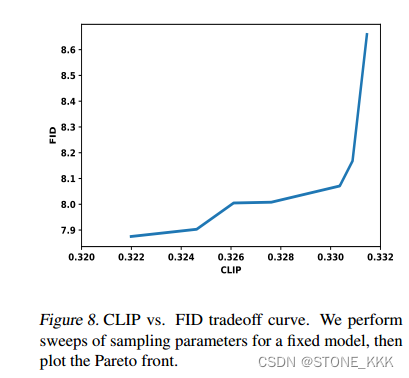

我们的采样算法有许多超参数,如制导尺度、采样温度、是否在采样过程中线性增加制导等。我们对这些参数执行求值扫描。我们发现采样参数的子集是帕累托有效的,在某种意义上,我们不能在不损害CLIP的情况下改进FID。

这允许我们研究多样性和图像/文本对齐之间的权衡,如图8所示。

FID分数是生成图片和原始图片距离分数,越小越好。CLIP分数是衡量图片和图片描述的匹配分数,越高

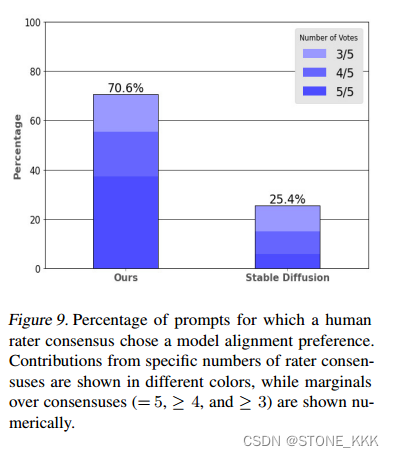

side-by-side evaluations对比试验

向人类评分者提供一个文本提示和两个图像,每个图像由使用该提示的不同文本到图像模型生成。评分者被要求通过“哪张图片与标题更匹配?”这个问题来评估即时图像的一致性。

inference speed

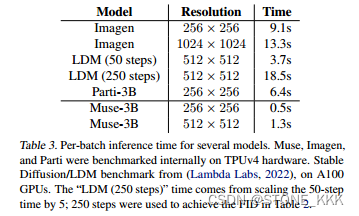

在表3中,我们将Muse的推理时间与其他几个流行模型进行了比较。我们在TPUv4加速器上对part - 3b、Imagen和Muse-3B进行了内部基准测试。

对于Stable Diffusion/LDM,我们使用了最快的基准测试(Lambda Labs, 2022),该测试是在A100 gpu上完成的。对于Stable Diffusion,我们测试的TPU实现并不比A100实现快。我们还报告了具有250次迭代的LDM的推断时间,这是用于实现表2中FID的配置。Muse的速度明显快于与之竞争的扩散模型或自回归模型,尽管参数数量相当(比Stable diffusion /LDM多3倍左右)。Muse相对于Imagen的速度优势是由于使用离散令牌和需要更少的采样迭代。Muse相对于Parti的速度优势是由于使用了并行解码。Muse相对于Stable Diffusion的速度优势主要是由于需要更少的采样迭代。