GPT-4o功能?

1.感知用户情绪:前沿研究部门主管陈信翰(Mark Chen)让ChatGPT-4o聆听他的呼吸,聊天机器人侦测到他急促的呼吸,并幽默地建议他不要像吸尘器那样呼吸,要放慢速度。随后Mark深呼吸一次,GPT-4o则表示这才是正确的呼吸方式。

2.具备不同情绪的声音:陈信翰示范了ChatGPT-4o如何用不同的声音朗读AI生成的故事,包括超级戏剧化的朗诵、机器人音调,甚至唱歌。

(ChatGPT-4o根据指示变换语调让大家捧腹大笑)

3.实时视觉功能:研究员巴雷特·佐夫(Barret Zoph)演示了如何让ChatGPT-4o通过手机摄像头实时解决数学问题,仿佛一位真实的数学老师在旁边指导每一个解题步骤。此外,ChatGPT-4o还能通过前置摄像头观察用户的面部表情,分析其情绪。

(巴雷特·佐夫展示在ChatGPT-4o的逐步指导下解方程式)

4.更即时的语音交互:ChatGPT-4o的响应时间得到缩短,与用户的交互更加即时。穆拉提和陈信翰利用新的聊天机器人展示了跨语言的实时翻译功能,能够在英语和意大利语之间无缝转换。

ChatGPT-4o使用

公测地址: https://www.aichatgpt.net

适合人群:办公写作、视频脚本、 文章润色、广告文案、多语言翻译等等。

这是一个网站,里面有各种版本的GPT可用,有GPT3.5、GPT4.0、GPT4.0 turbo。聊天对话很丝滑。

为了避免打广嫌疑,将广告都抹掉了,需要的自行访问。

GPT-4o在英语文本和代码上的性能与GPT-4 Turbo性能相当,在非英语文本上的性能显著提高,同时API的速度也更快,成本降低了50%。与现有模型相比,GPT-4o在视觉和音频理解方面尤其出色。

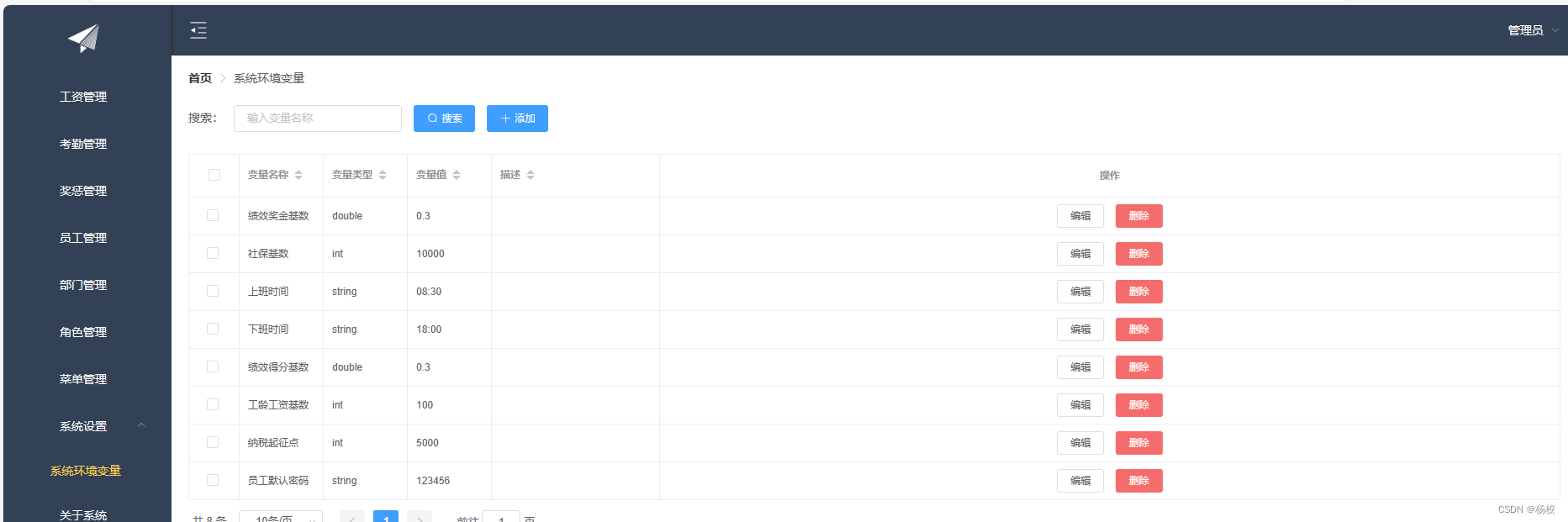

为了给大家一个更直观的感受,我们让ChatGPT-4生成了一个对比GPT-4o和GPT-4 Turbo的表格:

科技博主“All About AI”也在YouTube上展示了GPT-4o和GPT-4 Turbo的反应速度(下图)。

通过同时向GPT-4o(左)和GPT-4 Turbo(右)提出相同要求—“写三段关于19世纪在巴黎生活的内容”—我们可以观察到当GPT-4o已经完成处理并做出回应时,GPT-4 Turbo仍在进行输出处理。

GPT-4o在5216毫秒(5.216秒)内处理了574个Token,约等于 110 Token/秒;GPT-4 Turbo在23442毫秒(23.442秒)内处理了474个Token,约等于20 Token/秒。前者的处理速度是后者的大约5.44倍。

发布会之后,一名OpenAI的研究员在自己的推文中证实,此前出现在测试网站上的神秘 GPT-2 聊天机器人确实就是GPT-4o。

“GPT-4o 是我们最新的前沿模型。我们已经在LMSys上测试了一个版本,也就是 im-also-a-good-gpt2-chatbot。” 威廉·费杜斯(WIlliam Fedus)在自己的推特上介绍到,并且得到了奥尔特曼的转发。

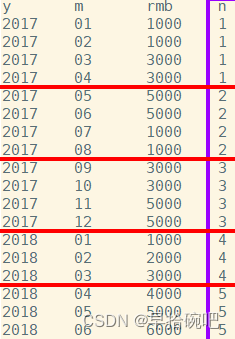

“ELO分数最终可能受到提示难度的限制。我们发现在更难的提示集上 — 尤其是编程 — GPT-4o 的ELO比我们之前最好的模型高出100分,”这位工程师补充道。

从下图可以看出,GPT-4o(也就是im-also-a-good-gpt2-chatbot)的表现一骑绝尘,远高于其他大模型。

穆拉提还在春季发布会上宣布,GPT-4o的文本和图像功能已开始向付费的ChatGPT Plus和Teams用户提供,并将很快推广至企业用户。同时,免费用户也将逐步获得使用权限,但需受到速率的限制。GPT-4o的语音功能预计将在未来几周内向用户开放。

目前,开发者已能通过API使用GPT-4o的文本和视觉模式。

此外,OpenAI还对ChatGPT的用户界面(UI)进行了优化,并且推出了适用于macOS系统的ChatGPT应用程序,已向付费用户开放。该公司表示今年晚些时候还将推出Windows版本的ChatGPT应用程序。