翻译自WRF论坛https://forum.mmm.ucar.edu/threads/stretched-vertical-levels-information.14975/#post-37729

设置模式垂直层

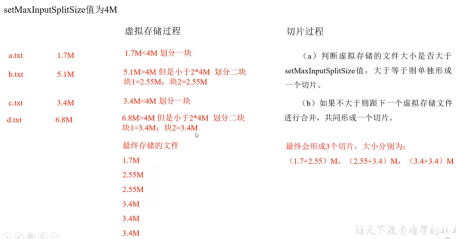

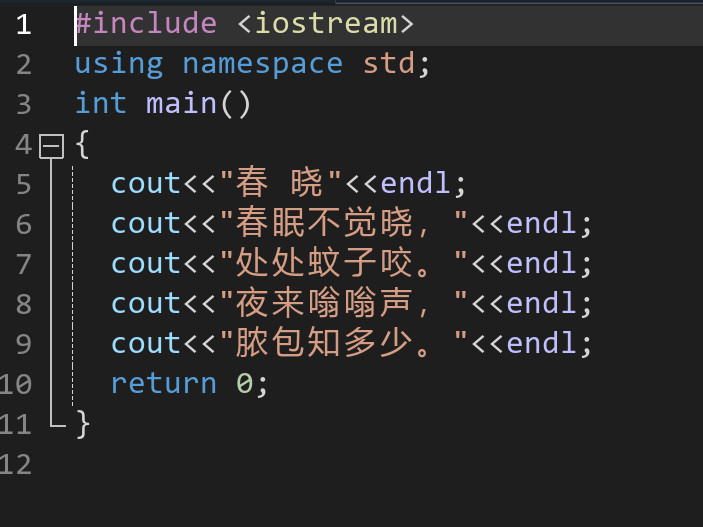

Eta 层由 real 自动计算,基于namelist选项“e_vert.”所设置的层数。然而,完整的eta 层次可以由namelist选项“eta_levels.”来显式的指定。层次的数目必须和eta 面的数目(e_vert)相一致.使用的方法是由namelist选项“auto_levels_opt.”设计的。通常,auto_levels_opt=2, 使用底层和顶层缩放系数(dzstretch_s and dzstretch_u) 来对层次根据log p进行缩放,从厚度“dzbot.”开始,直到最大厚度(max_dz)。当厚度达到max_dz/2时,缩放的变换从“dzstretch_s”到“dzstretch_u”.

另外一个选项时设置auto_levels_opt=1, 这将假设已知前几个层,然后生成等高度间距的层次,直到模式的顶层。

Given are two distributions for 28 and 35 levels.

给出了28和35层的两个分布。

- dzstretch设置成1.3,则在5km(第13层)以下的厚度将达到1km-*通常不推荐

- dzstretch设置成1.2,则在7km(第19层)左右的厚度将达到1km

- dzstretch设置成1.1,则在5km(第36层)以下13厚度将达到1km

- dzstretch设置成1.1,在最底下的1km有12层,最底下10km有34层

- dzstretch设置成1.2,在最底下的1km有9层,最底下10km有22层

- dzstretch设置成1.3,在最底下的1km有8层,最底下10km有18层

当使用了dzstretch_s和dzstrech_u时,最少的层次数

To avoid max thickness in the upper troposphere, stretching levels must extend above the tropopause before going to constant d (logp). This can be done by using low “dzstretch_u” values (but larger than ~1.02) to reach the tropopause, while also stretching fast enough to compensate the lapse rate.

为了避免对流层上层的最大厚度,拉伸的层次必须在达到常数 d (logp) 之前延伸到对流层顶以上。这可以通过使用较低的“dzstretch_u”值(但大于~1.02)来达到对流层顶,同时拉伸得足够快以补偿递减率。

For additional flexibility, use namelist options

- dzbot: the thickness of the first model layer between full levels (default value is 50 m)

- max_dz: the maximum layer thickness allowed with the default value of 1000 m.

![极大似然估计的思想及计算[例题]](https://img2024.cnblogs.com/blog/3436794/202409/3436794-20240909231316614-963418547.jpg)