最近deepseek非常火爆,蒸馏算法的落地,实现了小资源跑大模型,也极大的降低了本地化运行的门槛,为打工人带来了福音;

本地化运行可以解决脱网、隐私、审计等重要问题,适合闲暇聊个天、练练英语、完成打工任务 等

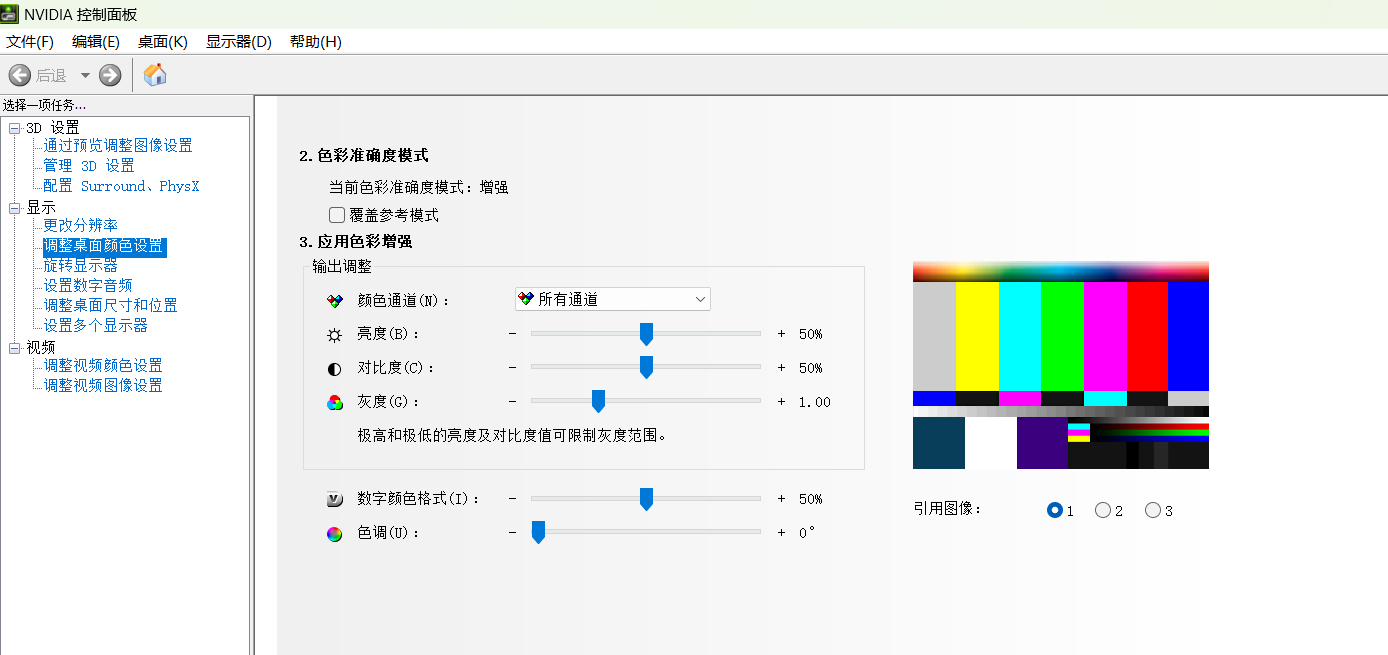

step1

下载并安装Ollama

Ollama是一个开源的 LLM(大型语言模型)服务工具(就是大模型运行工具)

地址:https://ollama.com

选择适合自己的系统即可

【 这一步可能需外网 我试试附件能不能挂发哦这个博客里】ps结果: 太大了 挂不进去

step2

下载并运行deepseek模型

根据自己的内存预估来选择模型

推荐 ollama run deepseek-r1:14b

直接命令行运行

即可

等下载 耗时比较长

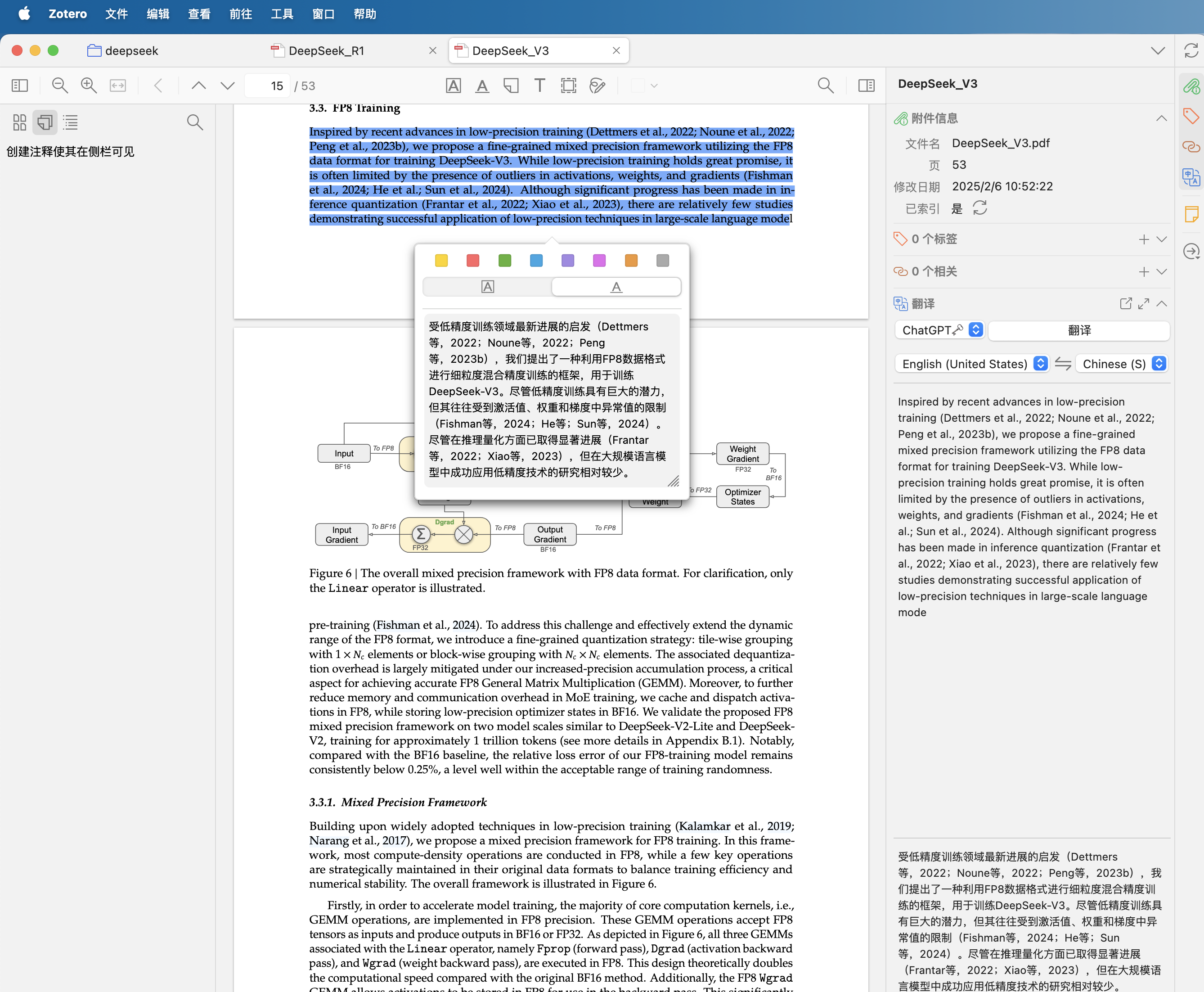

step1

安装个交互接口

https://chatboxai.app/zh

https://chatboxai.app/zh#download

(其他的也可以的)

使用本地的模型 它只是交互接口。不收费

点击设置 引入本地新模型配置 (deepseek)

![电影《哪吒之魔童闹海》迅雷BT下载[MP4/1.12GB/2.35GB]百度云高清版共享[HD1280p资源已更新]](https://img2024.cnblogs.com/blog/3598753/202502/3598753-20250206113301747-509166646.png)