文章目录

- 集群部署规划

- 服务器准备

- Mobaxterm 远程登录

- 实验前准备

- 安装软件工具

- 关闭防火墙

- 安装 JDK 和 Hadoop

- 创建软件包目录

- 解压软件包

- 配置环境变量

- 集群搭建

- 先创建 HDFS 工作目录和 LOG 目录

- 配置集群

- 配置环境

- 配置 HDFS 主节点信息、持久化和数据文件的主目录

- 配置 HDFS 默认的数据存放策略

- 配置 Mapreduce 任务调度策略

- 配置 YARN 资源管理角色的信息

- 配置 DataNode 节点信息

- 配置主机名对应 IP

- SSH无密登录配置

- 无密钥配置

- .ssh文件夹下(~/.ssh)的文件功能解释

- 集群启停方式

- 编写集群常用脚本

- 集群启停脚本

- 查看集群所有服务器进程脚本 jpsall

- 集群分发脚本 xsync

- 脚本使用

- 搭建Hadoop集群过程中常见错误的解决方案

集群部署规划

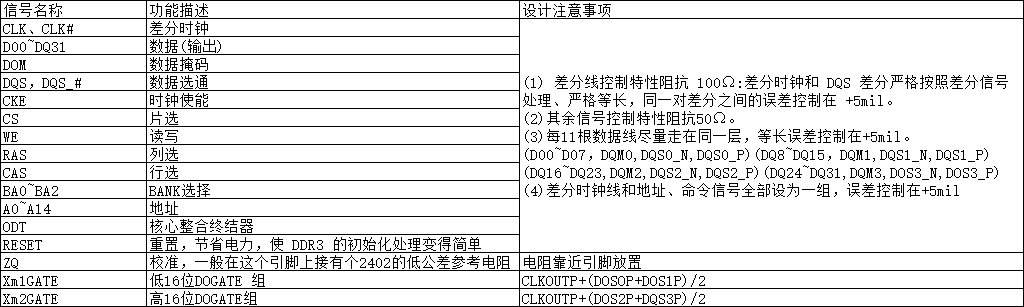

| 服务 | hadoop102 | hadoop103 | hadoop104 |

|---|---|---|---|

| NameNode | √ | ||

| DataNode | √ | √ | √ |

| Secondary NameNode | √ | ||

| ResourceManager | √ | ||

| NodeManager | √ | √ | √ |

| JobHistoryServer | √ | ||

| IPv4 | 192.168.88.102 | 192.168.88.103 | 192.168.88.104 |

| NodeObject | master | worker1 | worker2 |

服务器准备

可以是自己创建虚拟机,也可以用阿里云的云服务等。

Mobaxterm 远程登录

Mobaxterm 可以使用 MultiExec 功能开启多执行模式,让三台机器同时执行,如果是自己创建的虚拟机可以在一个机器上配置完集群,再进行完全克隆,之后只需要修改IP和主机名就可以了,可以减少很多不必要的重复操作。

实验前准备

安装软件工具

yum install net-tools

yum install vim

关闭防火墙

systemctl stop firewalld.service

systemctl disable firewalld.service

安装 JDK 和 Hadoop

JDK 下载地址:编程宝库、华为镜像

Hadoop 下载地址:清华镜像源、所有历史版本、官方网址

这里用的是Hadoop3.3.1,如果用Hadoop2.x的遇到问题可以看下 搭建部署Hadoop2.x和3.x的区别

创建软件包目录

创建 software 目录,把 JDK 的 rpm包和 Hadoop 的 tar 包拷贝进去

mkdir software

cd software

在左侧打开 software 文件,直接将软件包拖拽至文件夹下即可

解压软件包

使用 rpm 安装 jdk,默认位置为 /usr/java/default,方便后面环境变量的配置(有的软件没配置 jdk 就会到这个路径下找)

rpm -ivh jdk-8u221-linux-x64.rpm

查看 Java 版本:

java -version

# output

java version "1.8.0_221"

Java(TM) SE Runtime Environment (build 1.8.0_221-b11)

Java HotSpot(TM) 64-Bit Server VM (build 25.221-b11, mixed mode)

解压hadoop软件包到/opt/目录下

tar -zxvf hadoop-3.3.1.tar.gz -C /opt/

配置环境变量

添加 hadoop 环境变量(不建议直接在 /etc/profile 文件内直接添加)

vim /etc/profile.d/hadoop.sh# 或者(不建议)

vim /etc/profile/

添加内容:

export HADOOP_HOME=/opt/hadoop-3.3.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

在/etc/profile文件内有这样一段代码,可见他是遍历整个文件夹下 shell 文件只需要加一个hadoop.sh文件,里面配置所需要的属性,不用了之后方便删除。

for i in /etc/profile.d/*.sh /etc/profile.d/sh.local ; doif [ -r "$i" ]; thenif [ "${-#*i}" != "$-" ]; then. "$i"else. "$i" >/dev/nullfifi

done

配置完 source 命令执行一下/etc/profile文件,让新的环境变量 PATH 生效

source /etc/profile

集群搭建

先创建 HDFS 工作目录和 LOG 目录

创建 HDFS 的 NN 和 DN 工作主目录,创建 Hadoop 的 log 日志文件目录(建议将文件放在/var目录下)

mkdir -p /var/big_data /var/log_hadoop

配置集群

首先,进入$HADOOP_HOME/etc/hadoop目录

cd $HADOOP_HOME/etc/hadoop

配置环境

1)为 Hadoop 提供 JAVA 解释器路径信息,主要目的是解决远程访问 hadoop 时候JAVA_HOME无法继承的问题,同时将 Hadoop 的日志存储路径修改/var/log_hadoop路径下,其默认在$HADOOP_HOME/etc/hadoop/logs下,一般情况下建议重新指定路径。

vim hadoop-env.sh

添加内容如下:(找到对应位置,没有就加在最后;命令模式下,输入 😒 回车,光标就会定位到最后一行,按 O 在下一行输入内容)

export JAVA_HOME=/usr/java/default

export HADOOP_LOG_DIR=/var/log_hadoop

2)为 Yarn 任务、资源管理器提供 Java 运行环境

vim yarn-env.sh

添加内容如下:

export JAVA_HOME=/usr/java/default

配置 HDFS 主节点信息、持久化和数据文件的主目录

vim core-site.xml

添加如下内容:

<property><!-- 指定NameNode的地址 --><name>fs.defaultFS</name><value>hdfs://hadoop102:9000</value></property><property><!-- 指定hadoop数据的存储目录 --><name>hadoop.tmp.dir</name><value>/var/big_data</value></property>

配置 HDFS 默认的数据存放策略

vim hdfs-site.xml

添加如下内容:

<property><!-- DataNode存储block的副本量,不大于DataNode的个数--><name>dfs.replication</name><value>3</value></property><property><!-- 2nn web端访问地址--><name>dfs.namenode.secondary.http-address</name><value>hadoop104:9868</value></property><property><!-- 禁用 HDFS ACL(简单权限)--><name>dfs.permissions</name><value>false</value></property>

配置 Mapreduce 任务调度策略

vim mapred-site.xml

添加如下内容:

<property><!-- 指定MapReduce程序运行在Yarn上 --><name>mapreduce.framework.name</name><value>yarn</value></property><property><!-- 历史服务器端地址 --><name>mapreduce.jobhistory.address</name><value>hadoop103:10020</value></property><property><!-- 历史服务器web端地址 --><name>mapreduce.jobhistory.webapp.address</name><value>hadoop103:19888</value></property>

配置 YARN 资源管理角色的信息

vim yarn-site.xml

添加如下内容:

<property><!-- 指定MR走shuffle --><name>yarn.nodemanager.aux-services</name><value>mapreduce_shuffle</value></property><property><!-- 指定ResourceManager的地址--><name>yarn.resourcemanager.hostname</name><value>hadoop102</value></property>

配置 DataNode 节点信息

vim worker

添加如下内容(不要留任何空格):

hadoop102

hadoop103

hadoop104

配置主机名对应 IP

vim /etc/hosts

添加如下内容:

192.168.88.102 hadoop102

192.168.88.103 hadoop103

192.168.88.104 hadoop104

注意屏蔽或删除上面的127.0.0.1的信息

SSH无密登录配置

无密钥配置

1)免密登录原理,如下图所示

2)生成公钥和私钥,注意下面的指令要求3台机器都要执行,Mobaxterm可以使用MultiExec功能开启多执行模式,让三台机器同时执行。

ssh-keygen -t rsa

然后敲(三个回车),就会生成两个文件id_rsa(私钥)、id_rsa.pub(公钥)

3)将公钥拷贝到要免密登录的目标机器上,各自文件下

ssh-copy-id hadoop102

ssh-copy-id hadoop103

ssh-copy-id hadoop104

.ssh文件夹下(~/.ssh)的文件功能解释

| 文件名 | 含义 |

|---|---|

| known_hosts | 记录ssh访问过计算机的公钥(public key) |

| id_rsa | 生成的私钥 |

| id_rsa.pub | 生成的公钥 |

| authorized_keys | 存放授权过得无密登录服务器公钥 |

集群启停方式

1)各个模块分开启停(配置ssh是前提)

(1)如果集群是第一次启动,需要在 hadoop102 节点格式化 NameNode

hdfs namenode -format

(2)整体启停 HDFS/YARN

start-dfs.sh

stop-dfs.sh

start-yarn.sh

stop-yarn.sh

或者

$HADOOP_HOME/sbin/start-dfs.sh

$HADOOP_HOME/sbin/stop-dfs.sh

$HADOOP_HOME/etc/hadoop/sbin/start-yarn.sh

$HADOOP_HOME/etc/hadoop/sbin/stop-yarn.sh

如果使用的 hadoop 版本为 3.x 应该会出现在下述类型报错,显然是参数没有被定义

Starting namenodes on [hadoop102]

ERROR: Attempting to operate on hdfs namenode as root

ERROR: but there is no HDFS_NAMENODE_USER defined. Aborting operation.

Starting datanodes

ERROR: Attempting to operate on hdfs datanode as root

ERROR: but there is no HDFS_DATANODE_USER defined. Aborting operation.

Starting secondary namenodes [hadoop104]

ERROR: Attempting to operate on hdfs secondarynamenode as root

ERROR: but there is no HDFS_SECONDARYNAMENODE_USER defined. Aborting operati

下面我们需要在定义这些参数

方法一: 在 /etc/profile.d/hadoop.sh 文件内添加

vim /etc/profile.d/hadoop.sh

内容如下:

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

方法二: 修改 start-dfs.sh、stop-dfs.sh、start-yarn.sh、stop-yarn.sh 四个文件

修改 HDFS 文件

vim $HADOOP_HOME/sbin/start-dfs.sh

vim $HADOOP_HOME/sbin/stop-dfs.sh

在顶部添加以下参数

#!/usr/bin/env bash

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

修改 YARN 文件

vim $HADOOP_HOME/sbin/start-yarn.sh

vim $HADOOP_HOME/sbin/stop-yarn.sh

在顶部添加以下参数

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=root

2)各个服务组件逐一启动/停止

(1)启停 HDFS 组件

hdfs --daemon start/stop namenode/datanode/secondarynamenode

(2)启停 YARN

yarn --daemon start/stop resourcemanager/nodemanager

(3)启停 JobHistory

mr-jobhistory-daemon.sh start historyserver

mr-jobhistory-daemon.sh stop historyserver

3.x 版本的应该会出现下述警告

WARNING: Use of this script to start the MR JobHistory daemon is deprecated.

WARNING: Attempting to execute replacement "mapred --daemon start" instead.

不想看到的话,可以改为使用下述命令

mapred --daemon start historyserver

mapred --daemon stop historyserver

编写集群常用脚本

集群启停脚本

vim myhadoop.sh

添加内容如下:

#!/bin/bashif [ $# -lt 1 ]

thenecho "No Args Input..."exit ;

ficase $1 in

"start")echo "=========== 启动 hadoop 集群 ==========="echo "----------- 启动 hdfs -----------------"ssh hadoop102 "$HADOOP_HOME/sbin/start-dfs.sh"echo "----------- 启动 yarn -----------------"ssh hadoop102 "$HADOOP_HOME/sbin/start-yarn.sh"echo "----------- 启动 historyserver --------"ssh hadoop103 "$HADOOP_HOME/bin/mapred --daemon start historyserver"

;;

"stop")echo "=========== 关闭 hadoop 集群 ==========="echo "----------- 关闭 historyserver --------"ssh hadoop103 "$HADOOP_HOME/bin/mapred --daemon stop historyserver"echo "----------- 关闭 yarn -----------------"ssh hadoop102 "$HADOOP_HOME/sbin/stop-yarn.sh"echo "----------- 关闭 hdfs -----------------"ssh hadoop102 "$HADOOP_HOME/sbin/stop-dfs.sh"

;;

*)echo "Input Args Error..."

;;

esac

修改脚本执行权限

chmod 777 myhadoop.sh

查看集群所有服务器进程脚本 jpsall

vim jpsall

添加内容如下:

#!/bin/bashfor host in hadoop102 hadoop103 hadoop104

doecho =============== $host ===============ssh $host jps

done

修改脚本执行权限

chmod 777 jpsall

集群分发脚本 xsync

在 /usr/local/bin 目录下创建 xsync 文件

cd /usr/local/bin

vim xsync

添加内容如下:

#!/bin/bash#1 获取输入参数个数,如果没有参数,直接退出

pcount=$#

if((pcount==0)); thenecho no args;exit;

fi#2 获取文件名称

p1=$1

fname=`basename $p1`

echo fname=$fname#3 获取上级目录到绝对路径

pdir=`cd -P $(dirname $p1); pwd`

echo pdir=$pdir#4 获取当前用户名称

user=`whoami`#5 循环

for i in hadoop102 hadoop103 hadoop104

doecho ------------------- $i --------------rsync -rvl $pdir/$fname $user@$i:$pdir

done

修改脚本执行权限

chmod 777 xsync

脚本使用

1)启停 Hadoop 集群全部模块

./myhadoop.sh start

./myhadoop.sh stop

2)查看 Hadoop 集群所有进程

./jpsall

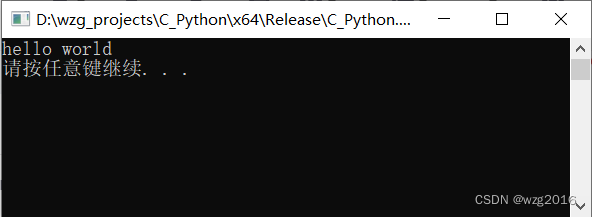

运行代码可以看到 hdfs,yarm,historyserver 三个模块全部启动

查看三台机器所有进程:

hadoop102:NameNode,DataNode,ResourceManager,NodeManager,Jps

hadoop103:DataNode,NodeManager,JobHistoryServer,Jps

hadoop104:DataNode,SecondaryNameNode,NodeManager,Jps

3)分发文件

退回根目录,准备一个 test.txt 文件,

xsync test.txt

在另外两个服务器的根目录下存在 test.txt 即分发成功。