古人有云,物以类聚,在面临信息爆炸问题的今天,对信息类别划分的价值日益显现,并逐步成为学者们的研究热点。分类和聚类是数据挖掘的重要工具,是实现事物类别划分的左右手,聚类又是分类一种特殊的方式。所谓聚类,浅显的讲就是将指定数据集中的个体(或对象)按照某种约定规则划分成若干个类别(也称簇、组),使得划分在同一类中的个体间具有强的共性特征,而分在不同类中的个体间差异最大化。聚类作为一种无监督的机器学习过程,它是基于观察的学习而不是基于实例的学习,所以事先无需确定分类的准则和先验知识,所以和有监督的机器学习方法相比,聚类分析方法更具灵活性。通过聚类分析技术,可以在不受人的先验知识的束缚和干扰的情况下完成对无标识的数据对象类别划分,从而获取数据集合中潜在信息。

随着聚类算法研究的深入,聚类在自然科学和社会科学的各个领域都得到了广泛的应用,例如,搜索引擎门户网站使用聚类来实现信息的快速定位,提高搜索效率;金融机构通过聚类来挖掘客户的资料信息,实现风险的最小化;生物学家通过对含有遗传信息的基因聚类来发现种群间的异同等。

聚类经过近几十年的发展,已经有上千种聚类算法被提出,在最近的十几年的时间里,提出的具有代表性的聚类算法有谱聚类算法、粒子群算法和近邻传播算法等。在现有的众多聚类方法中,K-means算法是使用最普遍最经典的聚类算法之一,算法实现简单,执行效率高。然而,K-means算法是建立在凸球形的样本空间上基于中心的聚类算法,其准则函数是基于梯度的,仅在紧凑的具有超球空间结构的样本集上才能得到较好的聚类结果,当样本集空间结构非凸时,算法就会陷入局部最优划分的困境中。

谱聚类算法对数据的结构分布不做强的假设,在非凸结构的数据集上任然能够得到较好的聚类结果,克服了以经典K-means算法为代表的的基于中心聚类算法的缺点。此外,谱聚类对误差数据和噪声的敏感性不强,具有较好的鲁棒性。在许多实际应用问题中,谱聚类都能取得较好的聚类效果。在最近的十年里,谱聚类方法日益受到学者们的关注并取得了迅猛的发展,和现有的主要聚类方法相比,谱聚类方法的优点明显:

(1)算法实现起来直观、简单、方便,算法的核心问题为权矩阵的特征值分解,是一个经典的代数运算;(2)聚类结果稳定,算法不存在局部最优解;(3)对数据集的空间结构形状不做强的要求,可以产生高质量的聚类结果;(4)理论基础坚实,可以从谱图理论、矩阵扰动理论、图上随机游走理论等多个角度给出合理解释。

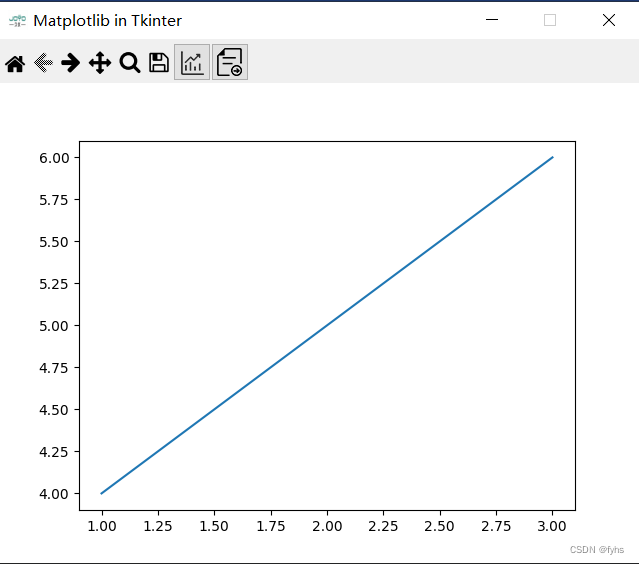

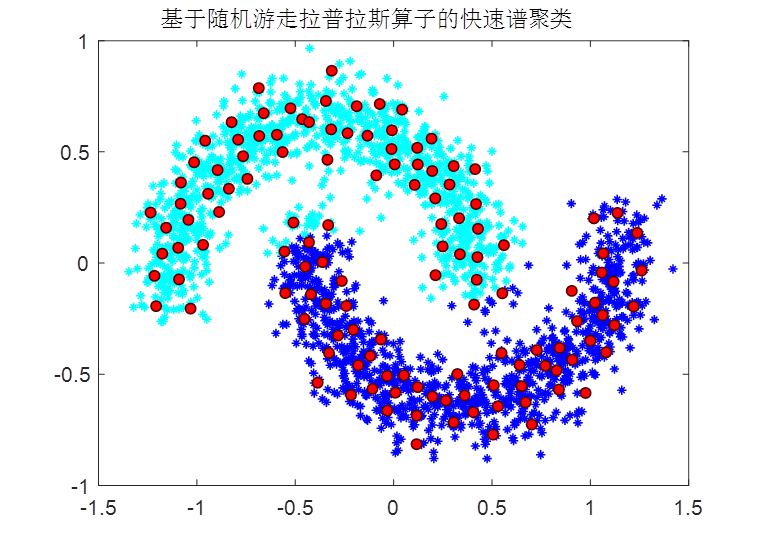

基于此,提出一种基于随机游走拉普拉斯算子的快速谱聚类方法,算法运行环境为MAYLAB R2018A,部分代码如下:

% Fast Spectral Clustering based on RandomWalk Laplacian

% Input:

% - Z: the initial cross similarity matrix between data points and anchors

% - c: the number of clusters

% Output:

% - clustering: the cluster assignment for each point

% Requre:

% mySVD.m

% litekmeans.m

% Usage:

% % X: d*n

% [laKMM, laMM, AnchorGraph, Anchors, ~, ~, ~]= KMM(X', c, m,k) ;Dv=diag(1./sum(Z,1));

U = mySVD(Z+Z*Dv,c+1);

U(:,1) = [];

U=U./repmat(sqrt(sum(U.^2,2)),1,c);

clustering=litekmeans(U,c,'MaxIter',100,'Replicates',10);出图如下:

工学博士,担任《Mechanical System and Signal Processing》审稿专家,担任

《中国电机工程学报》优秀审稿专家,《控制与决策》,《系统工程与电子技术》,《电力系统保护与控制》,《宇航学报》等EI期刊审稿专家。

擅长领域:现代信号处理,机器学习,深度学习,数字孪生,时间序列分析,设备缺陷检测、设备异常检测、设备智能故障诊断与健康管理PHM等。

![k8s节点负载使用情况分析命令kubectl describe node [node-name]](https://img-blog.csdnimg.cn/direct/29bf0da49bfd4015ab54bb07fa292350.png)