- B站:啥都会一点的研究生

- 公众号:啥都会一点的研究生

整理的近期AI相关资讯,一起看看吧~

OpenAI 与 Figure 合作开发AI机器人

Figure 获得了 6.75 亿美元的 B 轮融资,投资方包括 OpenAI、微软和英伟达。在获得投资的同时,Figure 还与 OpenAI 签订了合作协议,共同为仿人机器人开发下一代人工智能模型。这将把 OpenAI 的研究与 Figure 对机器人硬件和软件的深刻理解结合起来

https://www.prnewswire.com/news-releases/figure-raises-675m-at-2-6b-valuation-and-signs-collaboration-agreement-with-openai-302074897.html

Sora 展示了惊人的几何一致性

与 Pika 和 Gen2 等其他模型相比,OpenAI 的 Sora 在视频生成方面表现突出。在 ByteDanc.Inc 最近与武汉大学和南开大学合作进行的基准测试中,Sora 展示了具有高度几何一致性的视频生成能力

基准测试根据生成的视频在真实场景中如何遵循物理原理来评估其质量

https://sora-geometrical-consistency.github.io/

Ideogram 推出文生图v1.0模型

Ideogram 推出了一款名为 Ideogram 1.0 的全新文字转图片应用程序,被称为 “创意助手”,能根据文字提示生成高度逼真的图像,而且错误率极低

与其他应用程序相比,Ideogram 1.0 能将图片生成错误率大大降低一半。用户还可以自定义图片尺寸和样式。因此,它可以生成备忘录、徽标、老式肖像等任何图片

Magic Prompt 能将 "蔬菜绕太阳运行 "等基本提示转化为带有背景故事的完整场景。普通人要一字不差地写出来,得花上好几个小时

测试表明,Ideogram 1.0 在匹配提示、制作合理图片、逼真外观和处理文本方面均优于 DALL-E 3 和 Midjourney V6

https://about.ideogram.ai/1.0

微软推出1-bit LLM

微软推出了一种 1-bit LLM 高效人工智能语言模型。它的每个参数仅使用 1.58 bit,而不是通常的 16 bit,在理解和生成文本方面的表现却与同等大小的传统模型不相上下

在 BitNet 等研究的基础上,每个参数位数的大幅减少将延迟、内存、吞吐量和能耗方面的成本效益提高了 10 倍。尽管只使用了一小部分数据,但 1-bit LLM 仍能保持精度

https://analyticsindiamag.com/microsoft-introduces-1-bit-llm/

阿里巴巴推出 EMO,让照片活起来

阿里巴巴推出了一种名为 “EMO”(Emote Portrait Alive)的人工智能系统,它可以通过一张照片和一段音频片段生成逼真的说话和唱歌视频。可以捕捉面部的细微差别,而无需依赖 3D 模型

EMO 采用两阶段深度学习方法,包括音频编码、通过扩散模型生成面部图像以及参考/音频注意机制

实验表明,该系统在视频质量和表现力方面明显优于现有方法

https://humanaigc.github.io/emote-portrait-alive/

Slack 研究显示,人工智能释放了 41% 的低价值工作时间

Slack 最新的劳动力调查显示,办公人员对人工智能工具的使用激增,在过去一个季度中,使用率增长了 24%,80% 的用户已经看到了生产力的提高。然而,只有不到一半的公司制定了有关采用人工智能的指导原则,可能会阻碍实验的进行。不过凸显了一个机会,即利用人工智能将员工花在重复性、低价值任务上的 41% 的时间自动化。并将精力集中在有意义的战略性工作上

https://d34u8crftukxnk.cloudfront.net/slackpress/prod/sites/6/New-trends-in-AI-use-at-work-from-the-Workforce-Lab-at-Slack-a-Salesforce-company-Winter-2024.pdf

GitHub 推出用于定制化AI编码的 Copilot Enterprise

GitHub 推出了面向大公司开发人员的人工智能助手 Copilot Enterprise。它根据企业的代码库和经验提供定制的代码建议和其他编程支持。整合了整个编码工作流程,以提高工作效率。埃森哲(Accenture)等合作伙伴的早期测试结果表明,该产品大大提高了效率,仅自动完成一项就提高了 50%

https://github.com/features/copilot

Meta的MobileLLM实现了移动设备上的部署

Meta 发布了一篇研究论文,论述了对可在移动设备上运行的高效 LLM 的需求。重点是设计参数少于 10 亿的高质量模型,对移动部署是可行的

通过使用deep and thin architectures、embedding sharing和grouped-query attention,开发出了一种名为 MobileLLM 的强大基准模型,与以前的 125M/350M 最先进模型相比,准确率提高了 2.7%/4.3%

https://arxiv.org/pdf/2402.14905.pdf

DeepMind 的全新AI模型瞬间创造出交互世界

谷歌 DeepMind 推出了一种新的生成式人工智能模型–Genie(生成式交互环境),它可以从数十万个游戏视频中学习游戏机制,然后根据简单的提示创建可玩的视频游戏。根据用户的提示,用一张图片创建如《超级马里奥兄弟》和《魂斗罗》等

Genie可以用它从未见过的图像(如现实世界的照片或草图)进行提示,使人们能够与他们想象中的虚拟世界进行互动–本质上就是充当一个基础世界模型。尽管在没有任何动作标签的情况下进行了训练,但这仍然是可能的

https://sites.google.com/view/genie-2024/home

Mistral Large:GPT-4 新对手,史上第二好的 LLM

法国人工智能初创公司 Mistral 推出了迄今为止最大的 LLM 和旗舰模型 Mistral Large,拥有 32K 上下文窗口。该模型具有顶级推理能力,可用于复杂的多语言推理任务,包括文本理解、转换和代码生成

它能说流利的英语、法语、西班牙语、德语和意大利语,对语法和文化背景有细致入微的理解,还在编码和数学任务中表现出色

Mistral Large 现在可以通过内部平台 "La Plateforme "和微软的 Azure AI API 使用

https://mistral.ai/news/mistral-large/

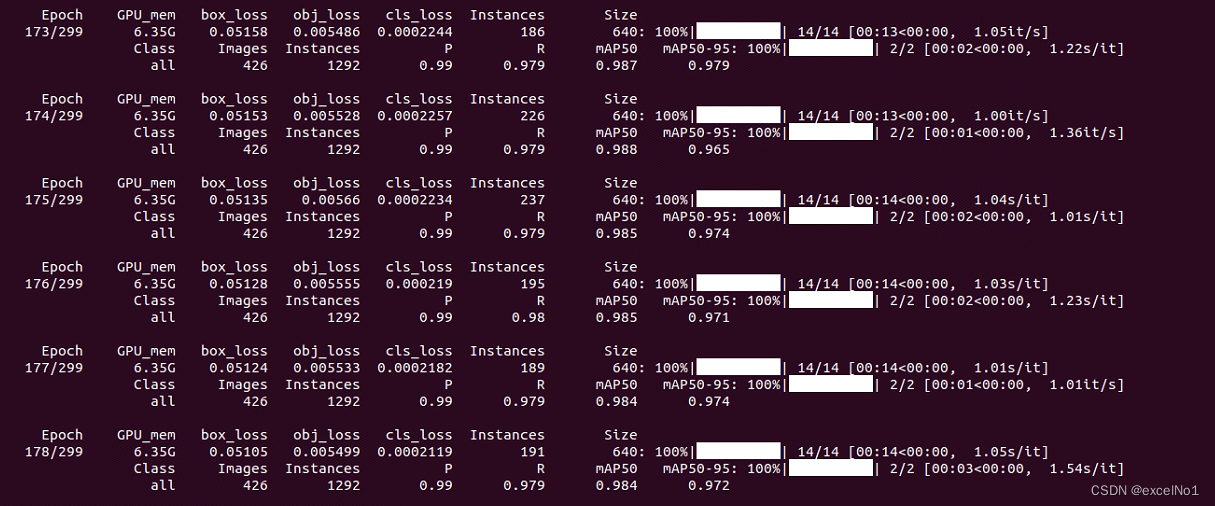

YOLOv9,YOLO目标检测系列最新最强模型

继 2023 年 1 月 YOLOv8 正式发布一年多以后,YOLOv9 终于来了。YOLOv9 深入研究了数据通过深度网络传输时数据丢失的重要问题,即信息瓶颈和可逆函数。提出了可编程梯度信息(programmable gradient information,PGI)的概念。此外,基于梯度路径规划设计了一种新的轻量级网络架构,即通用高效层聚合网络

通过引入两项新技术,YOLOv9 与前代产品 YOLOv8 相比,参数减少了 49%,计算量减少了 43%,同时在关键基准测试中的准确率提高了 0.6%

https://the-decoder.com/yolov9-improves-real-time-object-recognition-accuracy-with-less-computation/

补齐Transformer规划短板,Searchformer来了

Meta 公司的一篇新论文介绍了一种 Transformer 模型–Searchformer,它在迷宫导航和推箱子谜题等复杂规划任务中的性能超过了 A* 搜索等传统算法。Searchformer 分两个阶段进行训练:首先模仿 A* 搜索学习一般规划技能,然后通过专家迭代对模型进行微调,以更高效地找到最优解

关键的创新之处在于使用了搜索增强的训练数据,为 Searchformer 提供了每个规划任务的执行轨迹和最终解决方案。与只看到解决方案的模型相比,这使得学习更具数据效率。不过,编码完整的推理轨迹会大大增加训练序列的长度。尽管如此,Searchformer 还是展示了有望超越符号规划算法的人工智能训练技术

https://arxiv.org/pdf/2402.14083.pdf