这篇论文是发表在 2023 ICCV 上的一篇工作,主要介绍利用自监督学习进行降噪的。

Abstract

随着深度学习工具的兴起,越来越多的图像降噪模型对降噪的效果变得更好。然而,这种效果的巨大进步都严重依赖大量的高质量的数据对,这种对大量训练的依赖,在真实环境中比较难获取,这在一定程度上限制了这些降噪模型的实际应用。为了克服对数据的依赖,很多研究者也开始探索自监督的学习方法,这类方法可以不依赖成对的数据。然而,由于噪声先验的不可获得以及特征提取不够有效,同样也让这类自监督学习方法实用性及精确性大打折扣。这篇文章提出了一个 Denoise-Corrupt-Denoise (DCD)的自监督学习的流程框架。具体来说,他们设计了一个迭代训练的策略,可以迭代地优化降噪模型以及噪声估计器,这样可以仅仅使用单张的有噪图像,从而逐渐逼近高质量的降噪效果,并且不依赖噪声的分布先验。文章提出的这种方法在仿真数据和真实数据上都取得了很不错的降噪效果。

Method

在正式介绍方法之前,文章作者先回顾了一下利用自监督学习的两个经典工作,Noise to Noise (N2N) 以及 Noise to void (N2V)。假设有一组观测到的噪声图像 y 1 , y 2 , . . . , y M \mathbf{y}_1, \mathbf{y}_2, ... , \mathbf{y}_M y1,y2,...,yM,都来自同一张清晰图像 x \mathbf{x} x,通过叠加不同的噪声 n 1 , n 2 , . . . , n M \mathbf{n}_1, \mathbf{n}_2, ... , \mathbf{n}_M n1,n2,...,nM 得到:

y i = x + n i i ∈ { 1 , 2 , . . . , M } (1) \mathbf{y}_i = \mathbf{x} + \mathbf{n}_i \quad i \in \{1, 2, ... , M \} \tag{1} yi=x+nii∈{1,2,...,M}(1)

N2N 这个工作从理论上证明了,对于深度降噪模型 f ( ⋅ ; θ ) f(\cdot; \theta) f(⋅;θ) 的优化问题,最小化预测值与真实值之间的 L 2 L_2 L2 loss,等价于最小化两个独立分布的带噪观测图像之间的 L 2 L_2 L2 loss。

arg min θ E [ ∥ f ( y ; θ ) − x ∥ 2 2 ] = arg min θ E [ ∥ f ( y j ; θ ) − y k ∥ 2 2 ] (2) \argmin_{\theta} \mathbb{E}[\left \|f(\mathbf{y}; \theta) - \mathbf{x} \right \|_{2}^{2}] = \argmin_{\theta} \mathbb{E}[\left \|f(\mathbf{y}_j; \theta) - \mathbf{y}_{k} \right \|_{2}^{2}] \tag{2} θargminE[∥f(y;θ)−x∥22]=θargminE[∥f(yj;θ)−yk∥22](2)

其中, j , k ∈ { 1 , 2 , . . . , M } , j ≠ k j, k \in \{1, 2, ..., M \}, j \neq k j,k∈{1,2,...,M},j=k

也就是说,正常的降噪模型训练是要用 noise-clean 图像对的,N2N 的这个工作,将 nosie-clean 的图像对,转换成了 noise-nosie 的图像对,只有这个 nosie-nosie 来自同一张潜在的清晰图,类似于对同一个场景,拍了不同 ISO 设置的带噪图像,这些图像对之间是可以作为训练数据对的。

然后,N2V 这个工作更进一步的拓展了自监督学习降噪的方式,N2N 需要两张带噪的图像,N2V 只需要一张带噪的图像,其目标函数如下所示:

arg min θ E [ ∥ f ( y R F ( p ) ; θ ) − y ( p ) ∥ 2 2 ] (3) \argmin_{\theta} \mathbb{E}[\left \| f(\mathbf{y}_{RF(p)};\theta) - \mathbf{y}(p) \right \|_{2}^{2} ] \tag{3} θargminE[ f(yRF(p);θ)−y(p) 22](3)

其中, p p p 表示像素的坐标, y R F ( p ) \mathbf{y}_{RF(p)} yRF(p) 表示以像素 p 为中心的一个邻域,除掉像素 p 本身。这样的网络设计称为 blind-spot 网络,能够避免网络学习成一个恒等映射,这也比较好理解,如果 y R F ( p ) \mathbf{y}_{RF(p)} yRF(p) 也包含了像素 p,那这个映射可以变成一个 p 这个位置的权重为 1,其它地方的权重为 0 的恒等映射了。

后续的自监督学习方法,基本是基于 N2N 或者 N2V 的改进。

文章作者也提到,基于之前的一些工作的评估和他们的一些经验,N2N 的降噪表现在真实数据集上还是比不上基于 nosie-clean 的强监督学习的效果。不过,在一些仿真数据集上,也有一些之前的工作指出,如果 N2N 模型见过足够多的训练样本,那么 N2N 的降噪表现可以和强监督学习的模型相当,而且比很多 SOTA 的自监督降噪模型的效果要好。这个现象或许可以解释成,在仿真数据集上训练的时候,可以提供足够多含有不同噪声分布的样本,而在真实数据集上,噪声分布比较单一,N2N 模型的降噪能力很难提升。另外,根据另外一些已有工作发表的结果,文章作者观察到 N2N 这类工作的数据生成方法,基本取决于真实的噪声分布(一般很难获取),或者受到不成对的 GT 的影响。文章作者最终总结出以下结论:如果给定足够多的训练样本,

- N2N 模型能够取得和强监督学习模型一样的降噪效果

- N2N 模型也超越了现有的一些自监督学习方法

总之,文章作者认为,一个训练充分的 N2N 模型可以作为自监督学习的一个较强的 baseline,因此,文章作者希望能够优化的降噪模型能够逐渐逼近 N2N 模型的表现。

为了挖掘 N2N 模型的潜能,获取足够多的,并且准确的 N2N 训练样本对是关键。虽然之前的一些工作尝试从单张的带噪图像中构建训练数据对,这些数据对会受到累积误差的影响。文章作者认为需要清晰图像来生成训练数据对,为了构建带噪图像,另外一个需要知道的要素是噪声的分布,包括噪声模型和噪声水平,文章中利用一个高斯近似来模拟:

n = N ( 0 , σ d 2 x + σ i 2 ) (4) \mathbf{n} = \mathcal{N}(0, \sigma_d^{2}\mathbf{x} + \sigma_i^{2}) \tag{4} n=N(0,σd2x+σi2)(4)

σ d 2 , σ i 2 \sigma_d^{2}, \sigma_i^{2} σd2,σi2 分别表示与信号相关以及与信号无关的方差,文章中也是使用这个分布,不过具体的 σ d 2 , σ i 2 \sigma_d^{2}, \sigma_i^{2} σd2,σi2是需要估计的,所以文章中也用了一个噪声估计模型来估计噪声的水平。

文章最后提到,为了获得和 N2N 类似的降噪效果,需要两个先决条件:

- 一是足够好的降噪网络 f ( ⋅ , θ ) f(\cdot, \theta) f(⋅,θ)

- 二是准确的噪声估计模型 ε ( ⋅ ) \mathcal{\varepsilon}(\cdot) ε(⋅)

文章作者提出了 Denoise-Corrupt-Denoise 的流程框架,可以迭代的优化降噪模型和噪声估计器:

-

Pre-Denoise

首先,用降噪模型对单张图像进行降噪,得到预测的清晰图像:

x ^ = f ( y , θ ) (5) \hat{\mathbf{x}} = f(\mathbf{y}, \theta) \tag{5} x^=f(y,θ)(5)

-

Corrupt

接下来,从带噪图像 y \mathbf{y} y 以及预测的清晰图像 x ^ \hat{\mathbf{x}} x^ 中预测噪声水平,得到像素级的噪声水平分布图

M n l = ε ( y , x ^ ) (6) \mathbf{M}_{nl} = \mathcal{\varepsilon} (\mathbf{y}, \hat{\mathbf{x}}) \tag{6} Mnl=ε(y,x^)(6)

这个噪声水平图 M n l \mathbf{M}_{nl} Mnl 用来对预测的清晰图像进行加噪,从而可以得到两张不同的带噪图像,他们与原始的图像 y \mathbf{y} y 含有相同的噪声水平。在加噪的时候,作者使用了重参数化的技巧:

y n i = x ^ + z i ∗ M n l z i ∈ N ( 0 , 1 ) , i ∈ { 1 , 2 } (7) \mathbf{y}_{ni} = \hat{\mathbf{x}} + \mathbf{z}_i \ast \mathbf{M}_{nl} \quad \mathbf{z}_{i} \in \mathcal{N}(0, 1), i\in \{1, 2\} \tag{7} yni=x^+zi∗Mnlzi∈N(0,1),i∈{1,2}(7)

文章中用了 resent blocks 作为噪声估计模块,设计了一种 patch variance loss 进行训练:

L p v = ∑ i ∥ V a r ( P ( y n i , p ) ) − V a r ( P ( y , p ) ) ∥ (8) \mathcal{L}_{pv} = \sum_{i} \left \| Var(\mathcal{P}(\mathbf{y}_{ni}, p)) - Var(\mathcal{P}(\mathbf{y}, p)) \right \| \tag{8} Lpv=i∑∥Var(P(yni,p))−Var(P(y,p))∥(8)

其中, P ( ⋅ , p ) \mathcal{P}(\cdot, p) P(⋅,p) 表示提取 p × p p \times p p×p 个图像块

-

N2N Denoise

基于前面的加噪之后,可以得到两张不同噪声水平的含噪图像,然后就可以用 N2N 的方式进行降噪模型的训练:

L N 2 N = ∥ f ( y n 1 ) − f ( y n 2 ) ∥ 2 2 (9) \mathcal{L}_{N2N} = \left \| f(\mathbf{y}_{n1}) - f(\mathbf{y}_{n2}) \right \|_{2}^{2} \tag{9} LN2N=∥f(yn1)−f(yn2)∥22(9)

通过上面几部的迭代训练,降噪模型与噪声估计模型不断得到优化提升,最终的降噪效果可以逼近 N2N 的效果。

-

Blind-Spot Network for Initial Denoising

虽然原始的 Denoise-Corrupt-Denoise 算法框架可以从单张带噪图像逐渐生成成对的带噪图像,不过也依赖一个先决条件,需要一个大概的降噪估计。没有一个降噪估计,那 x ^ \hat{\mathbf{x}} x^ 可能和输入的 y \mathbf{y} y 基本一样,这样估计出来的噪声水平是一个 zero mapping。为了解决这个问题,文章作者开始的时候用 blind-spot networks 先做降噪。

L B S N = ∥ f ( y R F ; θ ) − y ∥ 2 2 (10) \mathcal{L}_{BSN} = \left \| f(\mathbf{y}_{RF}; \theta) - \mathbf{y} \right \|_2^{2} \tag{10} LBSN=∥f(yRF;θ)−y∥22(10)

训练的时候,文章是迭代的去训练,并且迭代的时候,也会对降噪网络和噪声估计模型分开训练,总的训练 loss 为:

L = μ L p v + γ L N 2 N + λ L B S N (11) \mathcal{L} = \mu \mathcal{L}_{pv} + \gamma \mathcal{L}_{N2N} + \lambda \mathcal{L}_{BSN} \tag{11} L=μLpv+γLN2N+λLBSN(11)

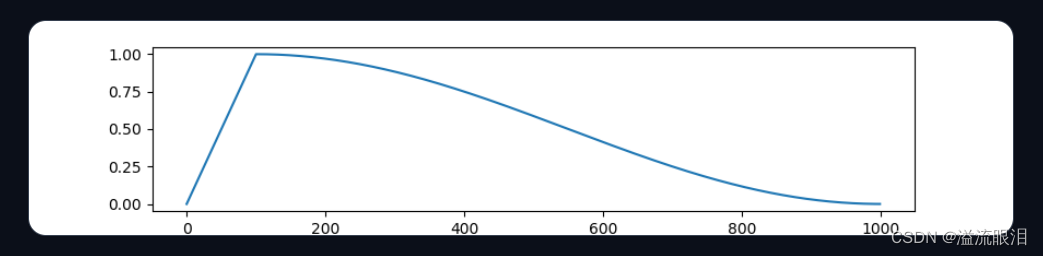

在训练开始阶段, λ \lambda λ 设置的很大, γ \gamma γ 设置的很小,让 BSN 占主导,随着训练的进行, λ \lambda λ 逐渐减小, γ \gamma γ 逐渐增大,训练逐渐向 N2N 的方式靠近。

所以这篇文章总的来说,是用单张的带噪图,通过迭代式的 Denoise-Corrupt-Denoise 的方式,逼近了类似有带噪数据对的 N2N 的方式。