LLM2Vec:重新定义大语言模型在自然语言处理中的应用

一种名为 ** LLM2Vec ** 的新方法正在改变我们对大语言模型(LLMs)在自然语言处理(NLP)中的使用方式。

研究人员提出了一种创新方法,将通常仅用于生成文本的大型语言模型转化为更强大的文本理解和组织工具。这项技术有可能颠覆我们处理各种与文本相关任务的方式,并减少对诸如BERT等旧有模型的依赖。

以下是LLM2Vec的核心发现及其如何提升LLMs处理文本能力的详解。

研究动机

大型语言模型(如GPT-4)在生成多种任务的文本方面表现出色。但在需要深度理解的任务(例如 ** 信息检索、文本分组或理解单词间的关系 ** )中,这些模型的表现并不理想。问题主要出在其 ** 因果注意力机制(causal attention mechanism)**上。

因果注意力机制的特点是每个单词只能关注之前的单词,这限制了对整个句子意义的全面理解。而LLM2Vec正是为了解决这个问题。

它通过简单但强大的三步方法提升模型性能:

- 启用双向注意力(Bidirectional Attention)

- 掩码下一词预测(Masked Next Token Prediction,MNTP)

- 无监督对比学习(Unsupervised Contrastive Learning,SimCSE)

通过这些技术,LLM2Vec只需少量额外训练,即可让常规的LLM在文本理解和表示上表现得更加出色。

LLM2Vec原理

LLM2Vec的核心思想是重新思考大语言模型如何读取文本。它不再局限于只关注先前的单词,而是让模型能够同时关注整个句子或段落。这极大提升了模型的理解能力。

具体工作机制如下:

1. 启用双向注意力(Bidirectional Attention)

普通的LLM中,每个单词只能关注之前的单词,即因果注意力机制。这种机制虽然适合生成文本,但很难生成深度和细致的文本表示。

LLM2Vec通过将因果注意力掩码(causal attention mask)更改为全1掩码(all-ones attention mask),实现了双向注意力。

论文中的图1展示了LLM2Vec如何通过改变注意力掩码,将每个单词的注意力范围扩展到整个序列。这种方式允许每个单词同时考虑上下文中的所有其他单词,从而显著提升模型对语境的理解能力。

然而,仅启用双向注意力并不足以优化模型。因为原始模型的训练方式不同,仍需进一步调整才能充分利用双向注意力。这就是下一步的作用。

2. 掩码下一词预测(Masked Next Token Prediction, MNTP)

为了让模型适应双向注意力,LLM2Vec采用了一种名为掩码下一词预测(MNTP)的技术。MNTP类似于BERT的掩码机制,但针对这种模型进行了调整。

在此步骤中,模型会隐藏句子中的某些单词,然后通过查看其他所有单词(包括隐藏单词之前和之后的上下文)来预测这些单词。

上图展示了MNTP的工作原理。模型通过使用上下文信息预测隐藏的单词,增强了捕获单词间关系的能力。

这一步帮助模型习惯于同时关注前后文,从而更好地理解和表示文本。

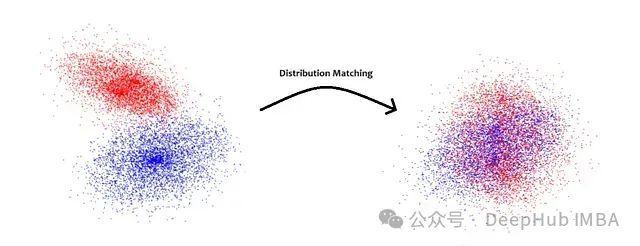

3. 无监督对比学习(SimCSE)

最后一步是SimCSE,它帮助模型理解不同的文本序列。对比学习通过让模型区分相似句子和不同句子,提升了生成高质量句子或段落表示的能力。

图1还展示了SimCSE的流程,模型通过对比学习训练,能够更好地区分相似和不同的句子,从而提高句子表示的质量。

这三步让LLM2Vec能够将任何大型语言模型转化为一个在各种NLP任务中都非常实用的文本理解和表示工具。

LLM2Vec实验

研究人员使用从1.3亿到8亿参数不等的主流LLMs,测试了LLM2Vec的性能。他们在** 分块(chunking)** 、** 命名实体识别(NER)和词性标注(POS)** 等单词级和句子级任务中,对模型进行了评估。

同时,他们使用了著名的基准测试集,如CoNLL-2003和Massive Text Embeddings Benchmark (MTEB),以衡量模型性能。

上图展示了LLM2Vec改造后的模型(如S-LLaMA-1.3B、LLaMA-2–7B和Mistral-7B)在分块、NER和POS等任务上的表现,并与传统编码器模型进行了对比。结果显示,LLM2Vec模型在多个任务中显著优于传统的编码器模型。

尤其是加入SimCSE后,LLM2Vec在整个句子的理解方面表现更加优异,在MTEB无监督模型排行榜上取得了最高分。

为什么Mistral-7B表现突出

一个令人惊讶的发现是,Mistral-7B表现极为出色。开启双向注意力后,其性能几乎没有下降,且与原始设置的性能非常接近。这可能表明Mistral-7B在训练过程中已经使用了某些双向特性。

论文图8通过比较Mistral-7B与其他模型(如S-LLaMA-1.3B和LLaMA-2–7B)的因果注意力与双向注意力性能,进一步说明了Mistral-7B在无需额外训练情况下,天然适配双向学习的优势。

LLM2Vec与监督学习的结合

研究人员还测试了在监督对比学习下使用LLM2Vec的效果,使用了约150万样本的数据集。

结果显示,Meta-LLaMA-3–8B + LLM2Vec在仅使用公开数据训练的模型中,达到了最先进的性能,并在文本嵌入任务中创下了新记录。

上表汇总了MTEB排行榜的结果,比较了Meta-LLaMA-3–8B与其他模型的性能,进一步验证了LLM2Vec结合监督对比学习的强大能力。

LLM2Vec为何优于现有方法

LLM2Vec的主要优势之一是其高效性。相比于通过复制文本来解决注意力问题的Echo嵌入方法,LLM2Vec无需增加额外的文本长度。

Echo嵌入会使文本长度加倍,导致处理速度变慢;而LLM2Vec保持了原始文本长度,因而更加快速高效。

意义与未来方向

LLM2Vec在提升LLMs文本理解能力方面迈出了重要一步。它证明了仅解码器模型也可以通过小幅改动变成强大的文本理解工具。这为信息检索、文本分组以及其他NLP任务带来了新的可能性,同时无需大量额外数据或长时间训练。

未来,研究人员计划尝试将LLM2Vec模型微调到多语言环境,并应用于低资源环境中。

由于LLM2Vec所需的额外工作量较少,它在资源匮乏的环境中特别具有应用潜力,有望让高级NLP工具更广泛地被采用。

本文由博客一文多发平台 OpenWrite 发布!