AI 生成的图像 | Flux Labs AI 制作

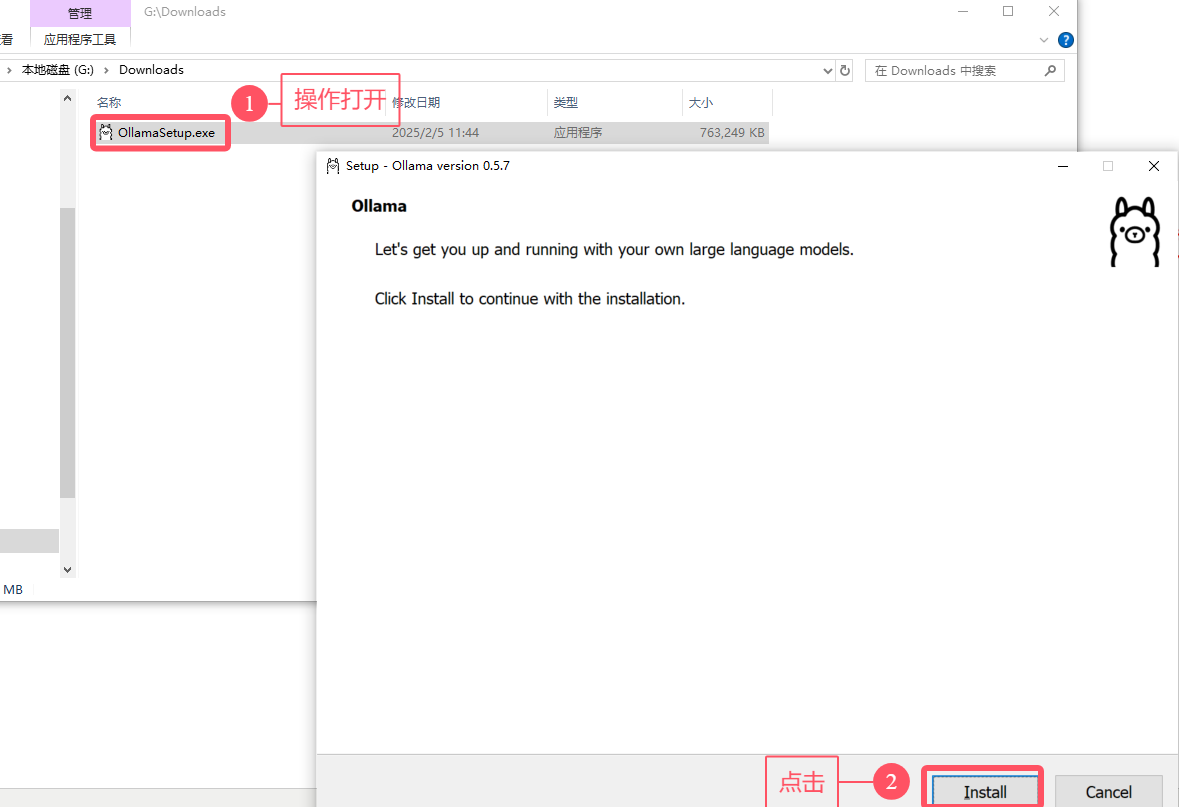

想象一下,你走进一场面试,还没开口,AI 面试官就已经根据你的脸对你做出评估。这是不是 “以貌取人 2.0”?这算是歧视吗?还是 AI 正在推动一种新的 “面相主义”(face-ism)?

最近,来自多所大学的研究人员进行了一项研究,他们声称 AI 仅凭分析面部照片,就能预测你的职业和教育成就。这个研究势必会引发一场关于伦理和科学的大辩论,成为一个极具争议的话题。

但这到底是怎么做到的?

AI 真的能从脸上读出性格特征,并用它来预测一个人的未来成就吗?如果可以,那它的准确性到底如何?

从面部图像提取性格特征

研究团队开发了一套名为 “Photo Big 5” 的系统,该系统能从单张面部照片中提取个性特征。

“Big Five”人格特质(又称 OCEAN 模型)是心理学界广泛认可的衡量行为与成功的关键指标,包括:

• 开放性(Openness): 代表好奇心和创造力。

• 尽责性(Conscientiousness): 体现组织能力、责任感和勤奋度。

• 外向性(Extraversion): 反映社交能力和自信程度。

• 宜人性(Agreeableness): 体现同理心与合作精神。

• 神经质(Neuroticism): 关联情绪不稳定和焦虑水平。

研究团队用 9.6 万名美国顶级商学院 MBA 毕业生的面部照片 训练 AI 模型,让它学习面部特征与职业成就之间的关联,例如:薪资水平、职位变迁、学校排名

突破点:AI 可在大规模范围内提取性格特征,无需传统问卷调查

这种方法的最大优势在于,它 不依赖传统的性格测试问卷,而是通过计算机视觉 批量识别人格特质。这对 招聘 和 高校招生 可能带来重大变革。

AI 如何预测你的未来成功?

该方法的核心依赖于 神经网络,这些网络基于大规模面部数据集进行训练,学习面部特征与不同人格特质之间的微妙关联。

研究表明,基因与早期成长经历都会影响人的面部结构和性格,这或许解释了为什么某些面部特征会与特定性格相关。

例如:

• 如果你的照片显示你倾向于 神经质(Neuroticism),那么你可能 更难被录取或雇佣。

• 如果你的面部特征显示你 缺乏尽责性(Conscientiousness),那么大学招生官可能 不会优先考虑你,因为他们更倾向录取 未来有高成就潜力的学生。

AI 还发现,“理想”人格特质(如高尽责性和高外向性)往往与更高的起薪和更好的薪资增长率相关。

令人惊讶的是,这些人格特征对职业成功的预测力,甚至可以媲美种族、外貌和教育水平。

AI 主要分析以下面部特征:

• 面部对称性

• 下颌线与颧骨结构

• 眼睛位置与表情

研究发现,尽责性(Conscientiousness) 和 外向性(Extraversion) 是 职业成就的关键预测因素。比如:

• 尽责性高的人,通常薪资较高,职业晋升较快。

• 这些预测结果具有 长期稳定性,即使多年后的照片 AI 仍能做出相似的性格评估。

但,这项技术是否真的应该用于招聘或教育筛选?

AI 进行种族分类

研究团队使用 Revelio Labs 的数据进行种族分类,该系统通过 姓名、姓氏和地理位置 预测个人的种族或族裔。

该模型基于 美国人口普查数据 训练,并结合 VGG-Face(一种深度学习算法,由 Serengil 和 Ozpinar 在 2020 年开发)。AI 采用两种方法相结合的方式,将个体分类为:亚裔(Asian)、黑人(Black)、西班牙裔(Hispanic)、白人(White)、其他(Other)

为了提高准确性,研究人员还参考了 MBA 录取时的 自我申报种族数据,在 AI 预测与自我申报不一致时,系统会选择准确率较高的方式进行调整。

然而,这种方法仍然存在 潜在偏见 的争议。面部特征受基因与环境共同影响,可能无法简单归类到固定的种族类别。同时,使用 AI 进行种族分类可能会加剧刻板印象,如果管理不当,可能带来伦理风险。

这真的靠谱吗?

对于 AI 通过 单张照片预测未来成功,人们的怀疑是合理的。批评者认为,这种方法可能 加剧偏见,强化刻板印象。例如:

• 如果 AI 训练数据 缺乏多样性,可能导致偏差,使某些人群在预测中 被系统性忽视或误判。

• 性格是复杂的,它不仅仅由面部决定,还受到 成长经历、环境和主观努力的影响。

即使 AI 能检测到统计学上的关联,但这不代表因果关系。换句话说:

• 你的脸型暗示某种人格,不代表你的行为一定符合该人格。

此外,还有 伦理问题:

• 企业和大学是否应该使用 AI 进行性格筛选?

• 这是否会导致一个“以貌取人”的反乌托邦社会?

• 这种做法是否剥夺了个体成长与改变的机会?

研究人员表示,他们 不提倡将该技术用于招聘,因为以面部特征判断人的能力存在严重伦理问题,可能会导致基于 不可变特征 的歧视。

伦理与现实影响

如果该技术被大规模应用,它可能彻底改变 人才筛选方式。比如:

• 公司可能使用 AI 筛选申请人,选择“更可能成功”的候选人。

• 学校可能优先录取 AI 评估为“最具潜力”的学生。

但这样的做法 可能会面临法律挑战,因为许多国家的反歧视法律 禁止基于外貌特征的招聘或录取。即使 AI 的评估 在统计学上有效,它仍然可能被视为歧视。

此外,隐私问题 也是一个关键风险:

• 机构如何获取和存储面部数据?

• 这些数据会不会被滥用或黑客窃取?

结论

让 AI 通过 一张照片预测你的未来,听起来像科幻小说,但它已经成为现实。然而,能做一件事,并不意味着我们应该去做,尤其是当它可能影响人的职业和人生时。

我们是否可以为该技术设置安全防护?

我们能否在创新与人类尊严、隐私之间找到平衡?

人类的潜力并非一成不变,而是通过 经历、机会和努力 逐步成长的。如果 AI 仅凭一张照片就决定你的未来,那不仅是 去人性化的,更是 短视的。

目前,这项技术是否该被应用,仍然是社会需要慎重考虑的问题。