1、本地部署deepseek-R1模型

通过官网 https://ollama.com 下载安装 ollama

选择自身GPU显存适合的 模型,这里我用的8b

ollama run deepseek-r1:8b

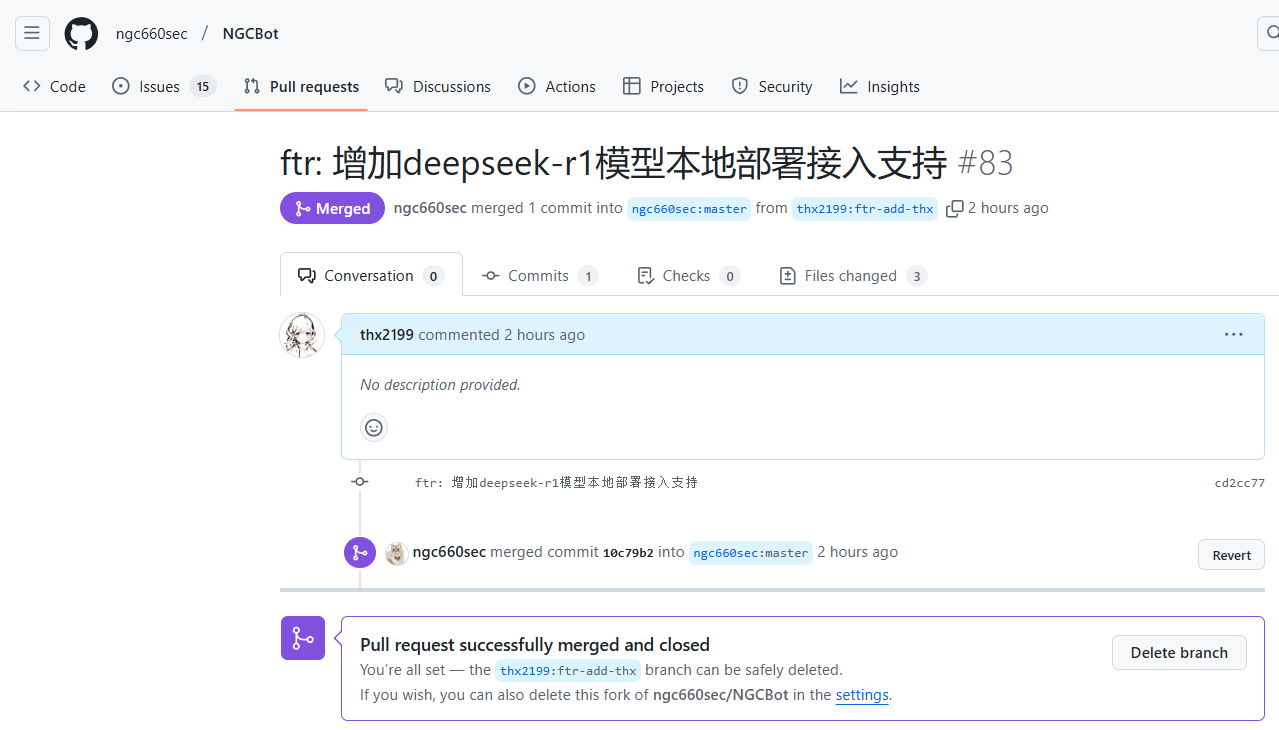

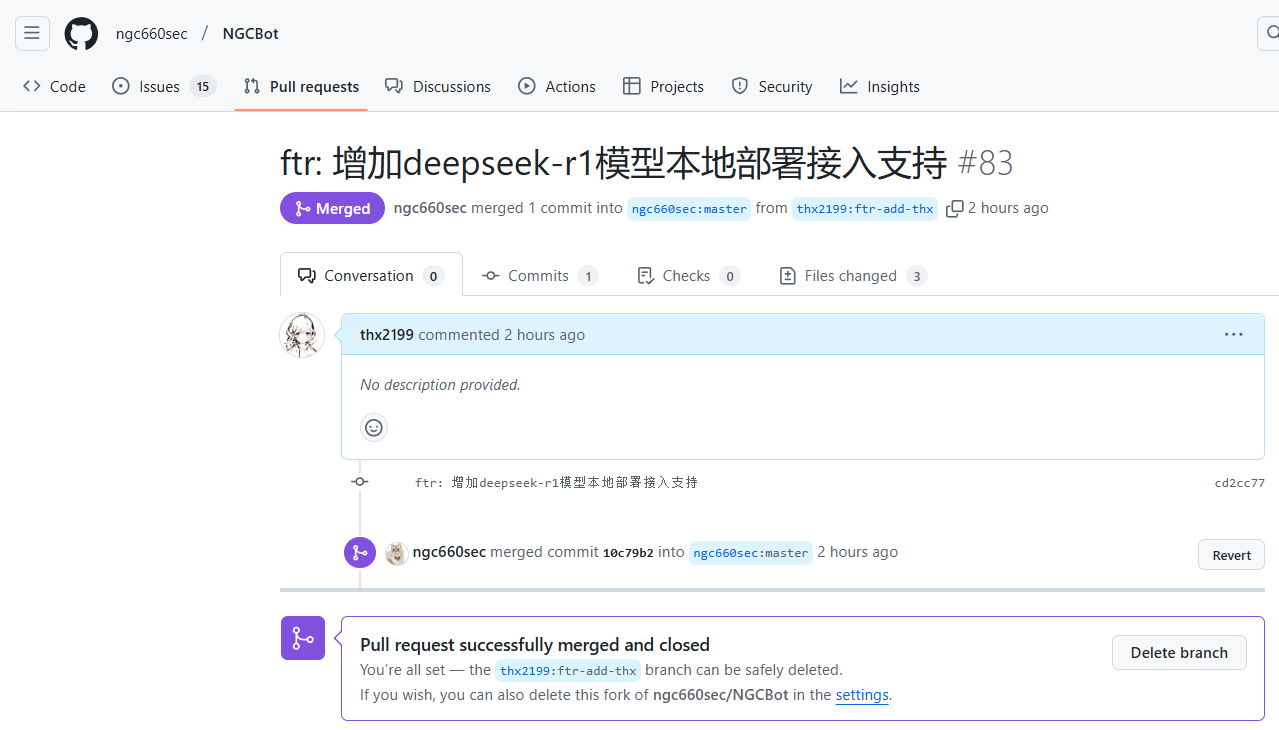

2、hook wechat接入对话

通过项目 https://github.com/ngc660sec/NGCBot hook wechat

想必这种方式会比docker+cow网页版登录的方式安全很多(问就是之前被封过)

通过官网 https://ollama.com 下载安装 ollama

选择自身GPU显存适合的 模型,这里我用的8b

ollama run deepseek-r1:8b

通过项目 https://github.com/ngc660sec/NGCBot hook wechat

想必这种方式会比docker+cow网页版登录的方式安全很多(问就是之前被封过)

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.hqwc.cn/news/879261.html

如若内容造成侵权/违法违规/事实不符,请联系编程知识网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!