目录

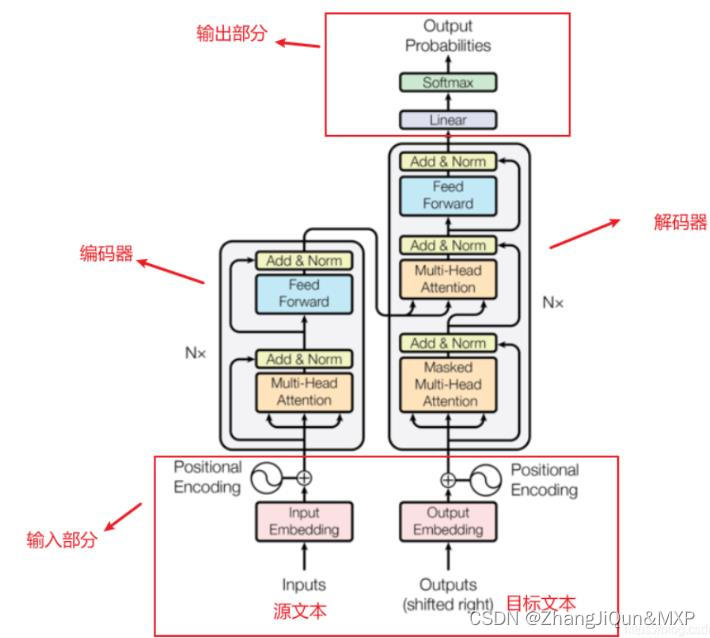

transform 模型常见问题

transform 模型常见问题

1.Transformer为何使用多头注意力机制?(为什么不使用一个头)

答:多头可以使参数矩阵形成多个子空间,矩阵整体的size不变,只是改变了每个head对应的维度大小,这样做使矩阵对多方面信息进行学习,但是计算量和单个head差不多。

2.Transformer为什么Q和K使用不同的权重矩阵生成,为何不能使用同一个值进行自身的点乘?

答:请求和键值初始为不同的权重是为了解决可能输入句长与输出句长不一致的问题。并且假如QK维度一致,如果不用Q,直接拿K和K点乘的话,你会发现attention score 矩阵是一个

![蓝桥杯刷题 深度优先搜索-[NewOJ P1158]N皇后(C++)](https://img-blog.csdnimg.cn/img_convert/f23b0934bc3f31c4a5b3a5966f41919d.png)