深入理解PyTorch中的NoamOpt优化器

作者:安静到无声 个人主页

今天,我们将深入探讨一个在自然语言处理领域广泛使用的优化器——NoamOpt。这个优化器是基于PyTorch实现的,并且在"Attention is All You Need"这篇论文中首次提出。

什么是NoamOpt?

NoamOpt是一种特殊的学习率调度策略,它结合了两种不同的学习率调度方法:线性预热和逆平方根调度。这种组合使得模型在训练初期可以有较大的学习率以快速收敛,而在后期通过降低学习率来微调模型参数,从而避免过拟合。

NoamOpt的工作原理

NoamOpt的核心思想是动态调整学习率。具体来说,它会在训练的初始阶段线性地增加学习率,然后在达到某个点后,开始按照步骤的逆平方根进行衰减。这种策略的数学形式如下:

lr = scale_factor * (model_dim ** -0.5) * min(step_num ** -0.5, step_num * warmup_steps ** -1.5)

其中,scale_factor是缩放因子,model_dim是模型的维度,step_num是当前的步数,warmup_steps是预热步数。

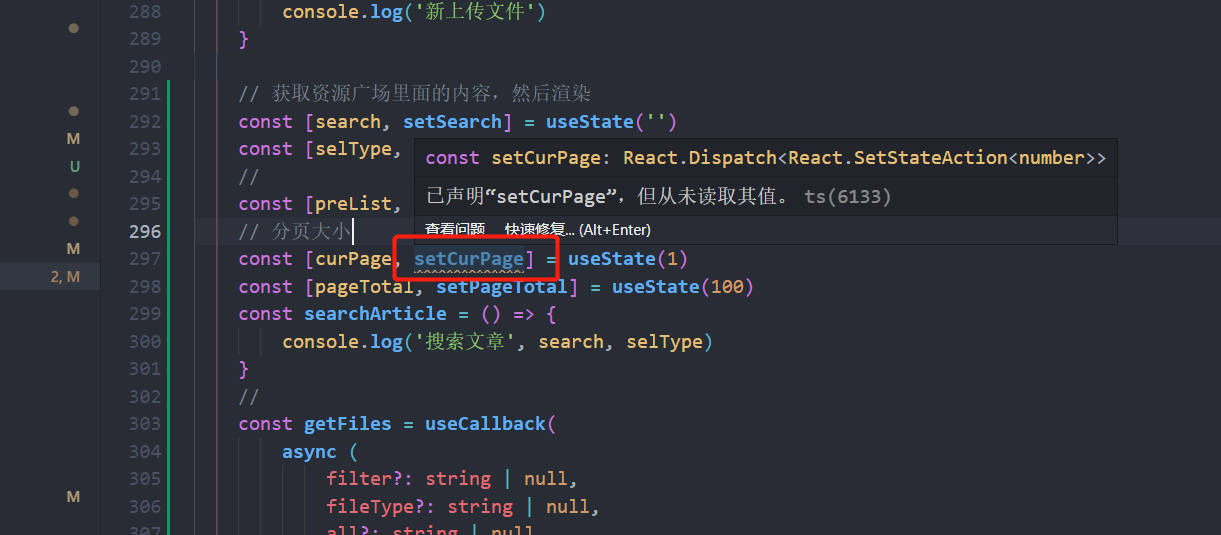

在PyTorch中实现NoamOpt

在PyTorch中,我们可以通过定义一个新的Optimizer类来实现NoamOpt。以下是一个简单的示例:

class NoamOpt:def __init__(self, model_size, factor, warmup, optimizer):self.optimizer = optimizerself._step = 0self.warmup = warmupself.factor = factorself.model_size = model_sizeself._rate = 0def step(self):self._step += 1rate = self.rate()for p in self.optimizer.param_groups:p['lr'] = rateself._rate = rateself.optimizer.step()def rate(self, step = None):if step is None:step = self._stepreturn self.factor * (self.model_size ** (-0.5) *min(step ** (-0.5), step * self.warmup ** (-1.5)))

在这个类中,step()函数用于更新学习率并执行优化步骤,rate()函数则用于计算当前步骤的学习率。

结论

NoamOpt优化器是一种强大的学习率调度策略,尤其在处理Transformer模型时表现出色。通过适当地调整学习率,我们可以更有效地训练模型,同时避免过拟合。希望这篇文章能帮助你更好地理解NoamOpt优化器,以及如何在PyTorch中实现它。

推荐专栏

🔥 手把手实现Image captioning

💯CNN模型压缩

💖模式识别与人工智能(程序与算法)

🔥FPGA—Verilog与Hls学习与实践

💯基于Pytorch的自然语言处理入门与实践