须知事项

此 API 需要 Android API 级别 19 或更高级别。确保应用的 build 文件使用的 minSdkVersion 值不小于 19。

-

请务必在您的项目级

build.gradle文件中的buildscript和allprojects部分添加 Google 的 Maven 代码库。 -

将 Android 版机器学习套件库的依赖项添加到模块的应用级 Gradle 文件(通常为

app/build.gradle)。根据您的需求选择以下依赖项之一:如需将模型与您的应用捆绑在一起,请执行以下操作:

dependencies {// ...// Use this dependency to bundle the model with your appimplementation 'com.google.mlkit:face-detection:16.1.5' }如需在 Google Play 服务中使用模型,请执行以下操作:

dependencies {// ...// Use this dependency to use the dynamically downloaded model in Google Play Servicesimplementation 'com.google.android.gms:play-services-mlkit-face-detection:17.1.0' } -

如果您选择在 Google Play 服务中使用模型,则可以将应用配置为在从 Play 商店安装您的应用后,自动将模型下载到设备上。为此,请将以下声明添加到您应用的

AndroidManifest.xml文件:<application ...>...<meta-dataandroid:name="com.google.mlkit.vision.DEPENDENCIES"android:value="face" ><!-- To use multiple models: android:value="face,model2,model3" --> </application>您还可以通过 Google Play 服务 ModuleInstallClient API 明确检查模型可用性并请求下载。

如果您未启用安装时模型下载或请求明确下载,则模型会在您首次运行检测器时下载。您在下载完毕之前提出的请求不会产生任何结果。

输入图片指南

对于人脸识别,您使用的图片尺寸应至少为 480x360 像素。 为了使机器学习套件准确检测人脸,输入图片必须包含由足够像素数据表示的人脸。通常,要在图片中检测的每张人脸应至少为 100x100 像素。如果要检测人脸轮廓,机器学习套件需要更高的分辨率输入:每张人脸应至少为 200x200 像素。

如果您要在实时应用中检测人脸,可能还需要考虑输入图片的整体尺寸。较小图片的处理速度相对较快,因此,为了减少延迟时间,请以较低的分辨率捕获图片,但请牢记上述准确性要求,并确保正文的面部在图片中占尽可能大的部分。另请参阅提高实时性能的相关提示。

图片聚焦不佳也会影响准确性。如果您无法获得满意的结果,请让用户重新捕获图片。

人脸相对于相机的方向也会影响机器学习套件检测的面部特征。请参阅人脸检测概念。

1. 配置人脸检测器

在对图片应用人脸检测之前,如果要更改人脸检测器的默认设置,请使用 FaceDetectorOptions 对象指定这些设置。您可以更改以下设置:

| 设置 | |

|---|---|

| setPerformanceMode | PERFORMANCE_MODE_FAST(默认) | PERFORMANCE_MODE_ACCURATE 在检测人脸时更注重速度还是准确性。 |

| setLandmarkMode | LANDMARK_MODE_NONE(默认) | LANDMARK_MODE_ALL 是否尝试识别面部“特征点”:眼睛、耳朵、鼻子、脸颊、嘴巴等等。 |

| setContourMode | CONTOUR_MODE_NONE(默认) | CONTOUR_MODE_ALL 是否检测面部特征的轮廓。仅检测图片中最突出的人脸的轮廓。 |

| setClassificationMode | CLASSIFICATION_MODE_NONE(默认) | CLASSIFICATION_MODE_ALL 是否将人脸分为不同类别(例如“微笑”和“眼睛睁开”)。 |

| setMinFaceSize | float(默认值:0.1f) 设置所需的最小人脸大小,表示为头部宽度与图片宽度之比。 |

| enableTracking | false(默认)| true 是否为人脸分配 ID,以用于跨图片跟踪人脸。 请注意,启用轮廓检测后,仅会检测一张人脸,因此人脸跟踪不会产生有用的结果。为此,若要加快检测速度,请勿同时启用轮廓检测和人脸跟踪。 |

例如:

KotlinJava

// High-accuracy landmark detection and face classification FaceDetectorOptions highAccuracyOpts =new FaceDetectorOptions.Builder().setPerformanceMode(FaceDetectorOptions.PERFORMANCE_MODE_ACCURATE).setLandmarkMode(FaceDetectorOptions.LANDMARK_MODE_ALL).setClassificationMode(FaceDetectorOptions.CLASSIFICATION_MODE_ALL).build();// Real-time contour detection FaceDetectorOptions realTimeOpts =new FaceDetectorOptions.Builder().setContourMode(FaceDetectorOptions.CONTOUR_MODE_ALL).build();

FaceDetectionActivity.java

2. 准备输入图片

如需检测图片中的人脸,请基于设备上的以下资源创建一个 InputImage 对象:Bitmap、media.Image、ByteBuffer、字节数组或文件。然后,将 InputImage 对象传递给 FaceDetector 的 process 方法。

对于人脸检测,您使用的图片尺寸应至少为 480x360 像素。如果您要实时检测人脸,以此最低分辨率捕获帧有助于减少延迟时间。

您可以基于不同来源创建 InputImage 对象,下文分别介绍了具体方法。

使用 media.Image

如需基于 media.Image 对象创建 InputImage 对象(例如从设备的相机捕获图片时),请将 media.Image 对象和图片的旋转角度传递给 InputImage.fromMediaImage()。

如果您使用 CameraX 库,OnImageCapturedListener 和 ImageAnalysis.Analyzer 类会为您计算旋转角度值。

KotlinJava

private class YourAnalyzer implements ImageAnalysis.Analyzer {@Overridepublic void analyze(ImageProxy imageProxy) {Image mediaImage = imageProxy.getImage();if (mediaImage != null) {InputImage image =InputImage.fromMediaImage(mediaImage, imageProxy.getImageInfo().getRotationDegrees());// Pass image to an ML Kit Vision API// ...}}

}

如果您不使用可提供图片旋转角度的相机库,则可以根据设备的旋转角度和设备中相机传感器的朝向来计算旋转角度:

KotlinJava

private static final SparseIntArray ORIENTATIONS = new SparseIntArray();

static {ORIENTATIONS.append(Surface.ROTATION_0, 0);ORIENTATIONS.append(Surface.ROTATION_90, 90);ORIENTATIONS.append(Surface.ROTATION_180, 180);ORIENTATIONS.append(Surface.ROTATION_270, 270);

}/*** Get the angle by which an image must be rotated given the device's current* orientation.*/

@RequiresApi(api = Build.VERSION_CODES.LOLLIPOP)

private int getRotationCompensation(String cameraId, Activity activity, boolean isFrontFacing)throws CameraAccessException {// Get the device's current rotation relative to its "native" orientation.// Then, from the ORIENTATIONS table, look up the angle the image must be// rotated to compensate for the device's rotation.int deviceRotation = activity.getWindowManager().getDefaultDisplay().getRotation();int rotationCompensation = ORIENTATIONS.get(deviceRotation);// Get the device's sensor orientation.CameraManager cameraManager = (CameraManager) activity.getSystemService(CAMERA_SERVICE);int sensorOrientation = cameraManager.getCameraCharacteristics(cameraId).get(CameraCharacteristics.SENSOR_ORIENTATION);if (isFrontFacing) {rotationCompensation = (sensorOrientation + rotationCompensation) % 360;} else { // back-facingrotationCompensation = (sensorOrientation - rotationCompensation + 360) % 360;}return rotationCompensation;

}

然后,将 media.Image 对象及旋转角度值传递给 InputImage.fromMediaImage():

KotlinJava

InputImage image = InputImage.fromMediaImage(mediaImage, rotation);

使用文件 URI

如需基于文件 URI 创建 InputImage 对象,请将应用上下文和文件 URI 传递给 InputImage.fromFilePath()。如果您使用 ACTION_GET_CONTENT intent 提示用户从图库应用中选择图片,则这一操作非常有用。

KotlinJava

InputImage image;

try {image = InputImage.fromFilePath(context, uri);

} catch (IOException e) {e.printStackTrace();

}

使用 ByteBuffer 或 ByteArray

如需基于 ByteBuffer 或 ByteArray 创建 InputImage 对象,请首先按先前 media.Image 输入的说明计算图片旋转角度。然后,使用缓冲区或数组以及图片的高度、宽度、颜色编码格式和旋转角度创建 InputImage 对象:

KotlinJava

InputImage image = InputImage.fromByteBuffer(byteBuffer,/* image width */ 480,/* image height */ 360,rotationDegrees,InputImage.IMAGE_FORMAT_NV21 // or IMAGE_FORMAT_YV12 );

MLKitVisionImage.java

// Or:

InputImage image = InputImage.fromByteArray(

byteArray,

/* image width */480,

/* image height */360,

rotation,

InputImage.IMAGE_FORMAT_NV21 // or IMAGE_FORMAT_YV12

);

MLKitVisionImage.java

使用 Bitmap

如需基于 Bitmap 对象创建 InputImage 对象,请进行以下声明:

KotlinJava

InputImage image = InputImage.fromBitmap(bitmap, rotationDegree);

MLKitVisionImage.java

图片由 Bitmap 对象以及旋转角度表示。

3. 获取 FaceDetector 实例

KotlinJava

FaceDetector detector = FaceDetection.getClient(options); // Or use the default options: // FaceDetector detector = FaceDetection.getClient();

FaceDetectionActivity.java

4. 处理图片

将图片传递给 process 方法:

KotlinJava

Task<List<Face>> result =detector.process(image).addOnSuccessListener(new OnSuccessListener<List<Face>>() {@Overridepublic void onSuccess(List<Face> faces) {// Task completed successfully// ...}}).addOnFailureListener(new OnFailureListener() {@Overridepublic void onFailure(@NonNull Exception e) {// Task failed with an exception// ...}});

FaceDetectionActivity.java

注意:如果您使用的是 CameraX API,请务必在使用完 ImageProxy 后将其关闭(例如,将 OnCompleteListener 添加到 process 方法返回的 Task 中)。如需查看示例,请参阅快速入门示例应用中的 VisionProcessorBase 类。

5. 获取检测到的人脸的相关信息

如果人脸检测操作成功,系统会向成功监听器传递一组 Face 对象。每个 Face 对象都代表在图片中检测到的一张人脸。对于每张人脸,您可以获取它在输入图片中的边界坐标,以及您已配置人脸检测器所要查找的任何其他信息。例如:

KotlinJava

for (Face face : faces) {Rect bounds = face.getBoundingBox();float rotY = face.getHeadEulerAngleY(); // Head is rotated to the right rotY degreesfloat rotZ = face.getHeadEulerAngleZ(); // Head is tilted sideways rotZ degrees// If landmark detection was enabled (mouth, ears, eyes, cheeks, and// nose available):FaceLandmark leftEar = face.getLandmark(FaceLandmark.LEFT_EAR);if (leftEar != null) {PointF leftEarPos = leftEar.getPosition();}// If contour detection was enabled:List<PointF> leftEyeContour =face.getContour(FaceContour.LEFT_EYE).getPoints();List<PointF> upperLipBottomContour =face.getContour(FaceContour.UPPER_LIP_BOTTOM).getPoints();// If classification was enabled:if (face.getSmilingProbability() != null) {float smileProb = face.getSmilingProbability();}if (face.getRightEyeOpenProbability() != null) {float rightEyeOpenProb = face.getRightEyeOpenProbability();}// If face tracking was enabled:if (face.getTrackingId() != null) {int id = face.getTrackingId();}

}

FaceDetectionActivity.java

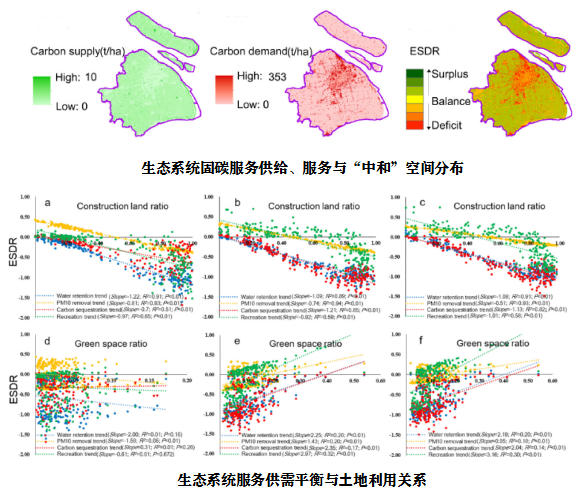

人脸轮廓的示例

启用人脸轮廓检测后,对于检测到的每个面部特征,您会获得一系列点。这些点表示特征的形状。如需详细了解轮廓的表示方式,请参阅人脸检测概念。

下图展示了这些点与人脸的对应情况,点击图片可将其放大:

实时人脸检测

如果要在实时应用中使用人脸检测,请遵循以下准则以实现最佳帧速率:

-

将人脸检测器配置为使用人脸轮廓检测或分类和特征点检测,但不能同时使用这二者:

轮廓检测

地标检测

分类

地标检测和分类

轮廓检测和地标检测

轮廓检测和分类

轮廓检测、地标检测和分类 -

启用

FAST模式(默认处于启用状态)。 -

建议以较低分辨率捕获图片,但是,请注意此 API 的图片尺寸要求。

- 如果您使用 Camera 或 camera2 API,则限制检测器的调用次数。如果在检测器运行时有新的视频帧可用,请丢弃该帧。如需查看示例,请参阅快速入门示例应用中的 VisionProcessorBase 类。

- 如果您使用的是 CameraX API,请确保将 Backpressure 策略设置为默认值 ImageAnalysis.STRATEGY_KEEP_ONLY_LATEST。 这样可以确保一次只会投放一张图片用于分析。如果分析器在繁忙时生成更多图像,系统会自动丢弃这些图像,而不会将其加入队列进行传送。通过调用 ImageProxy.close() 关闭要分析的图片后,将传送下一张最新图片。

- 如果要将检测器的输出作为图形叠加在输入图片上,请先从机器学习套件获取结果,然后在一个步骤中完成图片的呈现和叠加。每个输入帧只需在显示表面呈现一次。如需查看示例,请参阅快速入门示例应用中的 CameraSourcePreview 和 GraphicOverlay 类。

- 如果您使用 Camera2 API,请以

ImageFormat.YUV_420_888格式捕获图片。如果您使用旧版 Camera API,请以ImageFormat.NV21格式捕获图片。