大型语言模型有效推理研究综述

https://arxiv.org/pdf/2404.14294v1

摘要——大型语言模型(LLM)由于其在各种任务中的卓越性能,而引起了广泛的关注。

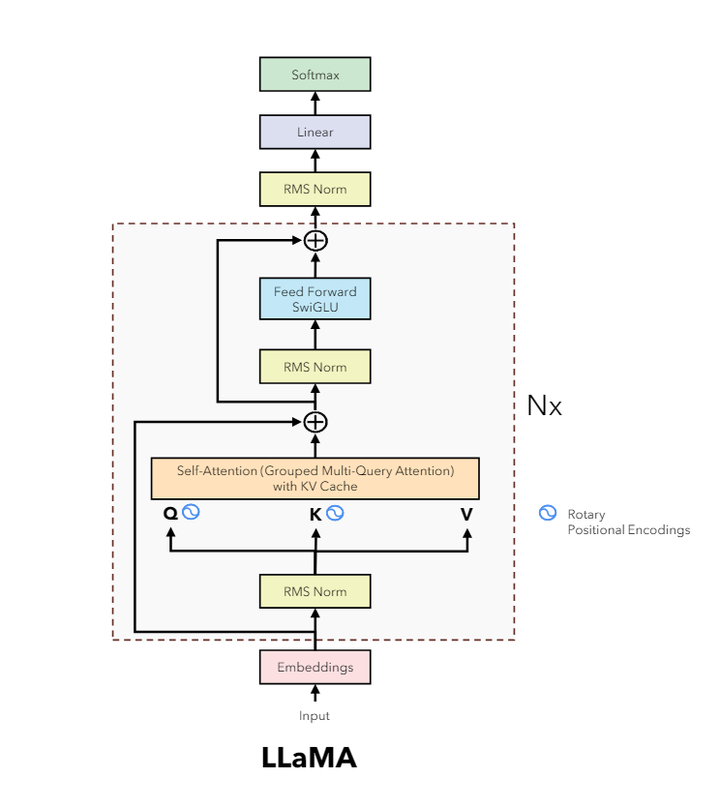

然而,LLM推理的大量计算和内存需求,对资源受限场景中的部署提出了挑战。该领域内的努力,致力于开发提高LLM推理效率的技术。对现有的关于有效LLM推理的文献进行了全面的综述。首先分析了LLM推理效率低下的主要原因,即模型大小大、四次复杂度注意操作和自回归解码方法。然后,引入了一个全面的分类法,将当前文献组织为数据级、模型级和系统级优化。此外,还包括在关键子领域内对代表性方法进行的比较实验,以提供定量见解。最后,提供了一些知识总结,并讨论了未来的研究方向。

结论

高效的LLM推理侧重于降低LLM推理过程中的计算、内存访问和内存成本,旨在优化效率指标,如延迟、吞吐量、存储、功率和能量。

这项调查对有效的LLM推理研究进行了全面回顾,提出了关键技术的见解、建议和未来方向。首先,介绍了一种分层分类法,包括数据级、模型级和系统级的优化。随后,在这一分类法的指导下,仔细检查和总结了每个层次和子领域的研究。对于模型量化和高效服务系统等成熟的技术,进行了实验来评估和分析它们的性能。基于这些分析,为该领域的从业者和研究人员提供了切实可行的建议,并确定了有前景的研究途径。

参考文献链接

https://arxiv.org/pdf/2404.14294v1

![[罗嗦的详解BURP靶场]彻底理解nosql最终关Lab: Exploiting NoSQL operator injection to extract unknown fields](https://img2024.cnblogs.com/blog/3309916/202406/3309916-20240614014953995-1483793394.png)

![[C++ Primer] 表达式](https://zzz-drawing-bed.oss-cn-nanjing.aliyuncs.com/img/20240614014150.png)