MiniCPM

https://github.com/OpenBMB/MiniCPM

面壁智能推出的大模型,在如下方面支持能出众。

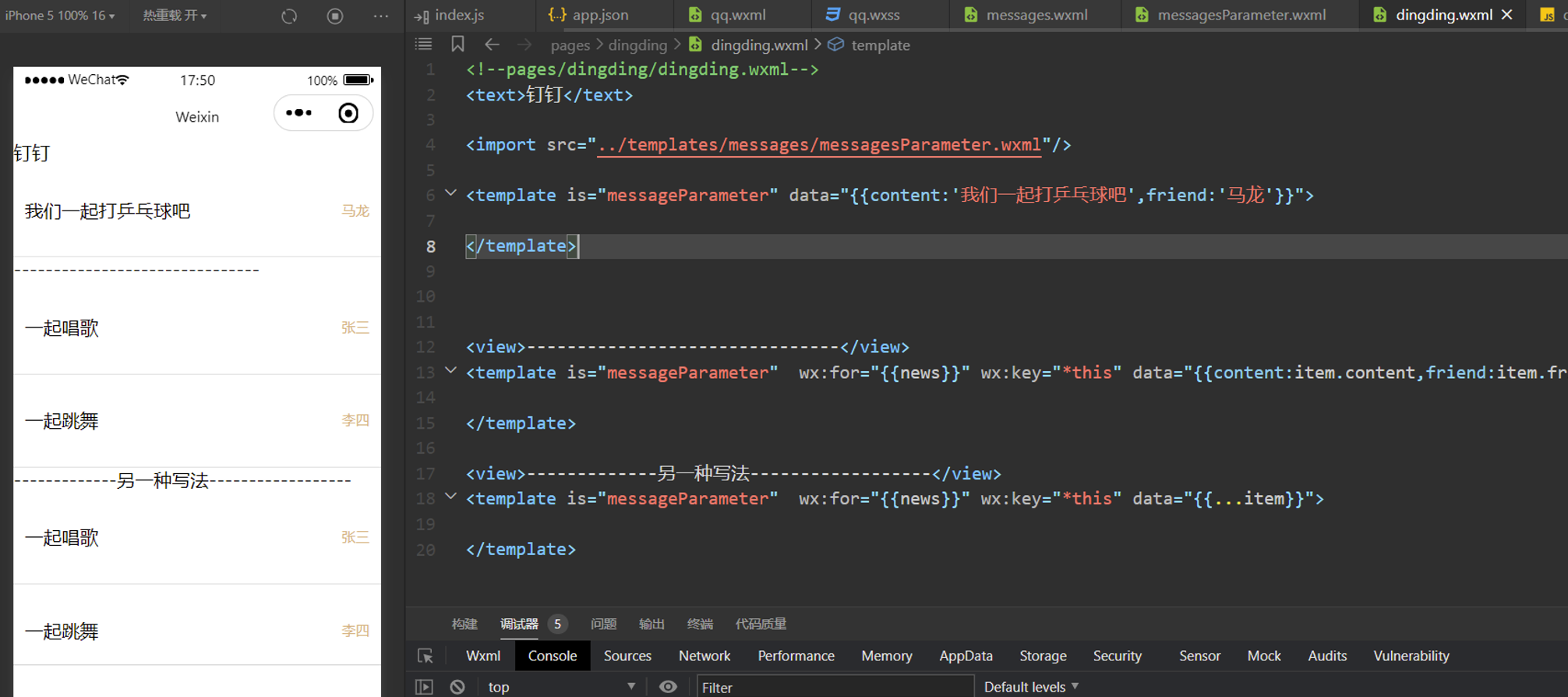

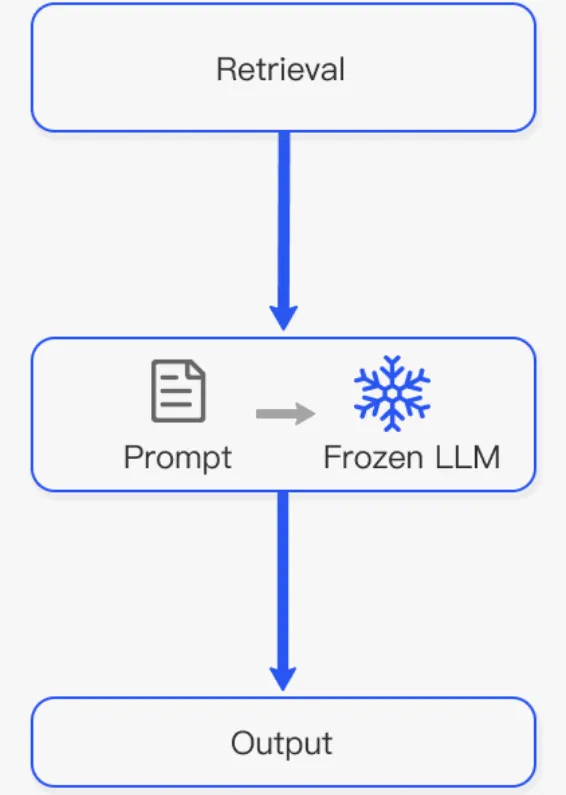

推理 长文本 RAG 都是常见的能力。

其中 指令遵从(IF=instruction follow) 和 工具调用(FC = function call), 威力强大, 可以用作很多语音控制场景。

MiniCPM 3.0 是一个 4B 参数量的语言模型,相比 MiniCPM1.0/2.0,功能更加全面,综合能力大幅提升,多数评测集上的效果比肩甚至超越众多 7B-9B 模型。

- 支持工具调用🛠️(Function Calling)和代码解释器💻(Code Interpreter):Berkeley Function Calling Leaderboard (BFCL) 上取得 9B 规模以下 SOTA,超越 GLM-4-9B-Chat、Qwen2-7B-Instruct。

- 超强的推理能力🧮:数学能力方面,MathBench 上的效果超越 GPT-3.5-Turbo 以及多个 7B-9B 模型。在非常具有挑战性的 LiveCodeBench 上,效果超越 Llama3.1-8B-Instruct。

- 出色的中英文指令遵循能力🤖:英文指令遵循 IFEval、中文指令遵循 FollowBench-zh 效果超越 GLM-4-9B-Chat、Qwen2-7B-Instruct。

- 长文本能力:原生支持 32k 上下文长度,32k 长度内大海捞针全绿。提出 LLM x MapReduce ,理论可处理的上下文长度达到 +∞。

- RAG能力:我们发布了 MiniCPM RAG 套件。基于 MiniCPM 系列模型的 MiniCPM-Embedding、MiniCPM-Reranker 在中文、中英跨语言检索测试中取得 SOTA 表现;针对 RAG 场景的 MiniCPM3-RAG-LoRA 在开放域问答等多项任务上超越 Llama3-8B、Baichuan2-13B 等模型。

应用场景

智能家居中的语音控制,不是简单的指令控制,而可以感知用户对话的情绪,做出正确的选择,并下调用相应工作做指令下发。

穿戴场景,如下智能眼镜

对于用户指令做分发决策的大模型,其必然依赖 此两种功能 IF + FC

https://zhuanlan.zhihu.com/p/695515605

古鉴认为在语音层面上,大模型整体反馈速度技能指令小于500毫秒,大模型层面小于2秒,这样用户才会觉得这个反馈是足够快的,而且它的反馈足够及时,才能够为用户提供户外运动、文化旅行、日程管理及实时翻译等多种多模态AI服务。古鉴还透露道,李未可科技的WAKE-AI就是以此为优化方向,并即将推出搭载WAKE-AI的终端新品。

第一,我们使用定向优化的分发大模型,帮助快速地分发用户的指令,比如我要听歌,我要跟语音助手聊一聊。

![[MySQL]一次死锁排查](https://img2024.cnblogs.com/blog/1533409/202409/1533409-20240909215526213-1413327299.png)