引子

写了很多篇开源大模型的环境部署与推理搭建,截止到目前,开源大模型已经发展较为完善。个人觉得,产品和项目维度来看更多的是如果去落地实现,也就是大模型的最后一公里的应用开发。最近看到Xinference一个开源很火的推理框架。OK,那就让我们开始吧。

一、框架介绍

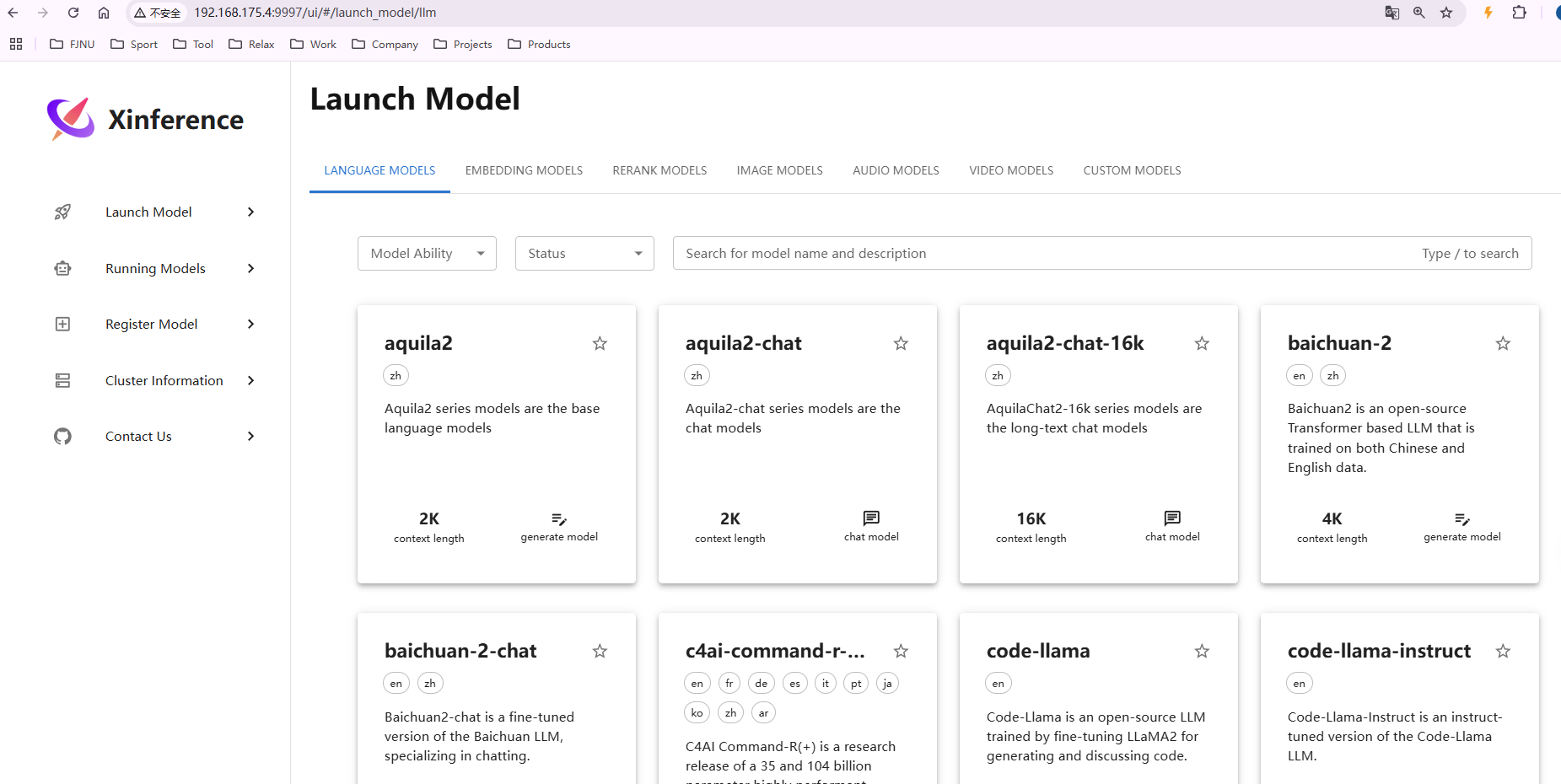

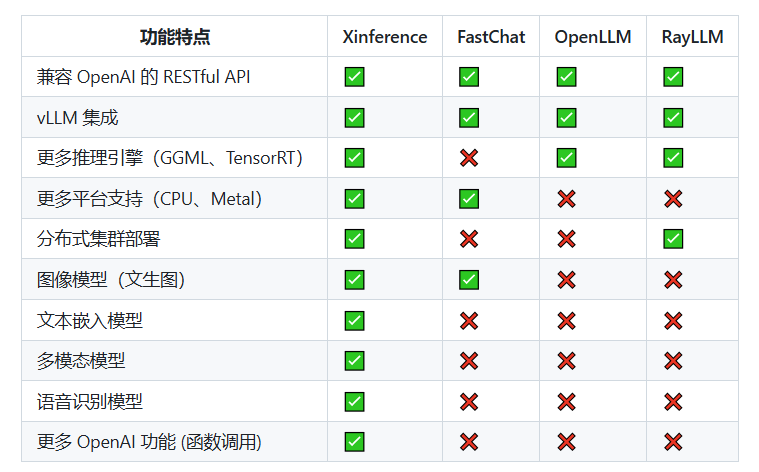

Xinference:一款性能强大且功能全面的大模型部署与分布式推理框架。可用于大语言模型(LLM),语音识别模型,多模态模型等各种模型的推理。通过Xorbits Inference,你可以轻松地一键部署你自己的模型或内置的前沿开源架构。

主要功能:

(1)模型推理,轻而易举:大语言模型,语音识别模型,多模态模型的部署流程被大大简化。一个命令即可完成模型的部署工作。

(2)前沿模型,应有尽有:框架内置众多中英文的前沿大语言模型,包括 baichuan,chatglm2 等,一键即可体验!内置模型列表还在快速更新中!

(3)异构硬件,快如闪电:通过 ggml,同时使用你的 GPU 与 CPU 进行推理,降低延迟,提高吞吐!

(4)接口调用,灵活多样:提供多种使用模型的接口,包括 OpenAI 兼容的 RESTful API(包括 Function Calling),RPC,命令行,web UI 等等。方便模型的管理与交互。

(5)集群计算,分布协同: 支持分布式部署,通过内置的资源调度器,让不同大小的模型按需调度到不同机器,充分使用集群资源。

(6)开放生态,无缝对接: 与流行的三方库无缝对接,包括 LangChain,LlamaIndex,Dify,以及 Chatbox。

二、环境搭建

docker run -it -v /datas/work/zzq/:/workspace --gpus=all --network=host pytorch/pytorch:2.4.0-cuda12.4-cudnn9-devel bash

cd /workspace/Xinference/inference/xinference/deploy/docker

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

pip install xinference -i https://pypi.tuna.tsinghua.edu.cn/simple

三、推理测试

xinference-local --host 0.0.0.0 --port 9997

访问网页: