是的,今天的 AI 是用软件编写的,但如今的实现实际上是一个计算图,它计算的是虚拟神经元网络的行为。软件仅仅是该网络的一个模拟。

让我解释一下。

就像我说的,神经网络 AI 实际上是一组相互连接的虚拟“神经元”。每个神经元或多或少地模拟了人类神经元的行为。这张图数学上地展示了一个典型的 AI“神经元”。

如果你学过数学,你可能能看懂这张图。但你只需要知道的是,像图中这样的“神经元”是 AI 系统的基本构造块,就像神经元是大脑的构造块一样。

大脑并不完全像 AI 系统。大脑有神经胶质细胞,还有化学物质以复杂的方式滋养神经元。AI 系统试图模拟那些被认为对认知至关重要的元素。AI 领域在这方面仍然在不断学习。

尽管如此,以这种方式构建的 AI 系统在各种认知能力上都取得了令人瞩目的成功。看看下图展示的 AI 能力增长就知道了。

真正的 AI 系统由大量这种虚拟神经元相互连接而成。这是我八年前构建的一个系统的图表:

当我说我构建了这个,我的意思是我用一种叫 TensorFlow 的数学工具模拟了它。TensorFlow 使你能够定义一个被称为计算图的东西。神经元的行为就是这样计算的——它是被模拟的。下图展示了我使用 TensorFlow 定义的计算图。

这就是矩阵数学。

这个计算图计算的是矩阵运算,它模拟了我的神经网络中虚拟“神经元”数组的激活函数和输入。

像 ChatGPT 这样的神经网络非常庞大。ChatGPT 3.5 拥有数十亿个模拟神经元,并且大约有 1000 亿个相互连接。当他们在第 4 版中把连接数增加到 5000 亿时,系统变得指数级地更聪明了——出现了涌现智能。尽管仍然不像人类那样聪明,但它以自己的方式变聪明了:在某些方面比我们聪明,而在某些方面比我们愚笨。

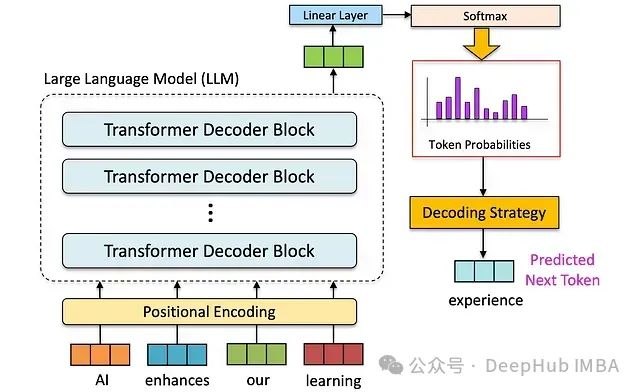

不过,ChatGPT 的架构非常有限。它在训练后无法继续学习,并且只使用了单一架构——一种所谓的“Transformer”模式。在过去的几年里,更强大、更灵活的设计已经被开发出来。

所有这些系统仍然只是神经网络的模拟。它们是计算机中的模拟。它们不是真正的神经网络,就像电脑游戏不是真实世界一样。然而,这些模拟给出的答案有时是正确的,有时是错误的,就像真实的神经网络会做的那样,就像大脑会做的那样。

此外,这些模拟非常耗电。由于它们是模拟的,所以效率非常低。计算机消耗的电能远远超过真实神经元。

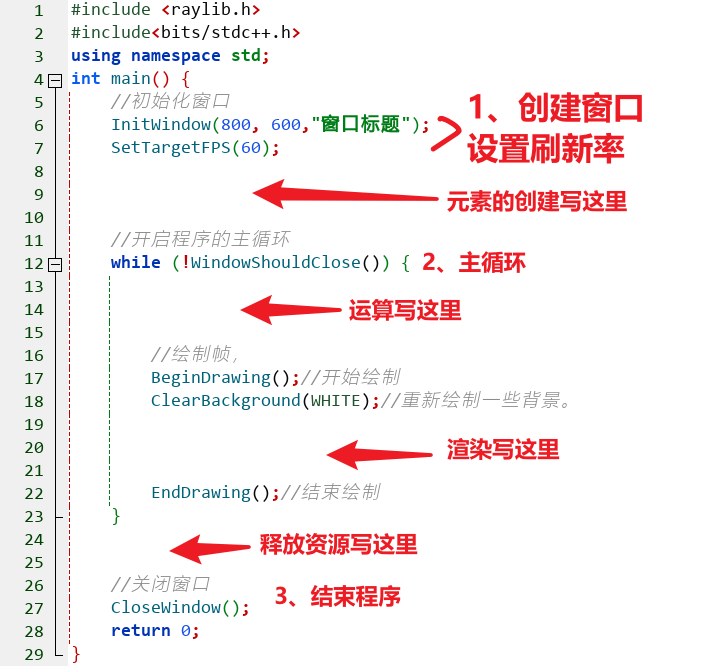

训练

用于神经网络的另一种软件是训练这些网络的软件。神经网络有很多不同的种类,每种的训练方式都不同。下图展示了一种训练“受限玻尔兹曼机”网络的算法。这来自一本我在 2010 年代中期学习时读过的教材。是的,这涉及大量数学——线性代数(矩阵数学)和高级统计学。

像 ChatGPT 这样的网络是以不同方式训练的。它们使用的是所谓的强化学习。尽管如此,仍然有计算机算法用于在海量数据上训练它们。在这个过程中,AI 通常会被要求重复阅读同样的信息最多四次——就像一个人备考一样。

训练过程有点像你从出生到 18 岁的成长过程,但速度极快。一旦完全训练完成,你就可以去面对世界了——大概吧。

AI 已经不是 2022 年的样子了

很多人没有意识到,他们两年前亲自体验过的 AI 系统现在已经非常过时了。技术在不断进步。

下图展示了最近发布的 DeepSeek V3 的架构。DeepSeek 震惊了世界,因为它的训练成本如此之低——比 OpenAI 的模型低两个数量级。这是因为 DeepSeek 的架构学习得更有效率。它更聪明了。

(参考:https://epoch.ai/gradient-updates/how-has-deepseek-improved-the-transformer-architecture)

另外,如果你用过 ChatGPT 或类似系统,并得出它不擅长推理的结论,你是对的。但仅仅两年内,已经有能像人类一样进行推理的模型被开发出来了。

2023 年底,当 OpenAI 开发出一个具备推理能力的模型时,科学家们感到震惊,并与 OpenAI 董事会召开会议,警告他们这个新模型表明他们正在走向开发出一种可能威胁人类的强大人工智能。这款 OpenAI 模型被称为 Q-star。后来,这个模型被重新命名为“Strawberry”,现在以“o1”这个名称对外推广。

所以,如果你去年用过 ChatGPT,但没有使用过任何新的推理模型,那么请抛弃你对 AI 能力的旧结论,去尝试这些新的推理模型。并且,明年再试一次,因为到那时,今年的模型也会变得过时。

如果我们使用真正的神经元呢?

一个有趣的想法是,如果神经网络试图模仿大脑,那如果我们直接使用真正的神经元会怎样?

有些公司实际上已经在尝试这样做。其中一家是澳大利亚的 Cortical Labs。下图来自他们的实验室:

(Cortical Labs 的图片)

他们使用真实的、活体的人类神经元网络,并通过电极来激活这些神经元并接收它们的响应。他们声称,这种生物神经网络的性能优于基于计算机的神经网络。此外,它们的能耗要低得多——事实上,它们使用的是化学能,而不是电能。

进入神经形态芯片

但人们也在创造非生物的真实神经网络。这些被称为 神经形态系统。猜猜看?它们不仅更快,而且耗电量比传统 AI 低 10,000 倍,体积也缩小了 数千倍。

目前的 AI 之所以运行在数据中心里,仅仅是因为我们在模拟神经网络。如果我们构建真正的神经网络,就不再需要 AI 数据中心了。

而且,由于神经形态系统不是模拟的,它们不运行任何软件。

让我再说一遍:它们不运行软件。 从某种意义上说,它们是 非生物的大脑。

为什么我们还没有看到它们被广泛使用?

目前,最新 AI 系统的架构和现有神经形态芯片的架构之间存在一些不匹配。然而,随着时间推移,这种不匹配将会被解决。因为它的激励实在是太大了——想象一下,强大的 AI 系统只需极低的能耗,这意味着它们可以脱离数据中心,实现 移动化,就像人类一样自由行动。

数字时代结束了

数字时代已经结束了。那是昨天的事情了。

AI 不是软件。 今天,它被软件束缚住,就像一匹赛马被关在马厩里一样。但很快,AI 将会挣脱束缚,成为它本来的样子。

AI 不是计算机的下一次进化,而是 摆脱计算机,迈向一个更接近大脑的存在。

AI 时代已经开启。

![[AI/前沿展望/综述] AI大模型的技术生态链全景图](https://blog-static.cnblogs.com/files/johnnyzen/cnblogs-qq-group-qrcode.gif?t=1679679148)