回忆一下,super(MaskedSoftmaxCELoss, self).forward就相当于直接计算损失函数,这是nn.Module的普遍做法

nn.CrossEntropyLoss的输入要求如下

unweighted_loss的形状是(batch_size, num_steps),也就是对应每一个样本的每一步的直接的交叉熵损失

9.7.3 损失函数

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.hqwc.cn/news/884306.html

如若内容造成侵权/违法违规/事实不符,请联系编程知识网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

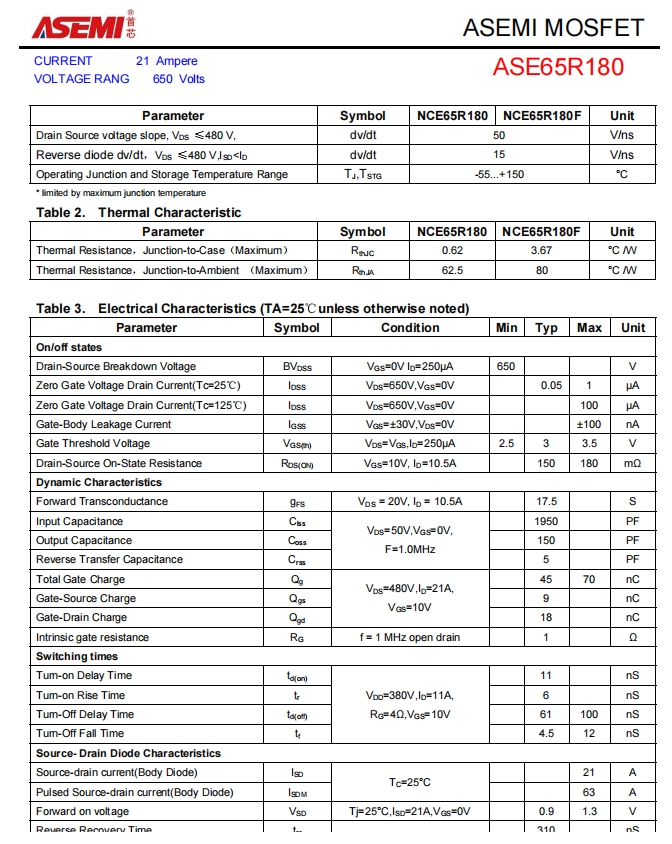

65R180-ASEMI逆变器专用MOS管65R180

65R180-ASEMI逆变器专用MOS管65R180编辑:ll

65R180-ASEMI逆变器专用MOS管65R180

型号:65R180

品牌:ASEMI

封装:TO-220F

最大漏源电流:21A

漏源击穿电压:650V

批号:最新

RDS(ON)Max:180mΩ

引脚数量:3

沟道类型:超洁MOS管

芯片尺寸:MIL

漏电流:

恢复时间:ns

芯片…

Markdown常用语法整理

Markdown常用语法整理

一、标题

h1

一级标题下面加===

h2

二级标题下面加---

h3

h4

h5

二、文字高亮这段文字将被高亮显示...三、插入链接或者图片

链接是前面中括号后面小括号:点击跳转百度图片是链接前面加感叹号:四、列表

无序列表(*或+或-),如:黄瓜

玉米

茄子黄瓜

玉…

P1121 环状最大两段子段和

链接

https://www.luogu.com.cn/problem/P1121

题目思路这个O(n)的思路很好:https://www.cnblogs.com/kamimxr/p/11438701.html。

关键思路:

答案分两种情况,一种是选择的两段均不跨越n到1(也就是环),另一种是选择的两段跨过了环;

如果均不跨越环,那么也就是意味着这是一道…

muduo网络库核心代码阅读(Thread,EventLoopThread,EventLoopThreadPool)(4)

muduo网络库核心设计为one loop one thread,即一个线程一个事件循环。其中,主Reactor负责监听新连接,并将新连接平均分配到从Reactor中,而从Reactor则对分配到其上的用户进行io交互,接收并处理用户发来的数据,包括消息的回复(实际上,在使用中需要手动设置Reactor线程的…

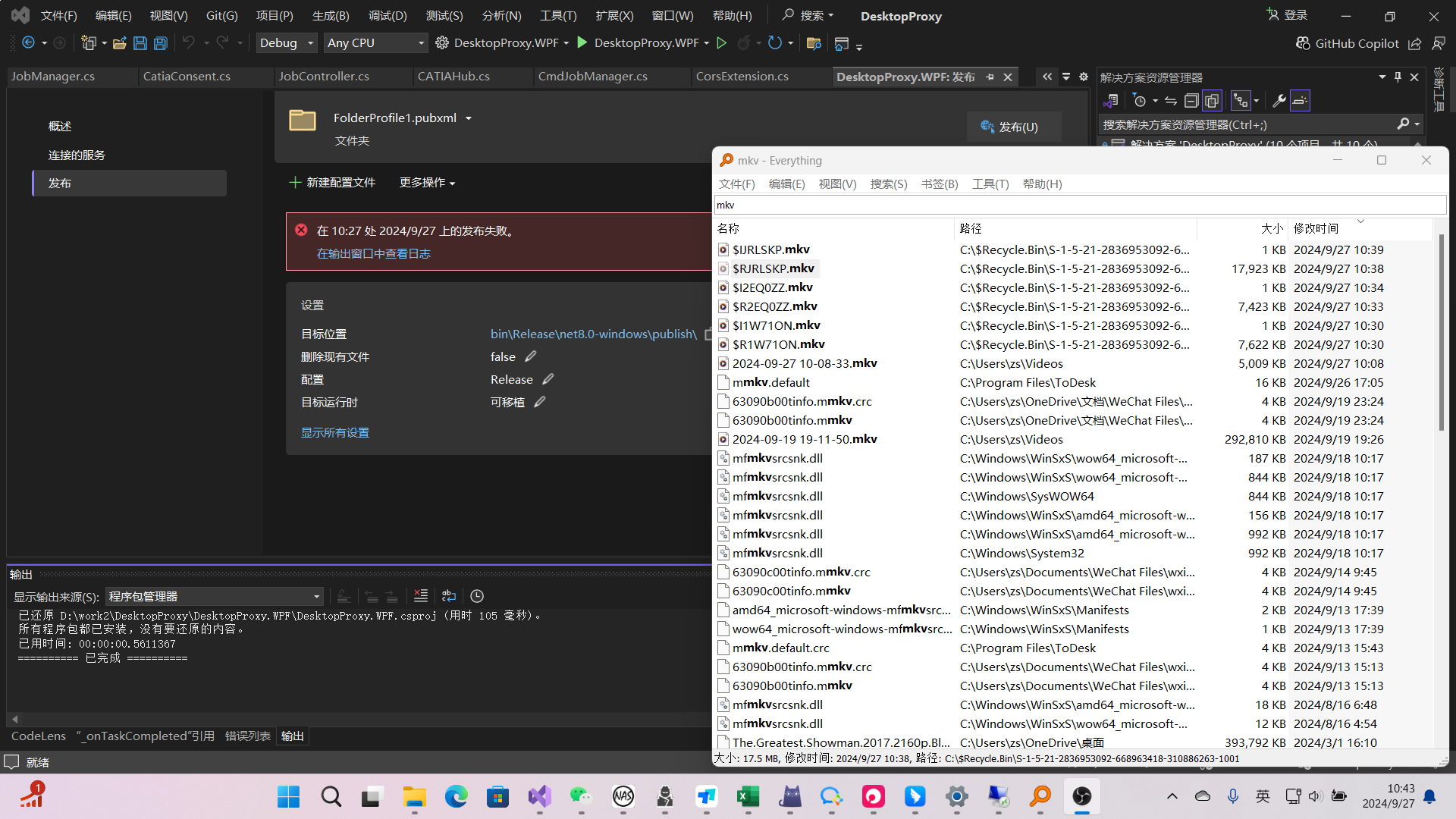

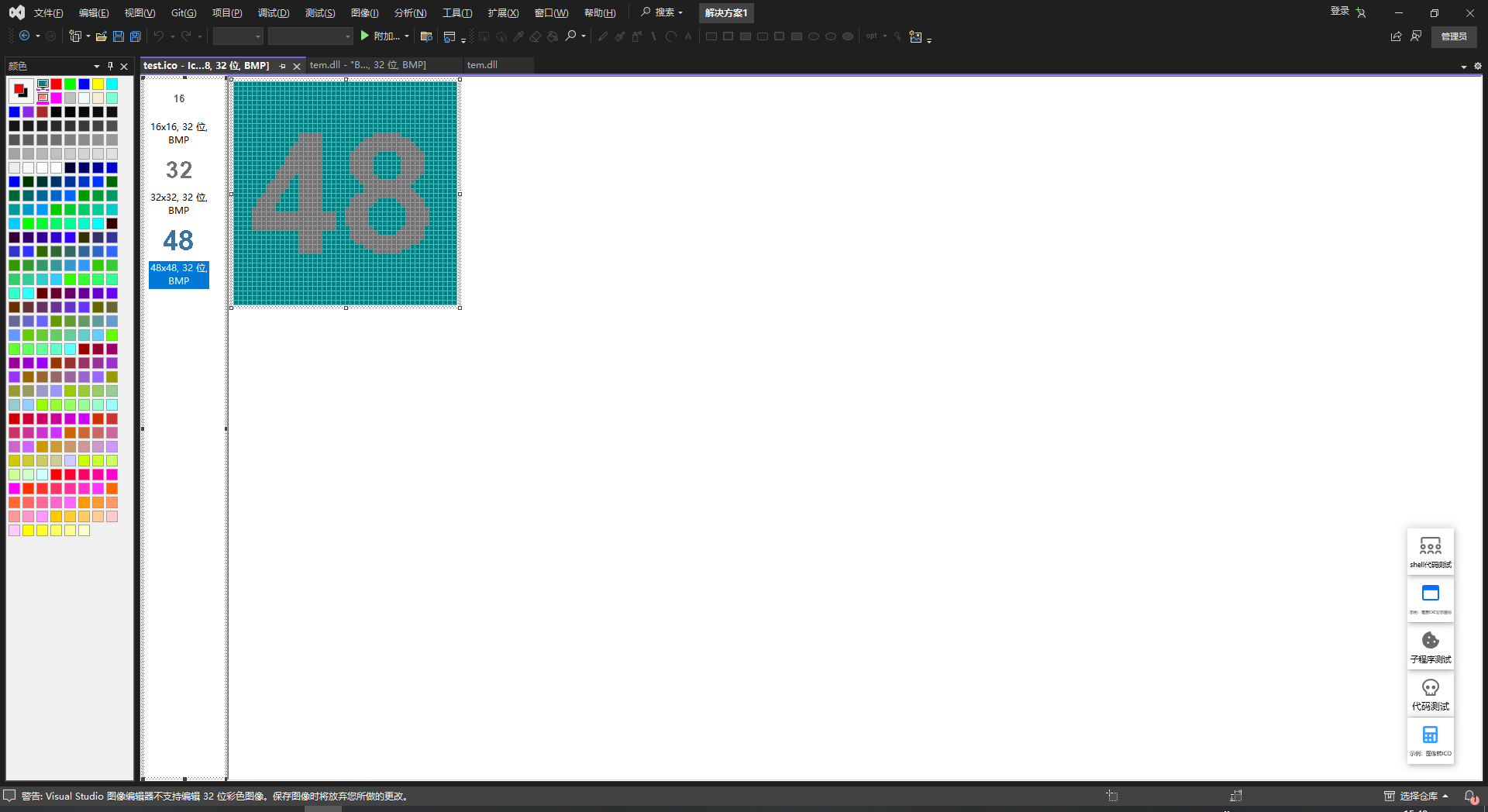

C#生成多尺寸bmp格式ICO图标代码

代码取自deepseek,且已经过本地执行测试

//.cs 文件类型,便于外部编辑时使用

// 引用必要的命名空间

using System.Collections.Generic;

using System.Drawing;

using System.Drawing.Imaging;

using System.IO;

using System.Linq;

using System.Runtime.InteropServices;/…

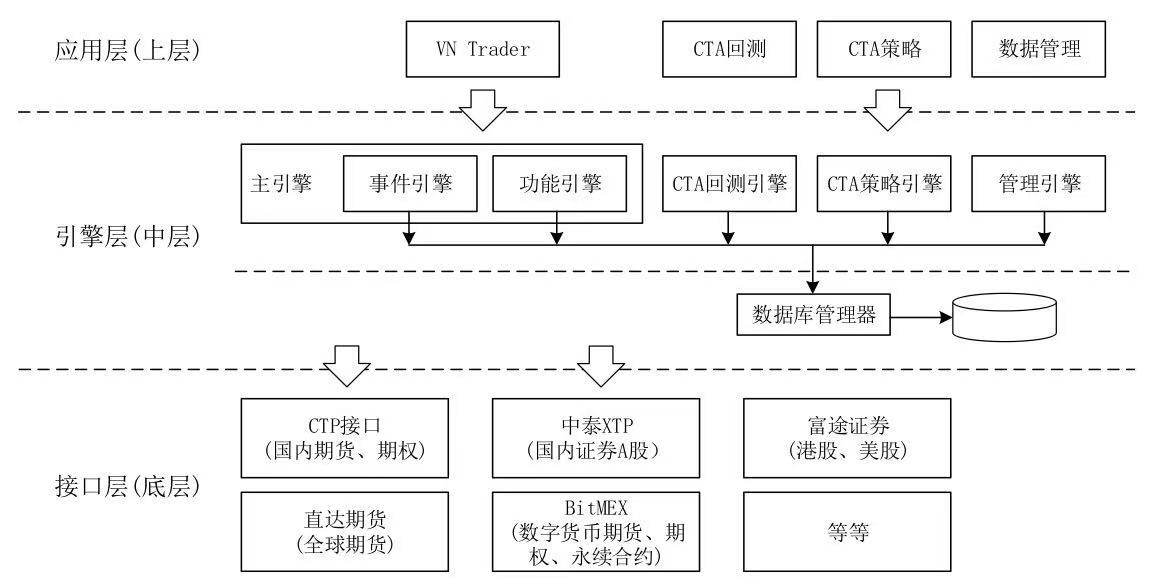

CTA:回测执行引擎BacktestingEngine

回测执行引擎BacktestingEngine

回顾前面的文章CTA:回测综述,那里提到,真正执行回测的逻辑,写在BacktestingEngine中。

代码解读

BacktestingEngine定义在vnpy_ctastrategy -> backtesting.py中。

package

from collections import defaultdict

from datetime import da…

CTA:回测快速示例

设置工作目录

VNPY程序启动后,会产生一个工作目录,程序运行产生的数据、系统配置都会放在指定的.vntrader目录当中。

这一设置在vnpy -> utility.py -> _get_trader_dir函数中可以找到,工作目录由TRADER_DIR, TEMP_DIR确定。

def _get_trader_dir(temp_name: str) -&g…

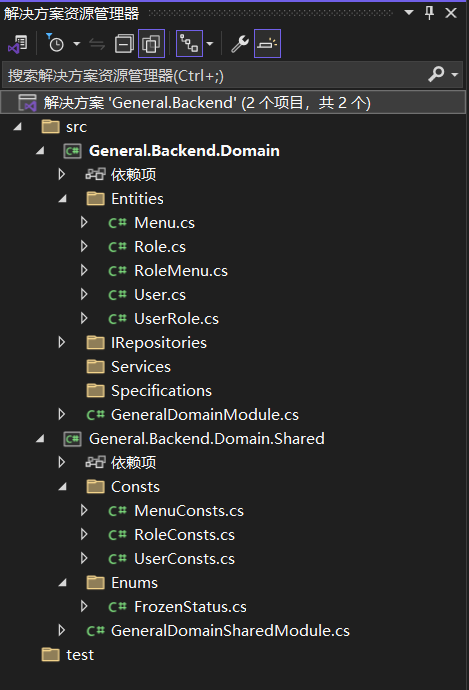

【ABP】项目示例(2)——聚合根和实体

聚合根和实体

在上一章节中,已经完成了项目搭建的前置准备,在这一章节中,实现领域层的聚合根和实体

创建名称为General.Backend.Domain的标准类库,分别新建名称为Entities、Services、IRepositories和Specifications的文件夹,用于存放实体和聚合根、领域服务、仓储接口和规…