annaconda安装Python 3.11.7

下载代码:

GitHub - chatchat-space/Langchain-Chatchat: Langchain-Chatchat(原Langchain-ChatGLM)基于 Langchain 与 ChatGLM 等语言模型的本地知识库问答 | Langchain-Chatchat (formerly langchain-ChatGLM), local knowledge based LLM (like ChatGLM) QA app with langchain

然后查看项目的requirements.txt和requirements_api.txt,发现里面用的是

torch==2.1.2

torchvision==0.16.2

torchaudio==2.1.2

因为是基于GPU,所以修改为

torch==2.1.2+cu121 torchvision==0.16.2+cu121 torchaudio==2.1.2+cu121

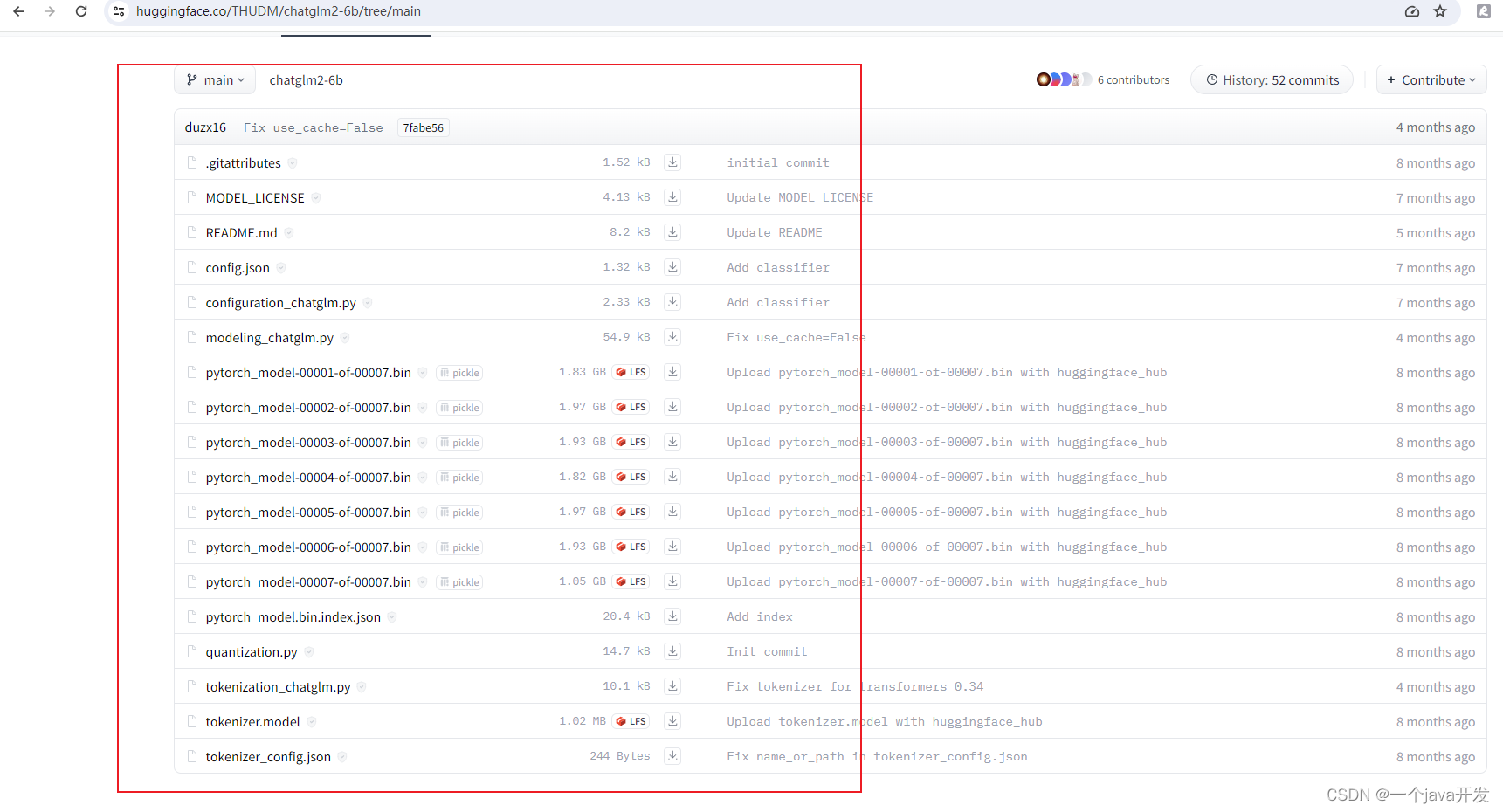

下载模型库:

真的慢,所有文件全部下载下来

Embedding 模型:

LLM 模型:

我这下载后的存放位置为:

D:\\model\\bge-large-zh

D:\\model\\chatglm2-6b

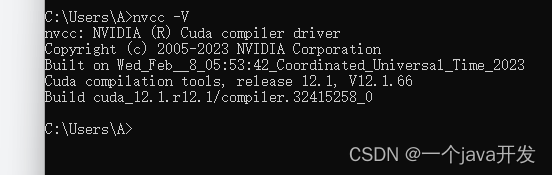

安装cuda:

官网下载,然后安装即可

CUDA Toolkit Archive | NVIDIA Developer

我这安装的是12.1

安装torch:

pip3 install torch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 --index-url https://download.pytorch.org/whl/cu121

最后的cu121代码这cuda是12.1

修改代码:

修改代码中的configs目录下的所有文件,去掉后缀的example

然后修改model_config.py

EMBEDDING_DEVICE = "cuda"

LLM_DEVICE = "cuda"

TEMPERATURE = 0.1

EMBEDDING_MODEL = "bge-large-zh"

LLM_MODELS = ["chatglm2-6b"]

"bge-large-zh": "D:\\model\\bge-large-zh",

"chatglm2-6b": "D:\\model\\chatglm2-6b",

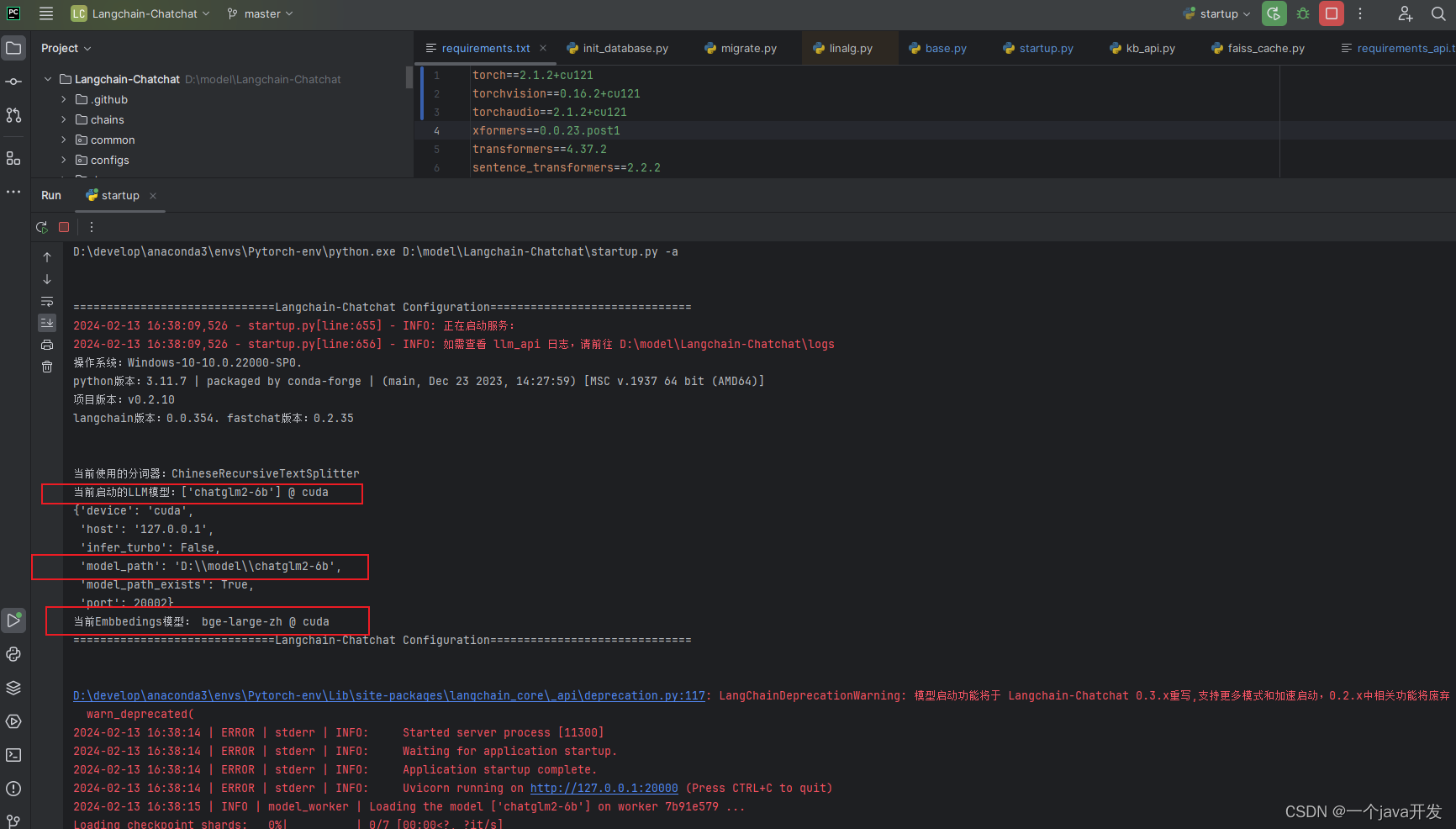

启动:

修改依赖文件中关于torch,torchvision,torchaudio的版本号 为安装torch的时候的版本号# 安装全部依赖pip install -r requirements.txt pip install -r requirements_api.txtpip install -r requirements_webui.txt

python startup.py -a

可以从日志中看到分别使用了什么模型

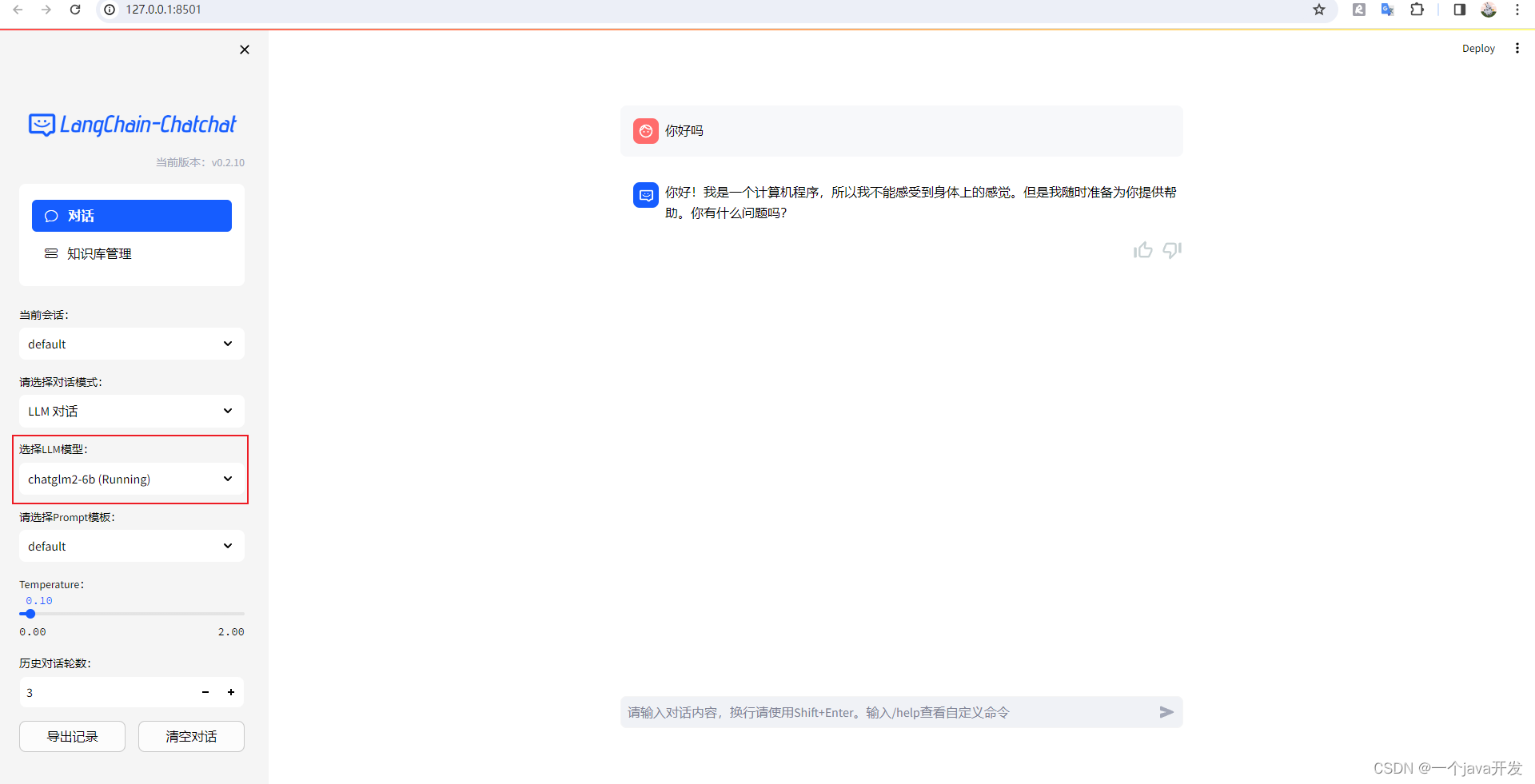

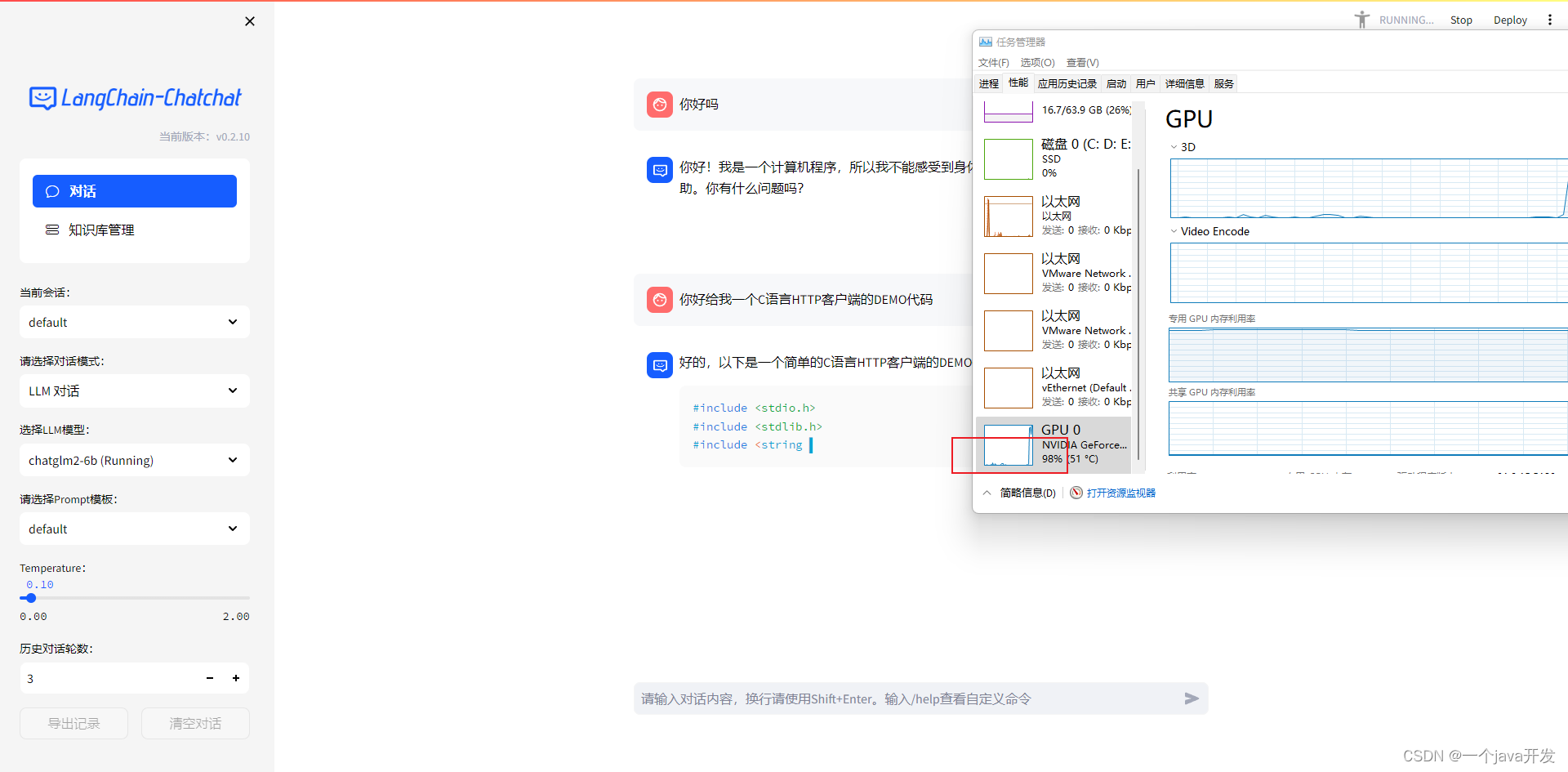

UI界面

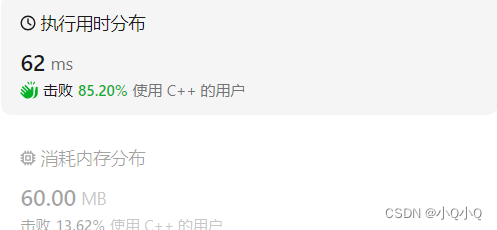

可以发现问问题的时候GPU直接拉满了

BUG:

知识库用不起,创建失败,上传文件也失败,才不到一年的项目BUG多也正常