1.程序功能描述

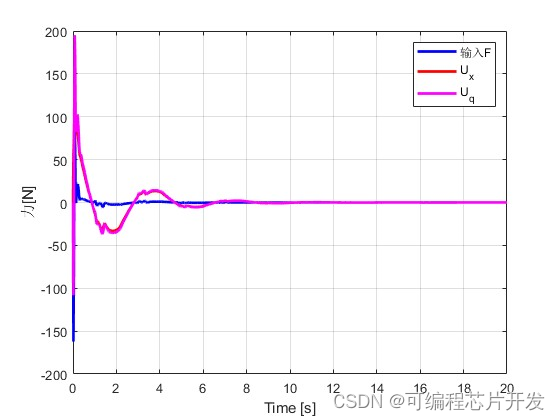

基于EM期望最大化算法的GMM模型参数估计是一种常用的统计学习方法,用于估计高斯混合模型(Gaussian Mixture Model,GMM)的参数。仿真输出EM算法的迭代收敛曲线,并得到GMM的参数估计结果。

2.测试软件版本以及运行结果展示

MATLAB2022a版本运行

3.核心程序

disp('估计值');

mu1_est = mu_ini(1,:)

mu2_est = mu_ini(2,:)

sgm1_est = sgm_ini{1}

sgm2_est = sgm_ini{2}figure(1)

subplot(133);

hold off;

plot(X1(:,1), X1(:,2), 'g.');

hold on;

plot(X2(:,1), X2(:,2), 'y.');% 创建网格点坐标

[A,B] = meshgrid(u, u);

Gridx = [A(:),B(:)];% 计算每个网格点上的高斯响应

z1_est = func_GMMDist(Gridx, mu1_est, sgm1_est);

z2_est = func_GMMDist(Gridx, mu2_est, sgm2_est);% 将响应重新整形为2D网格,以便使用contour进行绘制

Y1_est = reshape(z1_est, Gsize, Gsize);

Y2_est = reshape(z2_est, Gsize, Gsize);

contour(u, u, Y1_est, 3);

contour(u, u, Y2_est, 3);

daspect([1 1 1])

title(['EM估计GMM模型']);

% 绘制原始中心点和新的中心点

plot(mu1_est(1),mu1_est(2),'r.')

plot(mu2_est(1),mu2_est(2),'r.') figure;

plot(err,'b-o');

xlabel('EM迭代次数');

ylabel('EM估计误差');

grid on;

10

4.本算法原理

基于EM期望最大化算法的GMM模型参数估计是一种常用的统计学习方法,用于估计高斯混合模型(Gaussian Mixture Model,GMM)的参数。

4.1 GMM模型

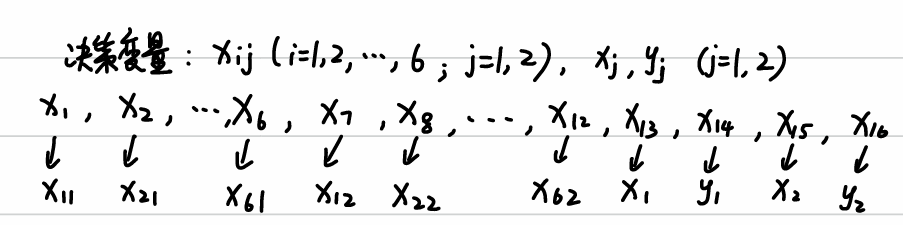

GMM模型是一种概率密度函数,用于描述子群体的混合体。假设数据集X包含N个样本,每个样本都是D维向量。GMM模型假设数据集由K个高斯分布混合而成,每个高斯分布称为一个组件(component)。GMM模型的概率密度函数可以表示为:

4.2 EM算法

EM算法全称最大期望算法(Expectation-maximization algorithm,翻译为期望最大化算法),是在概率模型中寻找参数最大似然估计或者最大后验估计的算法,其中概率模型依赖于无法观测的隐性变量。 在GMM模型中,每个样本所属的组件是隐变量。EM算法通过迭代计算期望(E步)和最大化(M步)来估计模型参数。

STEP 1: 计算期望(E),利用对隐藏变量的现有估计值,计算其最大似然估计值。

STEP 2: 最大化(M),最大化E步上求得的最大似然值来计算参数的值。M步上找到的参数估计值被用于下一个E步计算中,这个过程不断交替进行。

4.3 算法流程

初始化模型参数:随机初始化每个组件的权重、均值和协方差矩阵。

E步:根据当前的模型参数,计算每个样本属于每个组件的后验概率。

M步:根据E步计算得到的后验概率,更新模型参数。

判断是否收敛:如果模型参数收敛,则停止迭代;否则,返回步骤2继续迭代。

输出模型参数:输出最终的模型参数,包括每个组件的权重、均值和协方差矩阵。